Preview text:

lOMoAR cPSD| 39651089

See discussions, stats, and author profiles for this publication at: https://www.researchgate.net/publication/204753072

WEB data mining by clustering technique Thesis · January 2007 CITATIONS READS 0 7,578 1 author: Hoang Van Dung

HCMC University of Technology and Education

100 PUBLICATIONS 912 CITATIONS lOMoAR cPSD| 39651089 MỤC LỤC

MỤC LỤC ................................................................................................... i

DANH SÁCH CÁC HÌNH ......................................................................... v

DANH SÁCH CÁC BẢNG BIỂU ............................................................ vi

CÁC CỤM TỪ VIẾT TẮT........................................................................ vii

LỜI MỞ ĐẦU .............................................................................................. 1

Chương 1. TỔNG QUAN VỀ KHAI PHÁ DỮ LIỆU ................................. 3

1.1. Khai phá dữ liệu và phát hiện tri thức ......................................................... 3

1.1.1. Khai phá dữ liệu ................................................................................... 3

1.1.2. Quá trình khám phá tri thức .................................................................. 4

1.1.3. Khai phá dữ liệu và các lĩnh vực liên quan .......................................... 5

1.1.4. Các kỹ thuật áp dụng trong khai phá dữ liệu ........................................ 5

1.1.5. Những chức năng chính của khai phá dữ liệu ...................................... 7

1.1.6. Ứng dụng của khai phá dữ liệu ............................................................. 9

1.2. Kỹ thuật phân cụm trong khai phá dữ liệu ................................................ 10

1.2.1. Tổng quan về kỹ thuật phân cụm ........................................................ 10

1.2.2. Ứng dụng của phân cụm dữ liệu ......................................................... 13

1.2.3. Các yêu cầu ối với kỹ thuật phân cụm dữ liệu ................................. 13

1.2.4. Các kiểu dữ liệu và ộ o tương tự ..................................................... 15

1.2.4.1. Phân loại kiểu dữ liệu dựa trên kích thước miền ......................... 15

1.2.4.2. Phân loại kiểu dữ liệu dựa trên hệ o .......................................... 15

1.2.4.3. Khái niệm và phép o ộ tương tự, phi tương tự........................ 17

1.3. Khai phá Web ............................................................................................ 20

1.3.1. Lợi ích của khai phá Web ................................................................... 20

1.3.2. Khai phá Web ..................................................................................... 21

1.3.3. Các kiểu dữ liệu Web .......................................................................... 22

1.4. Xử lý dữ liệu văn bản ứng dụng trong khai phá dữ liệu Web .................. 23

1.4.1. Dữ liệu văn bản ................................................................................... 23

1.4.2. Một số vấn ề trong xử lý dữ liệu văn bản ......................................... 23

1.4.2.1. Loại bỏ từ dừng ............................................................................ 24

1.4.2.2. Định luật Zipf .............................................................................. 25

1.4.3. Các mô hình biểu diễn dữ liệu văn bản .............................................. 26

1.4.3.1. Mô hình Boolean ......................................................................... 26

1.4.3.2. Mô hình tần số ............................................................................. 27

1.5. Tổng kết chương 1 ..................................................................................... 30 lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm

Chương 2. MỘT SỐ KỸ THUẬT PHÂN CỤM DỮ LIỆU ....................... 31

2.1. Phân cụm phân hoạch ................................................................................ 31

2.1.1. Thuật toán k-means ............................................................................. 32

2.1.2. Thuật toán PAM .................................................................................. 34

2.1.3. Thuật toán CLARA ............................................................................. 38

2.1.4. Thuật toán CLARANS........................................................................ 39

2.2. Phân cụm phân cấp .................................................................................... 41

2.2.1. Thuật toán BIRCH .............................................................................. 42

2.2.2. Thuật toán CURE ................................................................................ 45

2.3. Phân cụm dựa trên mật ộ ......................................................................... 47

2.3.1 Thuật toán DBSCAN ........................................................................... 47

2.3.2. Thuật toán OPTICS ............................................................................ 51

2.3.3. Thuật toán DENCLUE ....................................................................... 52

2.4. Phân cụm dựa trên lưới.............................................................................. 54

2.4.1 Thuật toán STING ............................................................................... 55

2.4.2 Thuật toán CLIQUE............................................................................. 56

2.5. Phân cụm dữ liệu dựa trên mô hình........................................................... 57

2.5.1. Thuật toán EM .................................................................................... 58

2.5.2. Thuật toán COBWEB ......................................................................... 59

2.6. Phân cụm dữ liệu mờ ................................................................................. 59

2.7. Tổng kết chương 2 ..................................................................................... 60

Chương 3. KHAI PHÁ DỮ LIỆU WEB ..................................................... 62

3.1. Khai phá nội dung Web ............................................................................. 62

3.1.1. Khai phá kết quả tìm kiếm .................................................................. 63

3.1.2. Khai phá văn bản Web ........................................................................ 63

3.1.2.1. Lựa chọn dữ liệu .......................................................................... 64

3.1.2.2. Tiền xử lý dữ liệu ......................................................................... 64

3.1.2.3. Biểu iễn văn bản ......................................................................... 65

3.1.2.4. Trích rút các từ ặc trưng ............................................................. 65

3.1.2.5. Khai phá văn bản ......................................................................... 66

3.1.3. Đánh giá chất lượng mẫu ................................................................ 68

3.2. Khai phá theo sử dụng Web ...................................................................... 69

3.2.1. Ứng dụng của khai phá theo sử dụng Web ......................................... 70 lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm

3.2.2. Các kỹ thuật ược sử dụng trong khai phá theo sử dụng Web ........... 71

3.2.3. Những vấn ề trong khai khá theo sử dụng Web. .............................. 71

3.2.3.1. Chứng thực phiên người dùng ..................................................... 71

3.2.3.2. Đăng nhập Web và xác ịnh phiên chuyển hướng người dùng ... 72

3.2.3.3. Các vấn ề ối với việc xử lý Web log ........................................ 72

3.2.3.4. Phương pháp chứng thực phiên làm việc và truy cập Web ......... 73

3.2.4. Quá trình khai phá theo sử dụng Web ................................................ 73

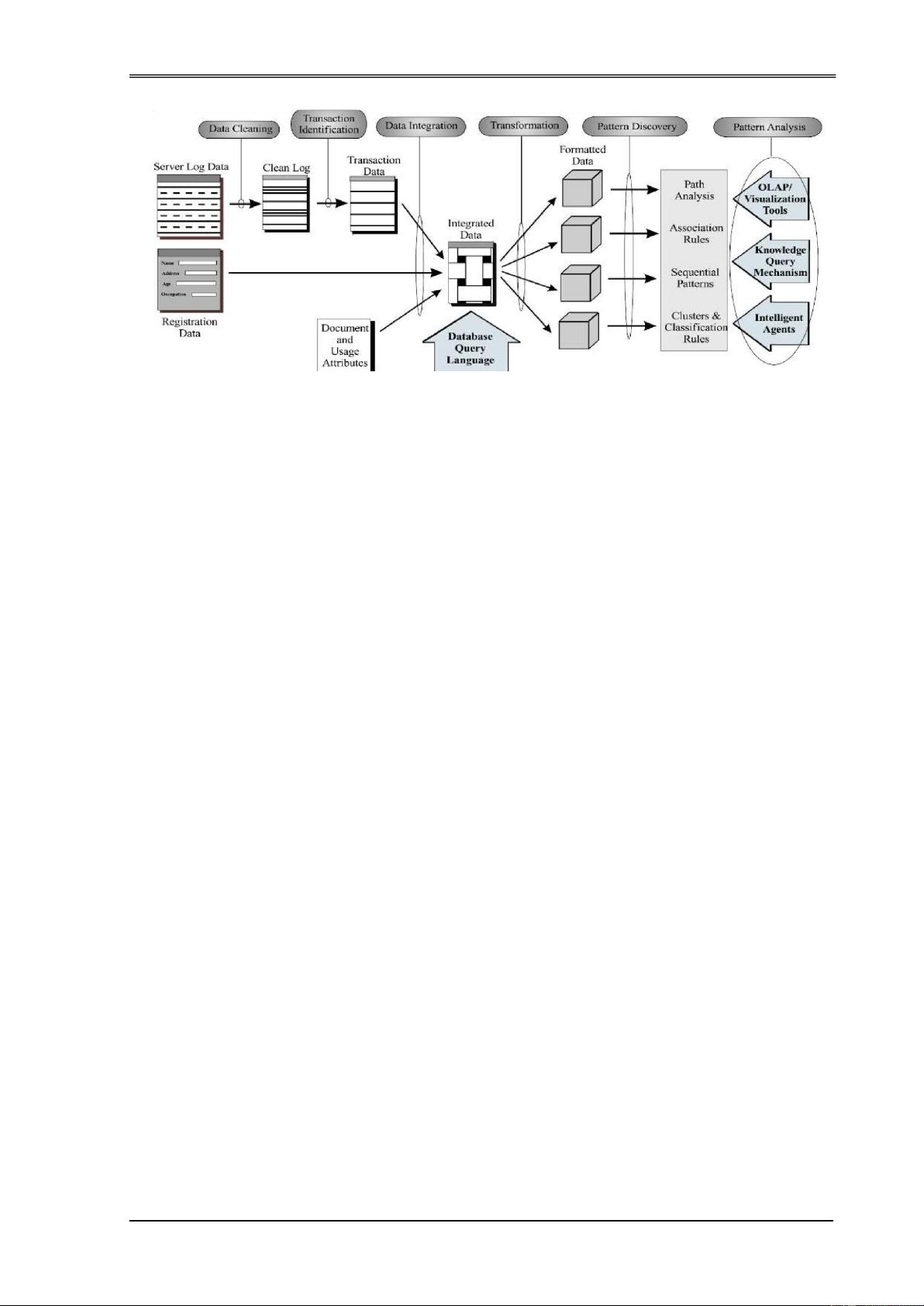

3.2.4.1. Tiền xử lý dữ liệu ......................................................................... 73

3.2.4.2. Khai phá dữ liệu ........................................................................... 73

3.2.4.3. Phân tích ánh giá ........................................................................ 75

3.2.5. Ví dụ khai phá theo sử dụng Web ...................................................... 75

3.3. Khai phá cấu trúc Web .............................................................................. 77

3.3.1. Tiêu chuẩn ánh giá ộ tương tự ........................................................ 79

3.3.2. Khai phá và quản lý cộng ồng Web .................................................. 80

3.3.2.1. Thuật toán PageRank ................................................................... 81

3.3.2.2. Phương pháp phân cụm nhờ thuật toán HITS ............................. 82

3.4. Áp dụng thuật toán phân cụm dữ liệu trong tìm kiếm và PCDL Web ...... 85

3.4.1. Hướng tiếp cận bằng kỹ thuật phân cụm ............................................ 85

3.4.2. Quá trình tìm kiếm và phần cụm tài liệu ............................................ 87

3.4.2.1. Tìm kiếm dữ liệu trên Web .......................................................... 87

3.4.2.2. Tiền xử lý dữ liệu ......................................................................... 88

3.4.2.3. Xây dựng từ iển .......................................................................... 89

3.4.2.4. Tách từ, số hóa văn bản và biểu diễn tài liệu ............................... 90

3.4.2.5. Phân cụm tài liệu .......................................................................... 90

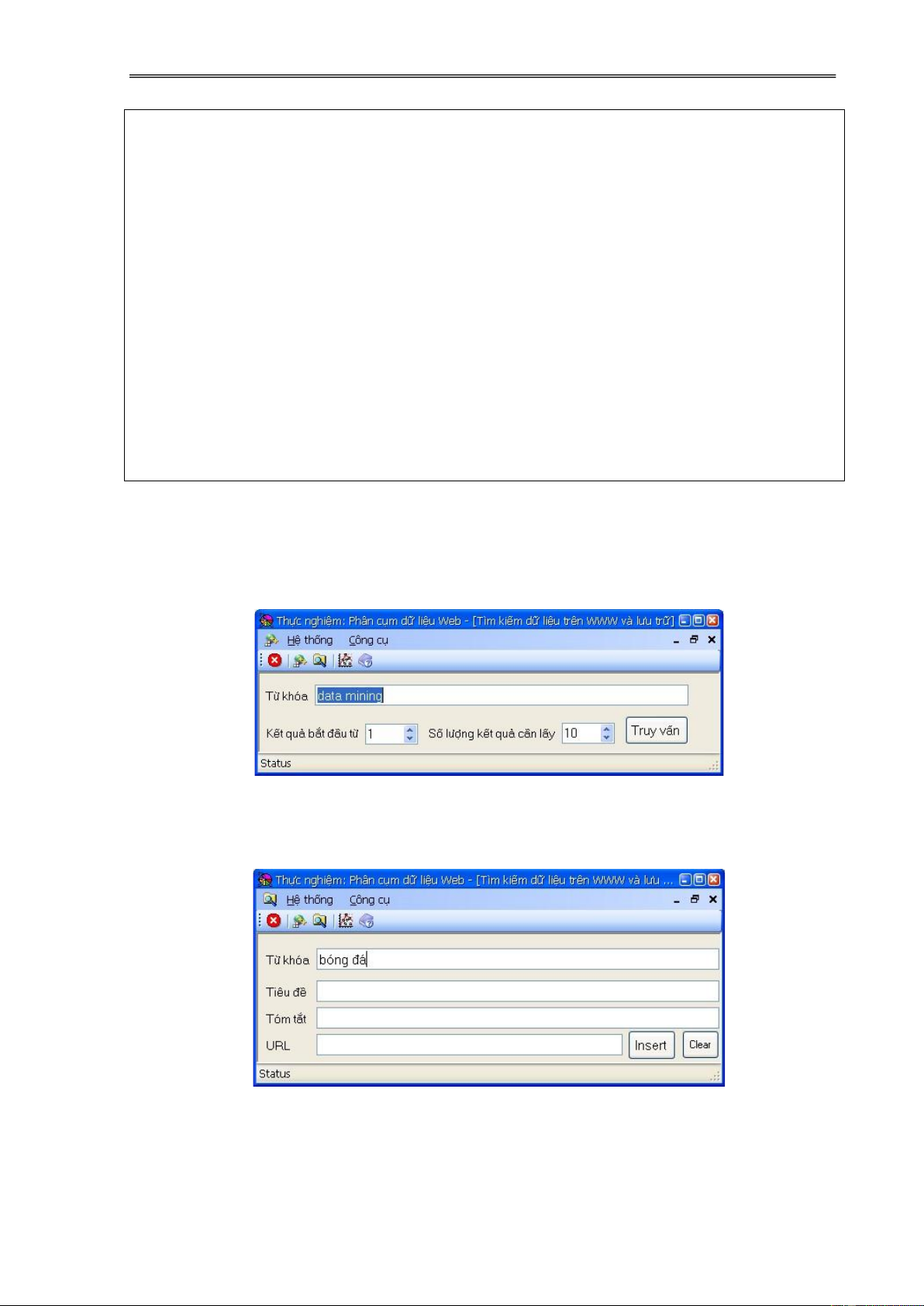

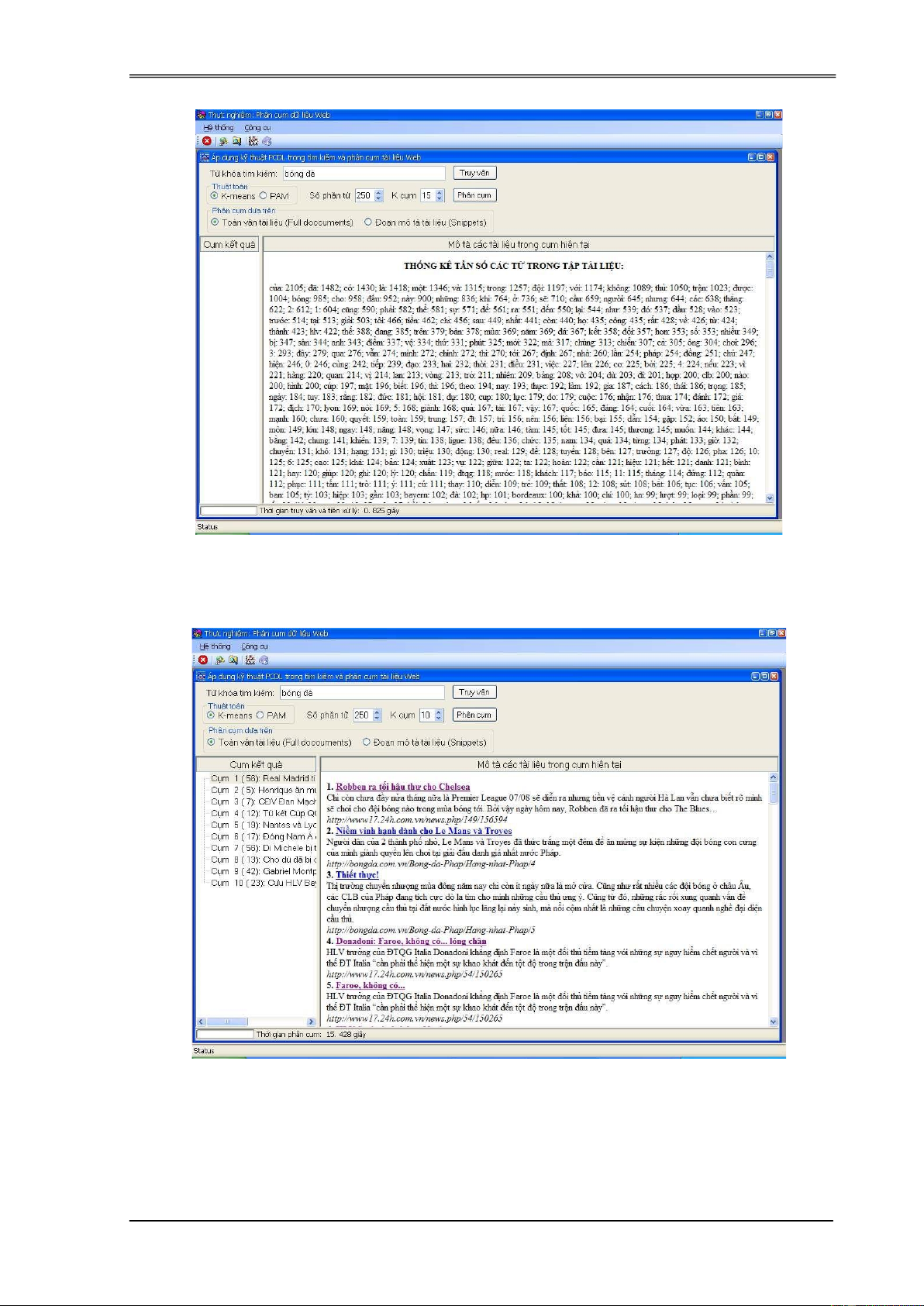

3.4.6. Kết quả thực nghiệm ........................................................................... 92

3.5. Tổng kết chương 3 ..................................................................................... 93

KẾT LUẬN VÀ HƯỚNG PHÁT TRIỂN ................................................... 94

PHỤ LỤC ................................................................................................... 96

TÀI LIỆU THAM KHẢO ......................................................................... 102 DANH SÁCH CÁC HÌNH lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm

Hình 1.1. Quá trình khám phá tri thức ........................................................... 4

Hình 1.2. Các lĩnh vực liên quan ến khám phá tri thức trong CSDL .......... 6

Hình 1.3. Trực quan hóa kết quả KPDL trong Oracle ................................ 10

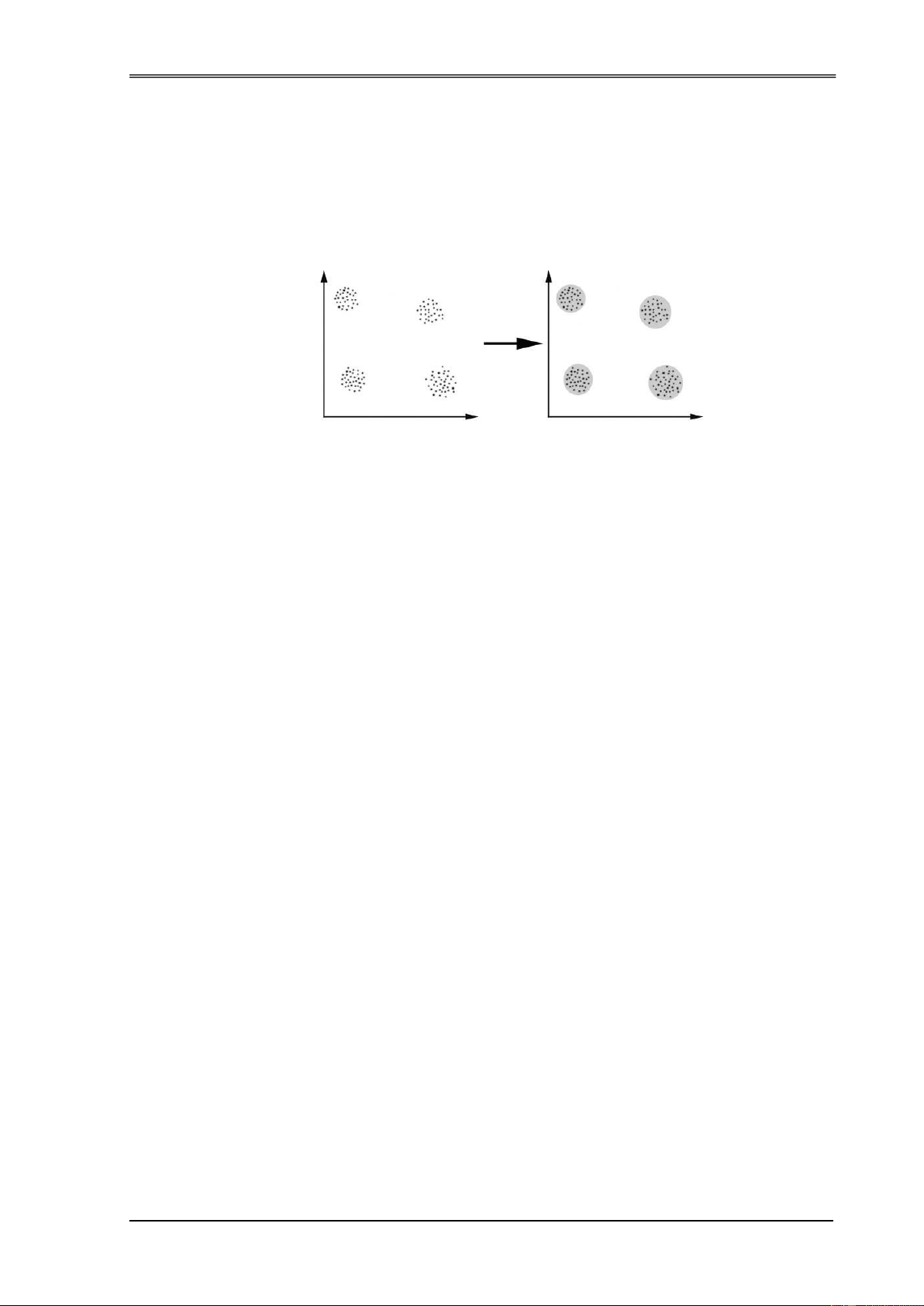

Hình 1.4. Mô phỏng sự PCDL ..................................................................... 11

Hình 1.5. Phân loại dữ liệu Web.................................................................. 22

Hình 1.6. Lược ồ thống kê tần số của từ theo Định luật Zipf ................... 26

Hình 1.7. Các ộ o tương tự thường dùng ................................................. 29

Hình 2.1. Thuật toán k-means ..................................................................... 32

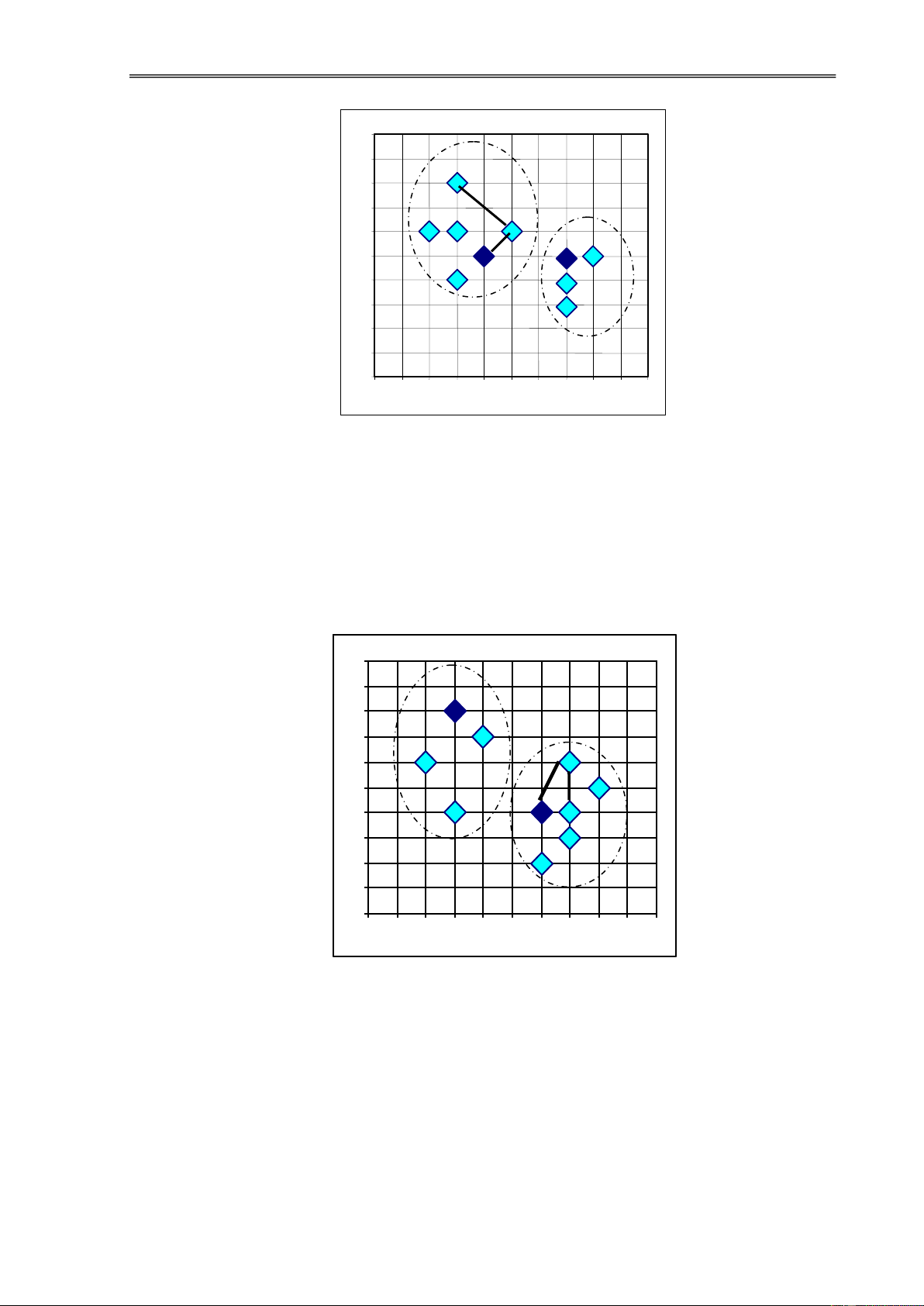

Hình 2.2. Hình dạng cụm dữ liệu ược khám phá bởi k-means ................. 33

Hình 2.3. Trường hợp Cjmp=d(Oj,Om,2) – d(Oj, Om) không âm .................... 35

Hình 2.4. Trường hợp Cjmp= (Oj,Op)- d(Oj, Om) có thể âm hoặc dương ..... 36

Hình 2.5. Trường hợp Cjmp bằng không ....................................................... 36

Hình 2.6. Trường hợp Cjmp= (Oj,Op)- d(Oj, Om,2) luôn âm .......................... 37

Hình 2.7. Thuật toán PAM .......................................................................... 37

Hình 2.8. Thuật toán CLARA ..................................................................... 38

Hình 2.9. Thuật toán CLARANS ................................................................ 40

Hình 2.10. Các chiến lược phân cụm phân cấp ........................................... 42

Hình 2.11. Cây CF ược sử dụng bởi thuật toán BIRCH ........................... 43

Hình 2.12. Thuật toán BIRCH ..................................................................... 44

Hình 2.13. Ví dụ về kết quả phân cụm bằng thuật toán BIRCH ................. 44

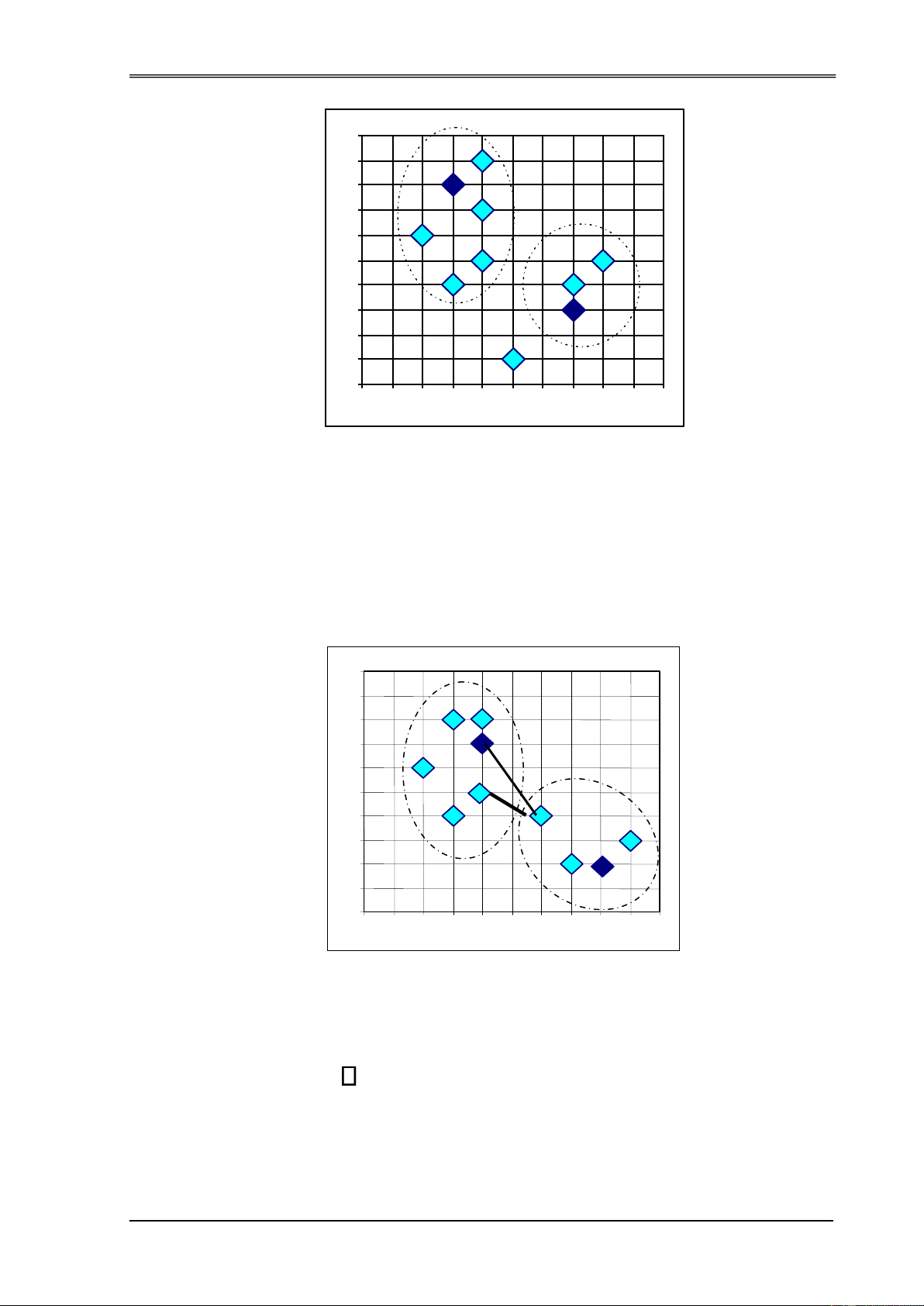

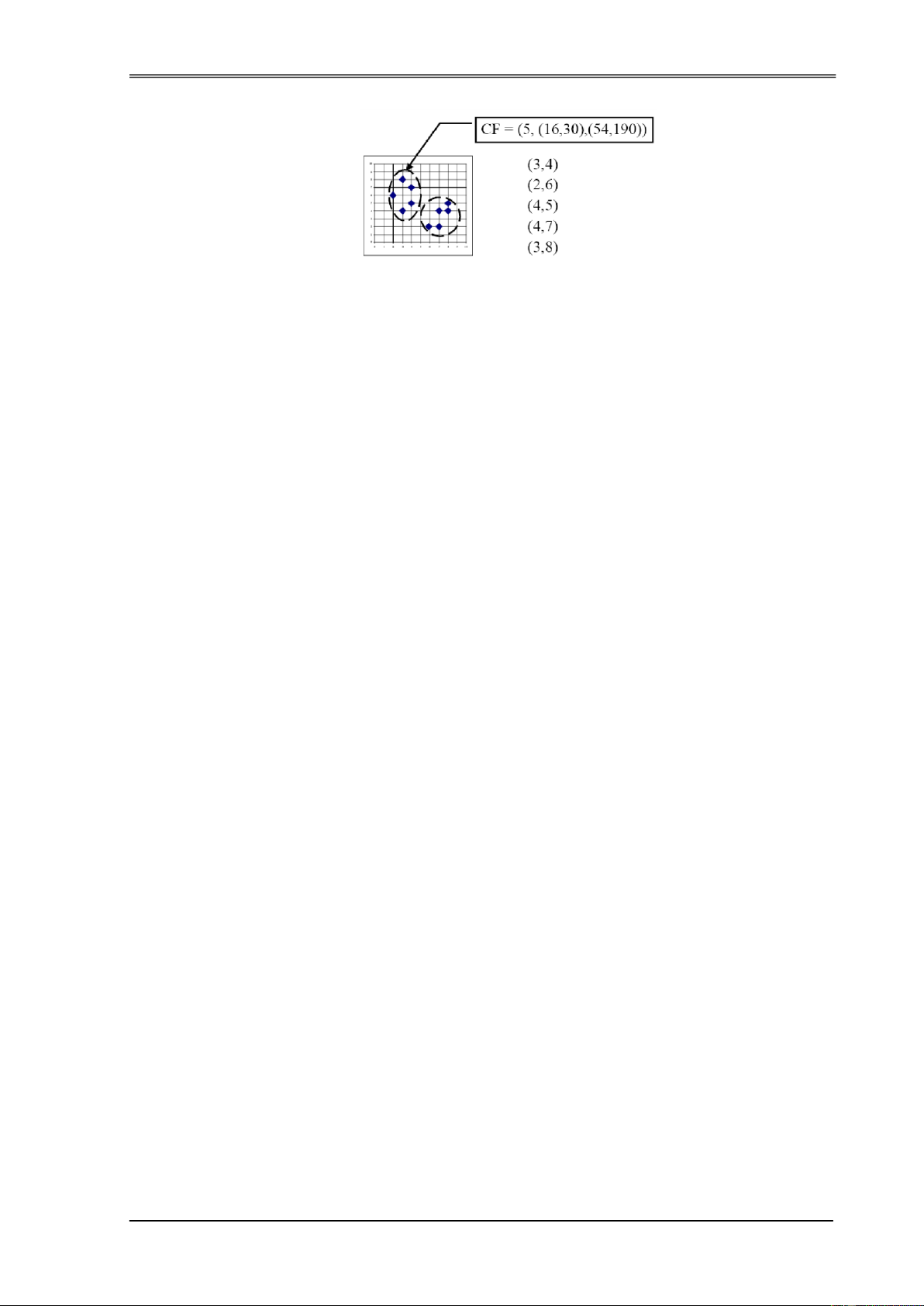

Hình 2.14. Các cụm dữ liệu ược khám phá bởi CURE ............................. 45

Hình 2.15. Thuật toán CURE ...................................................................... 46

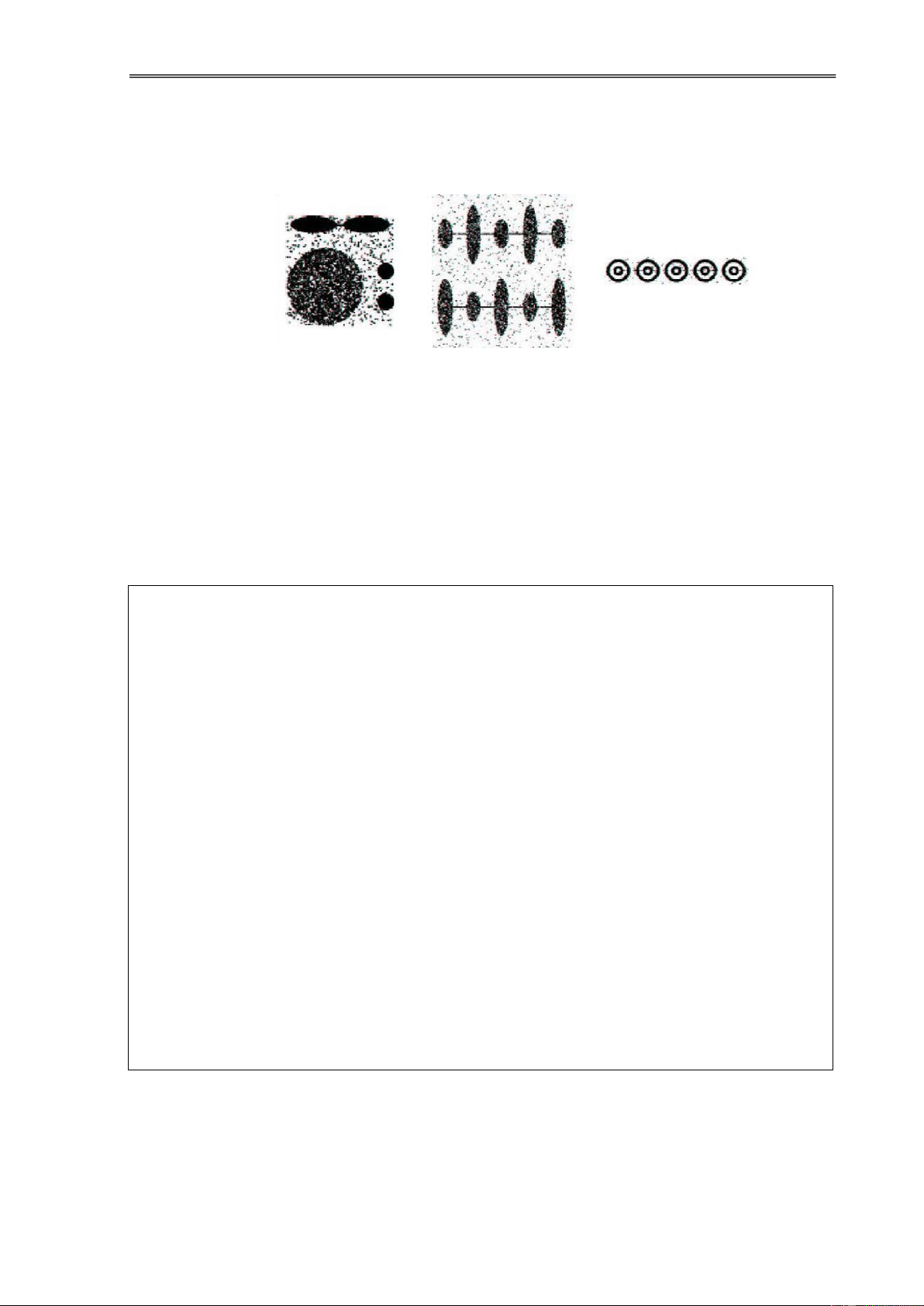

Hình 2.16. Một số hình dạng khám phá bởi phân cụm dưa trên mật ộ ..... 47 lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm

Hình 2.17. Lân cận của P với ngưỡng Eps .................................................. 48

Hình 2.18. Mật ộ - ến ược trực tiếp ....................................................... 49

Hình 2.19. Mật ộ ến ược ........................................................................ 49

Hình 2.20. Mật ộ liên thông ....................................................................... 49

Hình 2.21. Cụm và nhiễu ............................................................................. 50

Hình 2.22. Thuật toán DBSCAN ................................................................. 51

Hình 2.23. Thứ tự phân cụm các ối tượng theo OPTICS .......................... 52

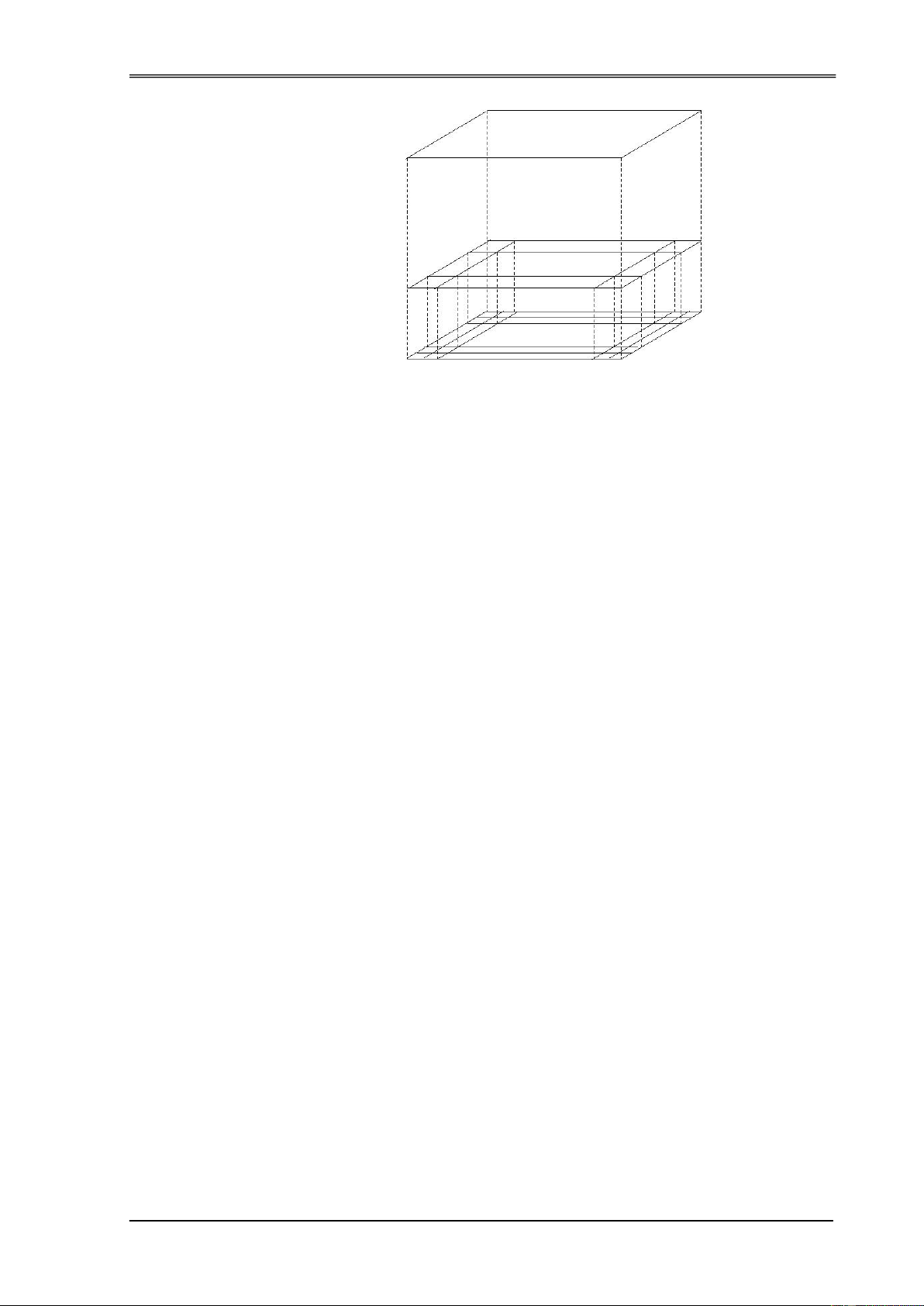

Hình 2.24. DENCLUE với hàm phân phối Gaussian ..................................

53 Hình 2.25. Mô hình cấu trúc dữ liệu lưới

.................................................... 55

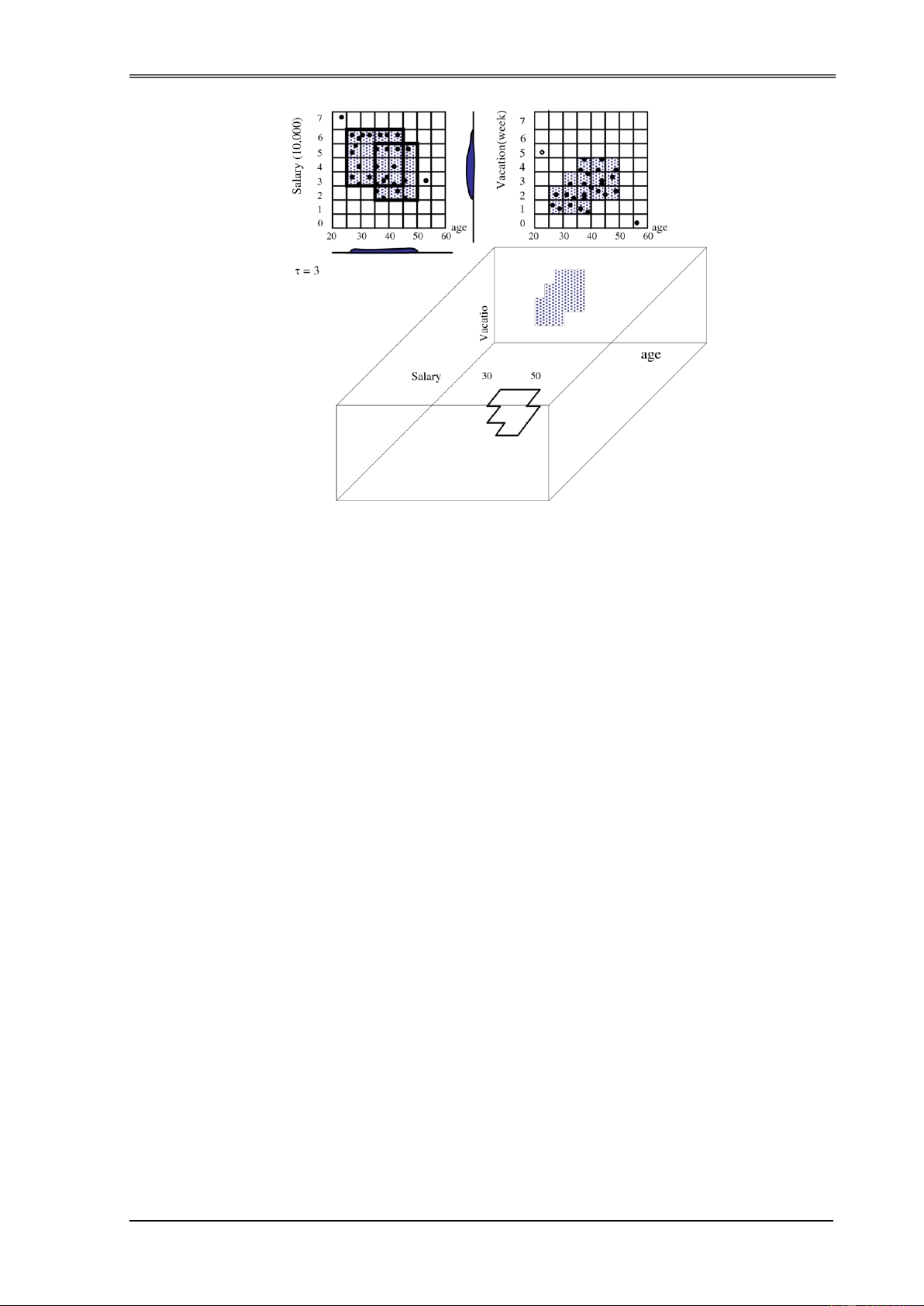

Hình 2.26. Thuật toán CLIQUE .................................................................. 56

Hình 2.27. Quá trình nhận dạng các ô của CLIQUE ................................... 57

Hình 3.1. Phân loại khai phá Web ............................................................... 62

Hình 3.2. Quá trình khai phá văn bản Web ................................................. 64

Hình 3.3. Thuật toán phân lớp K-Nearest Neighbor ...................................

67 Hình 3.4. Thuật toán phân cụm phân cấp

.................................................... 67

Hình 3.5. Thuật toán phân cụm phân hoạch ................................................ 68

Hình 3.6. Kiến trúc tổng quát của khai phá theo sử dụng Web .................. 70

Hình 3.7. Minh họa nội dung logs file ......................................................... 72

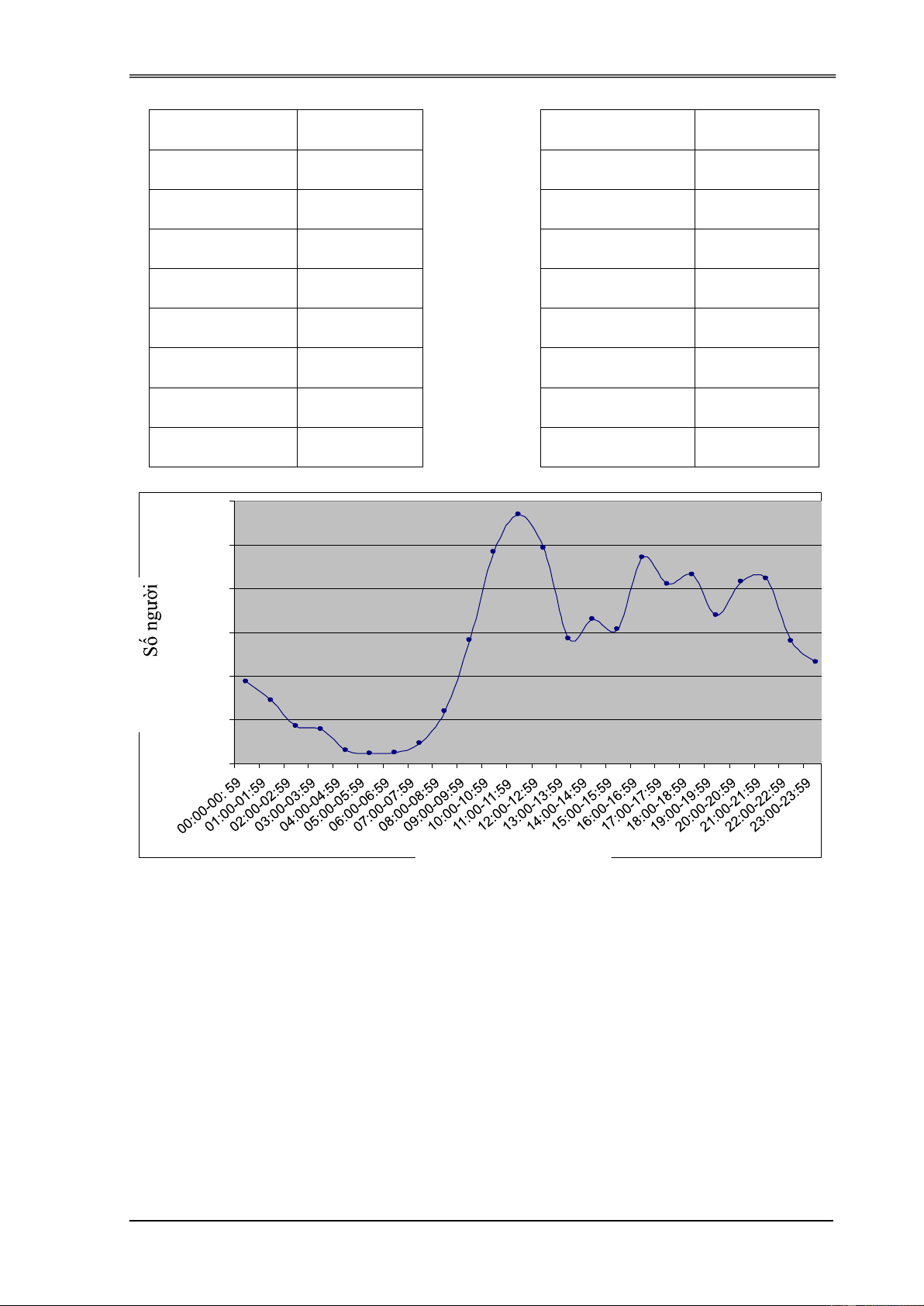

Hình 3.8. Phân tích người dùng truy cập Web ............................................ 77

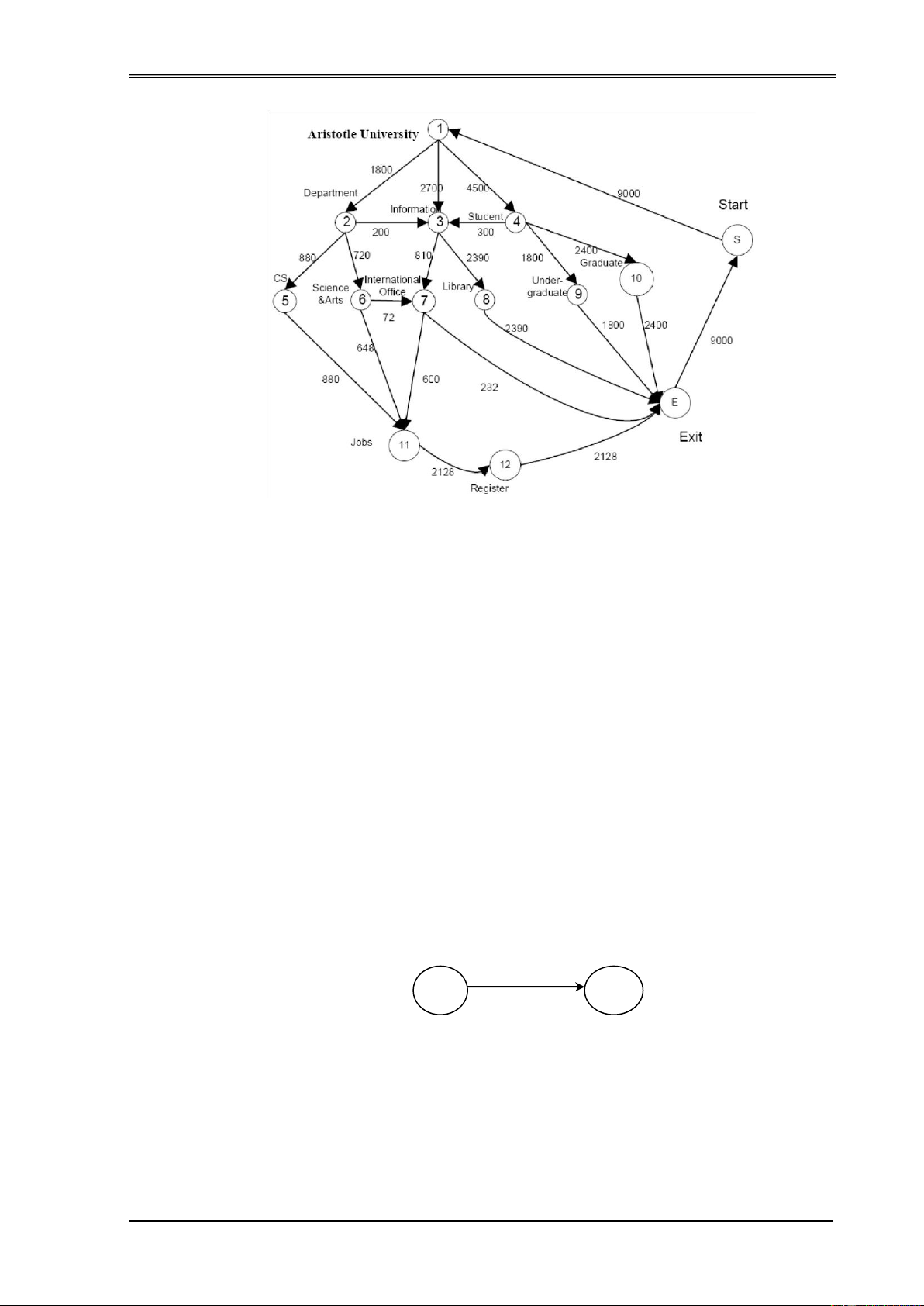

Hình 3.9. Đồ thi liên kết Web ...................................................................... 78

Hình 3.10. Quan hệ trực tiếp giữa 2 trang ................................................... 79

Hình 3.11. Độ tương tự ồng trích dẫn ....................................................... 79 lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm

Hình 3.12. Độ tương tự chỉ mục .................................................................. 79

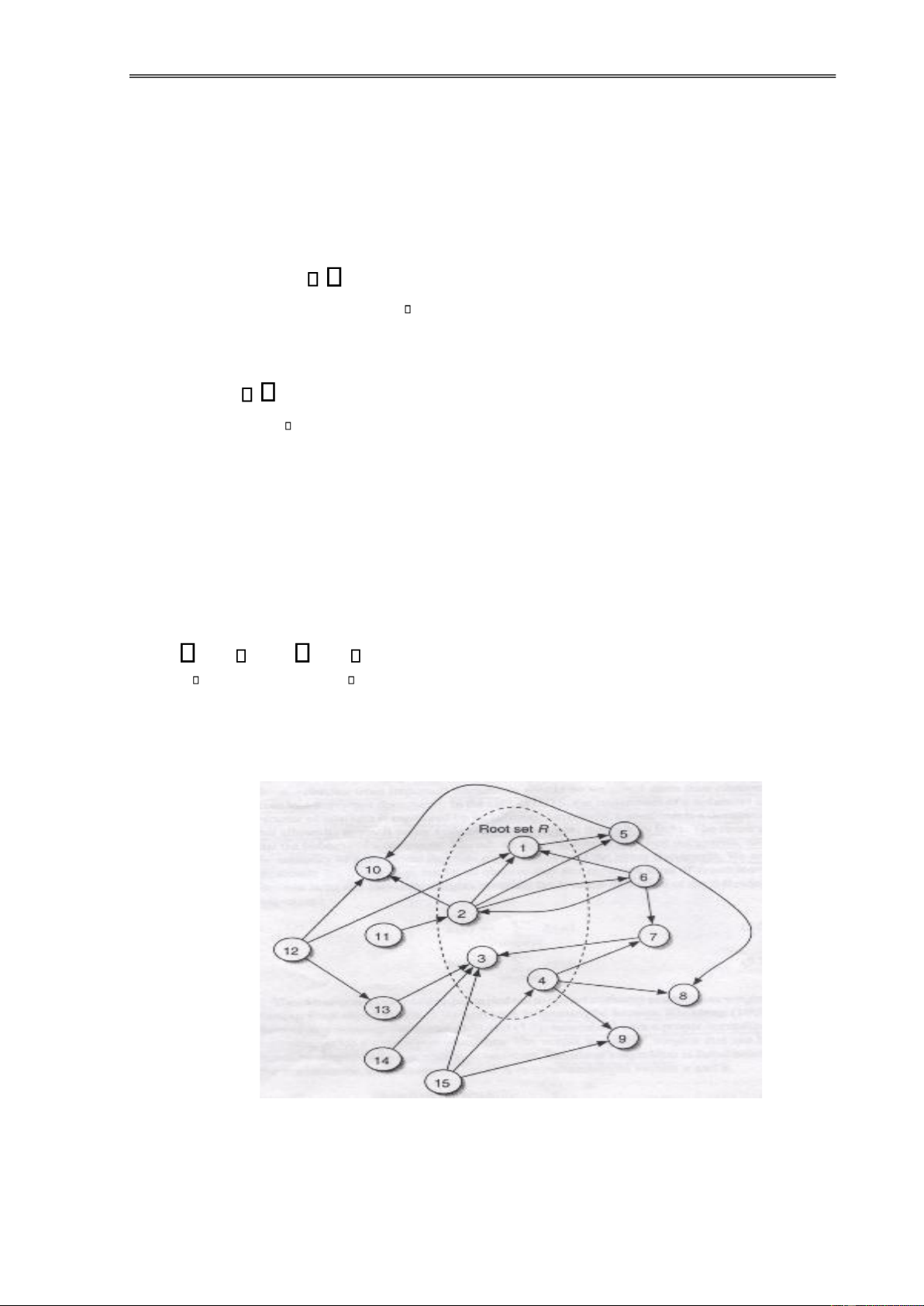

Hình 3.13. Cộng ồng Web ......................................................................... 80

Hình 3.14. Kết quả của thuật toán PageRank .............................................. 81

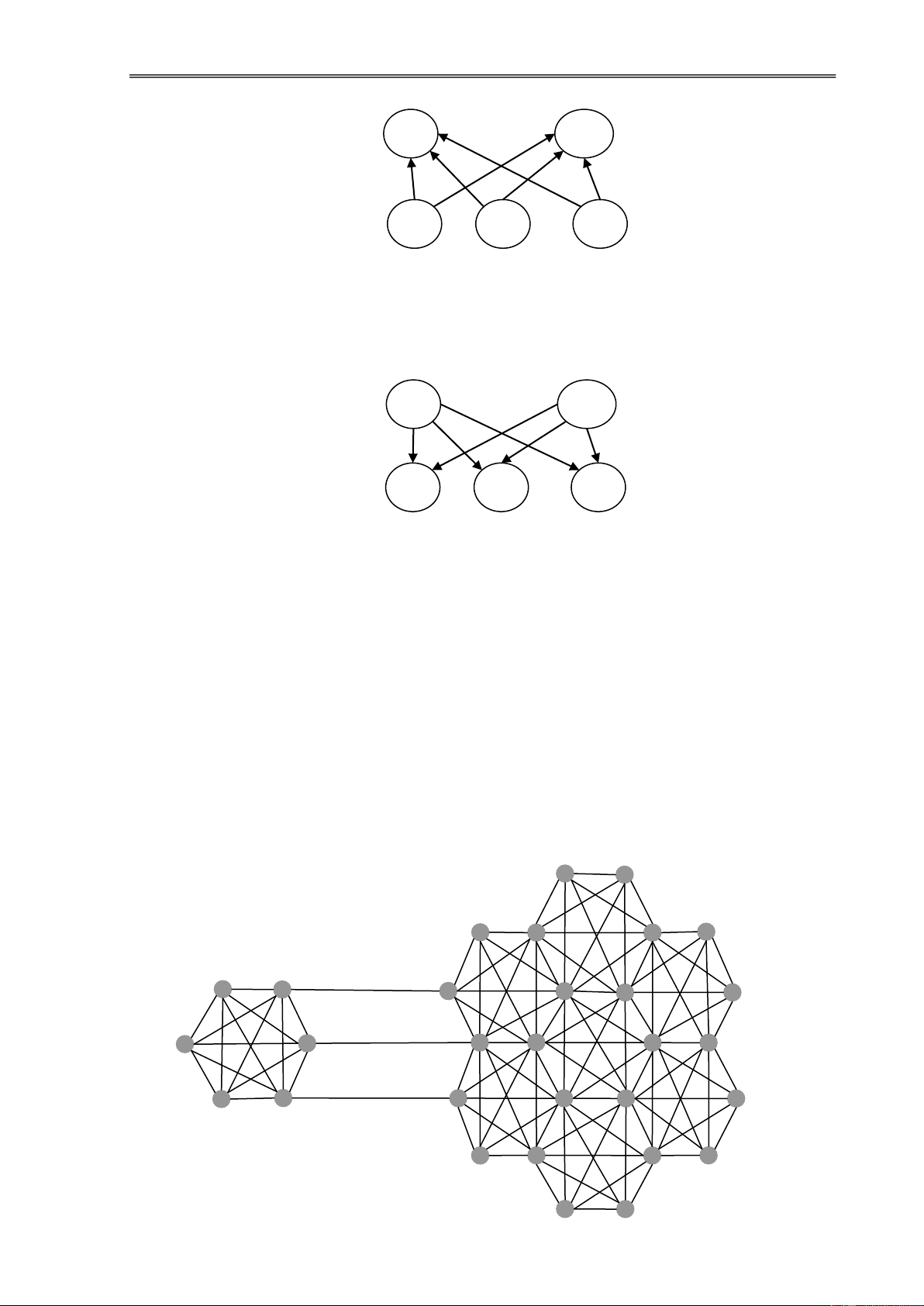

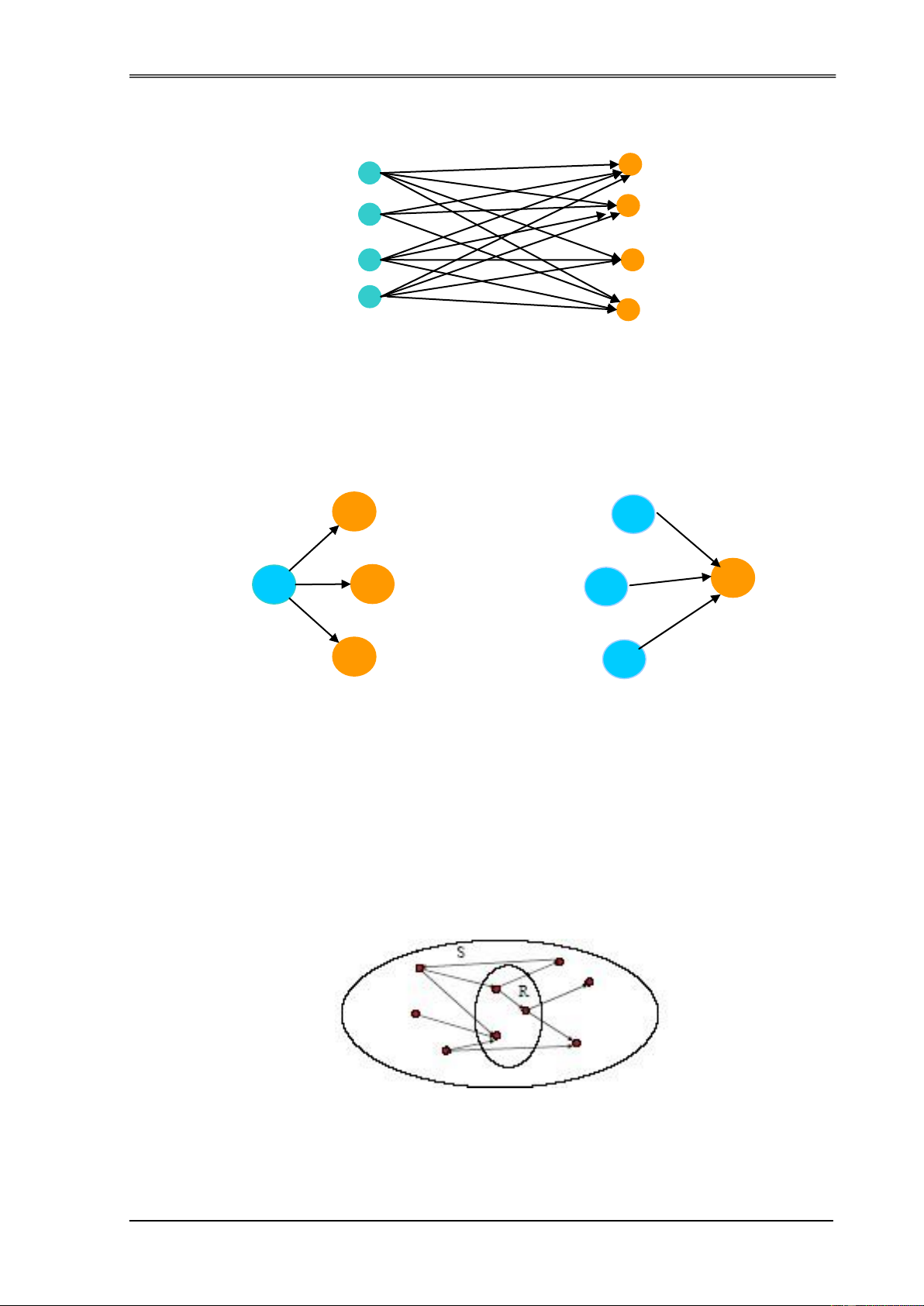

Hình 3.15. Đồ thị phân ôi của Hub và Authority ...................................... 82

Hình 3.16. Sự kết hợp giữa Hub và Authority ............................................ 83

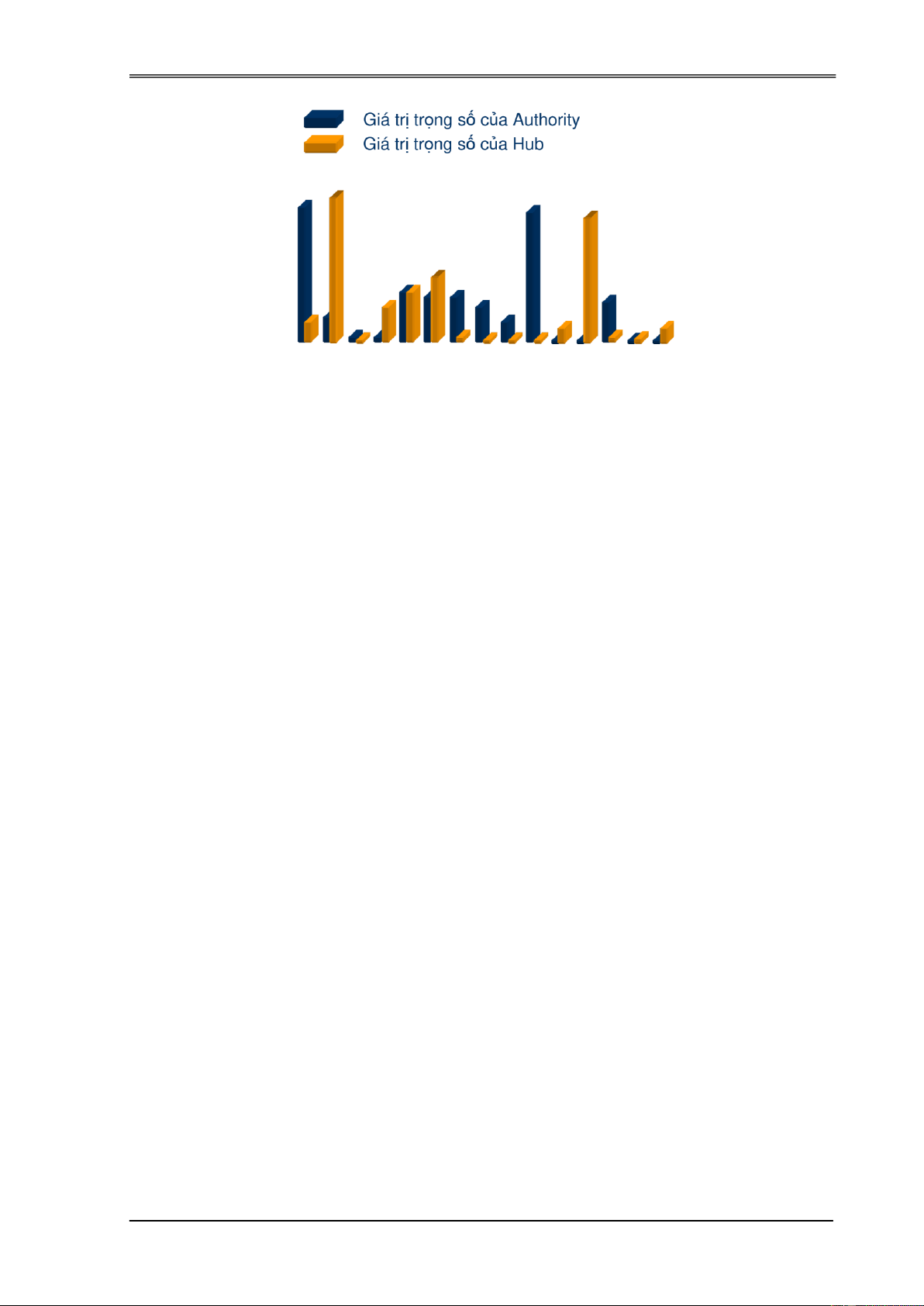

Hình 3.17. Đồ thị Hub-Authority ................................................................ 84

Hình 3.18. Giá trị trọng số các Hub và Authority ....................................... 84

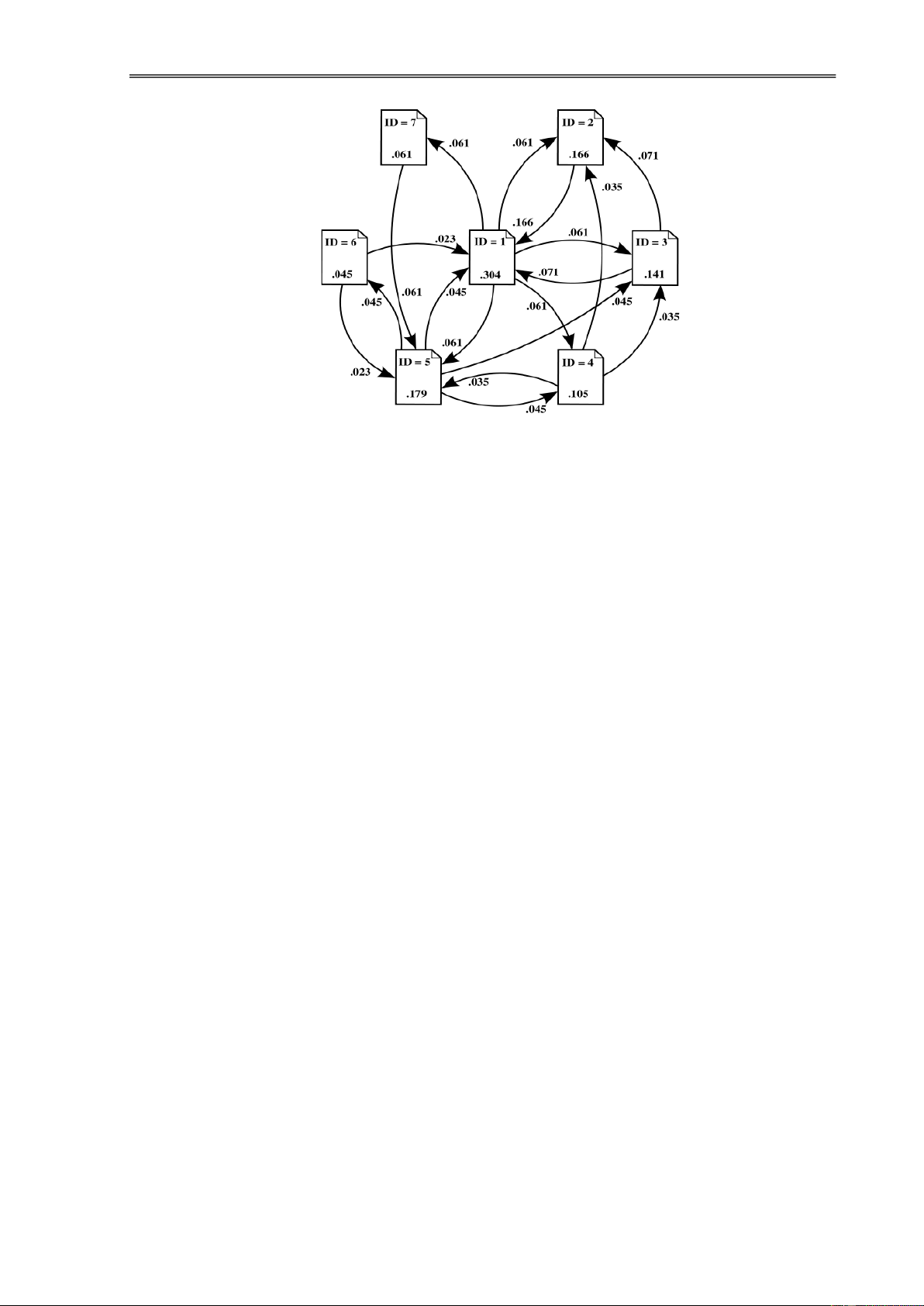

Hình 3.19. Thuật toán ánh trọng số cụm và trang ..................................... 86

Hình 3.20. Các bước phân cụm kết quả tìm kiếm trên Web ....................... 87

Hình 3.21. Thuật toán k-means trong phân cụm nội dung tài liệu Web ..... 91

DANH SÁCH CÁC BẢNG BIỂU Bảng 1.1. Bảng tham số thuộc tính nhị

phân ......................................................................... Error! Bookmark not defined.

Bảng 1.2. Thống kê các từ tần số xuất hiện cao .......................................... 23

Bảng 3.1. Thống kê số người dùng tại các thời gian khác nhau ................. 72

Bảng 3.2. Bảng o thời gian thực hiện thuật toán phân cụm ........................ 87

CÁC CỤM TỪ VIẾT TẮT

STT Viết tắt

Cụm từ tiếng Anh

Cụm từ tiếng Việt 1 CNTT Information Technology Công nghệ thông tin 2 CSDL Database Cơ sở dữ liệu Khám phá tri thức trong 3

KDD Knowledge Discovery in Database cơ sở dữ liệu lOMoAR cPSD| 39651089

Khai phá dữ liệu Web bằng kỹ thuật phân cụm 4 KPDL Data mining Khai phá dữ liệu 5 KPVB Text Mining Khai phá văn bản 6 PCDL Data Clustering Phân cụm dữ liệu lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm LỜI MỞ ĐẦU

Trong những năm gần ây cùng với phát triển nhanh chóng của khoa học kỹ

thuật là sự bùng nỗ về tri thức. Kho dữ liệu, nguồn tri thức của nhân loại cũng trở

nên ồ sộ, vô tận làm cho vấn ề khai thác các nguồn tri thức ó ngày càng trở nên

nóng bỏng và ặt ra thách thức lớn cho nền công nghệ thông tin thế giới.

Cùng với những tiến bộ vượt bậc của công nghệ thông tin là sự phát triển

mạnh mẽ của mạng thông tin toàn cầu, nguồn dữ liệu Web trở thành kho dữ liệu

khổng lồ. Nhu cầu về tìm kiếm và xử lý thông tin, cùng với yêu cầu về khả năng

kịp thời khai thác chúng ể mạng lại những năng suất và chất lượng cho công tác

quản lý, hoạt ộng kinh doanh,… ã trở nên cấp thiết trong xã hội hiện ại. Nhưng

vấn ề tìm kiếm và sử dụng nguồn tri thức ó như thế nào ể phục vụ cho công việc

của mình lại là một vấn ề khó khăn ối với người sử dụng. Để áp ứng phần nào yêu

cầu này, người ta ã xây dựng các công cụ tìm kiếm và xử lý thông tin nhằm giúp

cho người dùng tìm kiếm ược các thông tin cần thiết cho mình, nhưng với sự rộng

lớn, ồ sộ của nguồn dữ liệu trên Internet ã làm cho người sử dụng cảm thấy khó

khăn trước những kết quả tìm ược.

Với các phương pháp khai thác cơ sở dữ liệu truyền thống chưa áp ứng ược

các yêu cầu ó. Để giải quyết vấn ề này, một hướng i mới ó là nghiên cứu và áp

dụng kỹ thuật khai phá dữ liệu và khám phá tri thức trong môi trường Web. Do ó,

việc nghiên cứu các mô hình dữ liệu mới và áp dụng các phương pháp khai phá

dữ liệu trong khai phá tài nguyên Web là một xu thế tất yếu vừa có ý nghĩa khoa

học vừa mang ý nghĩa thực tiễn cao.

Vì vậy, tác giả chọn ề tài “Khai phá dữ liệu Web bằng kỹ thuật phân cụm” ể

làm luận văn tốt nghiệp cho mình.

Bố cục luận văn gồm 3 chương:

Chương 1 trình bày một cách tổng quan các kiến thức cơ bản về khai phá dữ

liệu và khám phá tri thức, khai phá dữ liệu trong môi trường Web; một số vấn ề

về biểu diễn và xử lý dữ liệu văn bản áp dụng trong khai phá dữ liệu Web. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Chương 2 giới thiệu một số kỹ thuật phân cụm dữ liệu phổ biến và thường

ược sử dụng trong lĩnh vực khai phá dữ liệu và khám phá tri thức.

Chương 3 trình bày một số hướng nghiên cứu trong khai phá dữ liệu Web

như khai phá tài liệu Web, khai phá theo sử dụng Web, khai phá cấu trúc Web và

tiếp cận theo hướng sử dụng các kỹ thuật phân cụm dữ liệu ể giải quyết bài toán

khai phá dữ liệu Web. Trong phần này cũng trình bày một mô hình áp dụng kỹ

thuật phân cụm dữ liệu trong tìm kiếm và phân cụm tài liệu Web.

Phần kết luận của luận văn tổng kết lại những vấn ề ã nghiên cứu, ánh giá kết

quả nghiên cứu, hướng phát triển của ề tài.

Phần phụ lục trình bày một số oạn mã lệnh xử lý trong chương trình và một

số giao diện trong chương trình mô phỏng.

Chương 1. TỔNG QUAN VỀ KHAI PHÁ DỮ LIỆU

1.1. Khai phá dữ liệu và phát hiện tri thức

1.1.1. Khai phá dữ liệu

Cuối thập kỷ 80 của thế kỷ 20, sự phát triển rộng khắp của các CSDL ã tạo

ra sự bùng nổ thông tin trên toàn cầu, vào thời gian này người ta bắt ầu ề cập ến

khái niệm khủng hoảng trong việc phân tích dữ liệu tác nghiệp ể cung cấp thông

tin với yêu cầu chất lượng ngày càng cao cho người làm quyết ịnh trong các tổ

chức chính phủ, tài chính, thương mại, khoa học,…

Đúng như John Naisbett ã cảnh báo “Chúng ta ang chìm ngập trong dữ liệu

mà vẫn ói tri thức”. Lượng dữ liệu khổng lồ này thực sự là một nguồn tài nguyên

có nhiều giá trị bởi thông tin là yếu tố then chốt phục vụ cho mọi hoạt ộng quản

lý, kinh doanh, phát triển sản xuất và dịch vụ, … nó giúp người iều hành và quản

lý có những hiểu biết về môi trường và tiến trình hoạt ộng của tổ chức mình trước

khi ra quyết ịnh ể tác ộng ến quá trình hoạt ộng nhằm ạt ược các mục tiêu một

cách hiệu quả và bền vững.

KPDL là một lĩnh vực mới ược nghiên cứu, nhằm tự ộng khai thác thông tin,

tri thức mới hữu ích, tiềm ẩn từ những CSDL lớn cho các ơn vị, tổ chức, doanh Hoàng Văn Dũng 2 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

nghiệp,…. từ ó làm thúc ẩy khả năng sản xuất, kinh doanh, cạnh tranh cho các ơn

vị, tổ chức này. Các kết quả nghiên cứu khoa học cùng những ứng dụng thành

công trong KDD cho thấy KPDL là một lĩnh vực phát triển bền vững, mang lại

nhiều lợi ích và có nhiều triển vọng, ồng thời có ưu thế hơn hẵn so với các công

cụ tìm kiếm phân tích dữ liệu truyền thống. Hiện nay, KPDL ã ứng dụng ngày

càng rộng rãi trong các lĩnh vực như thương mại, tài chính, y học, viễn thông, tin – sinh,….

Các kỹ thuật chính ược áp dụng trong lĩnh vực KPDL phần lớn ược thừa kế

từ lĩnh vực CSDL, học máy, trí tuệ nhân tạo, lý thuyết thông tin, xác suất thống kê

và tính toán hiệu năng cao,...

Như vậy ta có thể khái quát hóa khái niệm KPDL là một quá trình tìm kiếm,

phát hiện các tri thức mới, hữu ích, tiềm ẩn trong CSDL lớn.

KDD là mục tiêu chính của KPDL, do vậy hai khái niệm KPDL và KDD ược

các nhà khoa học trên hai lĩnh vực xem là tương ương với nhau. Thế nhưng nếu

phân chia một cách chi tiết thì KPDL là một bước chính trong quá trình KDD.

1.1.2. Quá trình khám phá tri thức

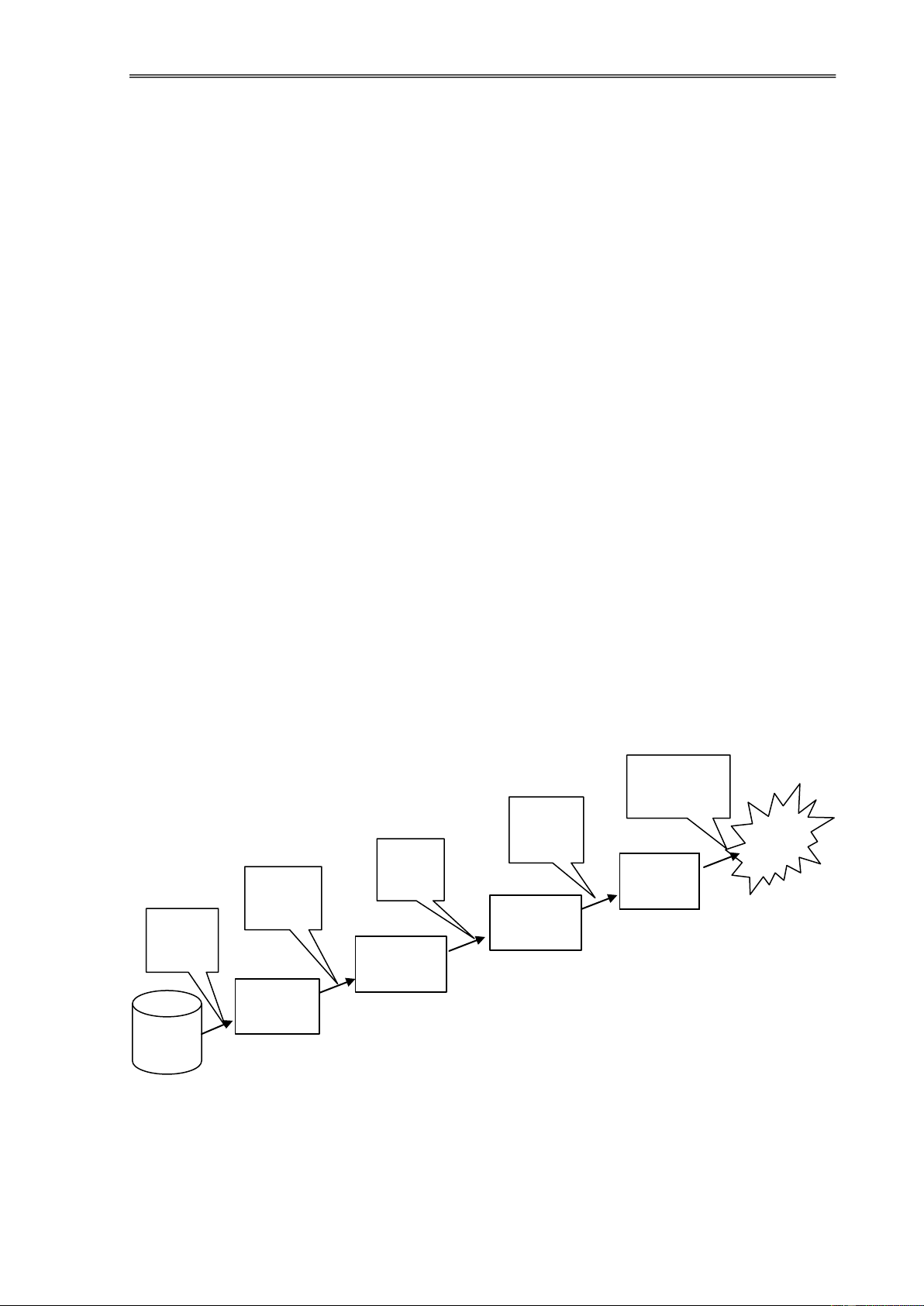

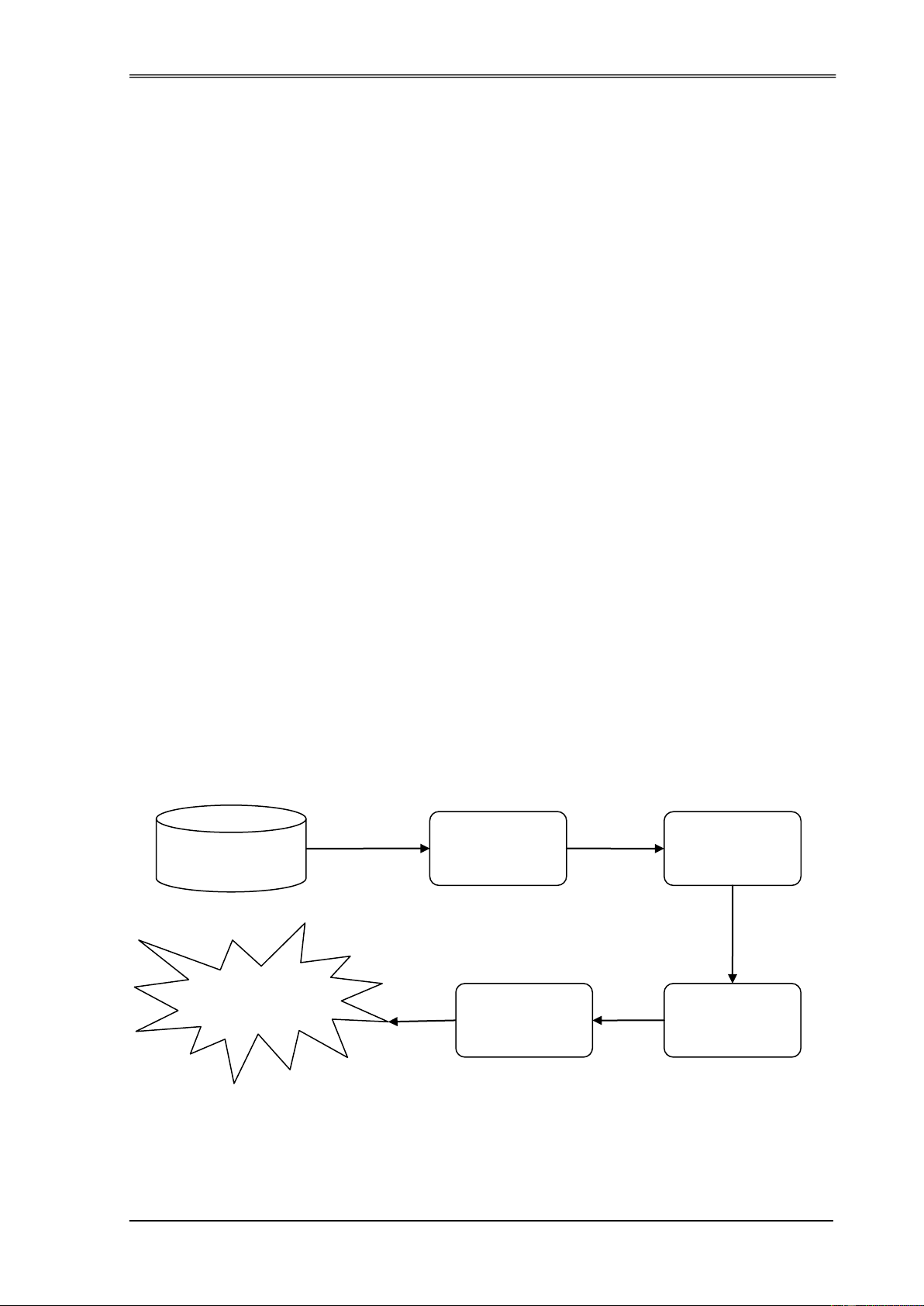

Quá trình khá phá tri thức có thể chia thành 5 bước như sau [10]: Đánh giá, biểu diễn Khai Tri phá Biến thức Các mẫu Tiền ổi xử lý Dữ liệu Trích biến ổi chọn Dữ liệu tiền xử lý Dữ liệu lựa chọn Dữ liệu thô

Hình 1.1. Quá trình khám phá tri thức Quá

trình KPDL có thể phân thành các giai oạn sau [10]:

Trích chọn dữ liệu: Đây là bước trích chọn những tập dữ liệu cần ược khai

phá từ các tập dữ liệu lớn ban ầu theo một số tiêu chí nhất ịnh. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Tiền xử lý dữ liệu: Đây là bước làm sạch dữ liệu (xử lý những dữ liệu không

ầy ủ, nhiễu, không nhất quán,...), rút gọn dữ liệu (sử dụng hàm nhóm và tính tổng,

các phương pháp nén dữ liệu, sử dụng histograms, lấy mẫu,...), rời rạc hóa dữ liệu

(rời rạc hóa dựa vào histograms, dựa vào entropy, dựa vào phân khoảng,...). Sau

bước này, dữ liệu sẽ nhất quán, ầy ủ, ược rút gọn và ược rời rạc hóa.

Biến ổi dữ liệu: Đây là bước chuẩn hóa và làm mịn dữ liệu ể ưa dữ liệu

về dạng thuận lợi nhất nhằm phục vụ quá trình khai phá ở bước sau.

Khai phá dữ liệu: Đây là bước áp dụng những kỹ thuật phân tích (như các kỹ

thuật của học máy) nhằm ể khai thác dữ liệu, trích chọn ược những mẫu thông tin,

những mối liên hệ ặc biệt trong dữ liệu. Đây ược xem là bước quan trọng và tốn

nhiều thời gian nhất của toàn quá trình KDD.

Đánh giá và biểu diễn tri thức: Những mẫu thông tin và mối liên hệ trong dữ

liệu ã ược khám phá ở bước trên ược biến ổi và biểu diễn ở một dạng gần gũi với

người sử dụng như ồ thị, cây, bảng biểu, luật,... Đồng thời bước này cũng ánh giá

những tri thức khám phá ược theo những tiêu chí nhất ịnh.

1.1.3. Khai phá dữ liệu và các lĩnh vực liên quan

KPDL là một lĩnh vực liên quan tới thống kê, học máy, CSDL, thuật toán,

tính toán song song, thu nhận tri thức từ hệ chuyên gia và dữ liệu trừu tượng. Đặc

trưng của hệ thống khám phá tri thức là nhờ vào các phương pháp, thuật toán và

kỹ thuật từ những lĩnh vực khác nhau ể KPDL.

Lĩnh vực học máy và nhận dạng mẫu trong KDD nghiên cứu các lý thuyết và

thuật toán của hệ thống ể trích ra các mẫu và mô hình từ dữ liệu lớn. KDD tập

trung vào việc mở rộng các lý thuyết và thuật toán cho các vấn ề tìm ra các mẫu

ặc biệt (hữu ích hoặc có thể rút ra tri thức quan trọng) trong CSDL lớn.

Ngoài ra, KDD có nhiều iểm chung với thống kê, ặc biệt là phân tích dữ liệu

thăm dò (Exploratory Data Analysis - EDA). Hệ thống KDD thường gắn những

thủ tục thống kê cho mô hình dữ liệu và tiến trình nhiễu trong khám phá tri thức nói chung. Hoàng Văn Dũng 4 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Một lĩnh vực liên quan khác là phân tích kho dữ liệu. Phương pháp phổ biến

ể phân tích kho dữ liệu là OLAP (On-Line Analytical Processing). Các công cụ

OLAP tập trung vào phân tích dữ liệu a chiều.

1.1.4. Các kỹ thuật áp dụng trong khai phá dữ liệu

KDD là một lĩnh vực liên ngành, bao gồm: Tổ chức dữ liệu, học máy, trí tuệ

nhân tạo và các khoa học khác. Sự kết hợp này có thể ược diễn tả như sau: Các lĩnh vực khoa học khác Học máy và Tổ chức dữ liệu trí tuệ nhân tạo

Hình 1.2. Các lĩnh vực liên quan ến khám phá tri thức trong CSDL

Đứng trên quan iểm của học máy, thì các kỹ thuật trong KPDL, bao gồm:

Học có giám sát: Là quá trình gán nhãn lớp cho các phần tử trong CSDL dựa

trên một tập các ví dụ huấn luyện và các thông tin về nhãn lớp ã biết.

Học không có giám sát: Là quá trình phân chia một tập dữ liệu thành các lớp

hay cụm dữ liệu tương tự nhau mà chưa biết trước các thông tin về lớp hay tập các

ví dụ huấn luyện.

Học nửa giám sát: Là quá trình phân chia một tập dữ liệu thành các lớp dựa

trên một tập nhỏ các ví dụ huấn luyện và các thông tin về một số nhãn lớp ã biết trước.

+ Nếu căn cứ vào lớp các bài toán cần giải quyết, thì KPDL bao gồm các kỹ thuật áp dụng sau [10]:

Phân lớp và dự báo: Xếp một ối tượng vào một trong những lớp ã biết trước.

Ví dụ như phân lớp các dữ liệu bệnh nhân trong hồ sơ bệnh án. Hướng tiếp cận

này thường sử dụng một số kỹ thuật của học máy như cây quyết ịnh, mạng nơron

nhân tạo,... Phân lớp và dự báo còn ược gọi là học có giám sát. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Luật kết hợp: Là dạng luật biểu diễn tri thức ở dạng khá ơn giản. Ví dụ: “60

% nữ giới vào siêu thị nếu mua phấn thì có tới 80% trong số họ sẽ mua thêm son”.

Luật kết hợp ược ứng dụng nhiều trong lĩnh vực kinh doanh, y học, tinsinh, tài

chính và thị trường chứng khoán,...

Phân tích chuỗi theo thời gian: Tương tự như khai phá luật kết hợp nhưng có

thêm tính thứ tự và tính thời gian. Hướng tiếp cận này ược ứng dụng nhiều trong

lĩnh vực tài chính và thị trường chứng khoán vì nó có tính dự báo cao.

Phân cụm: Xếp các ối tượng theo từng cụm dữ liệu tự nhiên. Phân cụm còn

ược gọi là học không có giám sát.

Mô tả và tóm tắt khái niệm: Thiên về mô tả, tổng hợp và tóm tắt khái niệm,

ví dụ như tóm tắt văn bản.

Do KPDL ược ứng dụng rộng rãi nên nó có thể làm việc với rất nhiều kiểu

dữ liệu khác nhau. Sau ây là một số dạng dữ liệu iển hình: Dữ liệu quan hệ, dữ

liệu a chiều, dữ liệu dạng giao dịch, dữ liệu quan hệ - hướng ối tượng, dữ liệu

không gian và thời gian, dữ liệu chuỗi thời gian, dữ liệu a phương tiện, dữ liệu văn bản và Web,…

1.1.5. Những chức năng chính của khai phá dữ liệu

Hai mục tiêu chính của KPDL là mô tả và dự báo. Dự báo là dùng một số

biến hoặc trường trong CSDL ể dự oán ra các giá trị chưa biết hoặc sẽ có của các

biến quan trọng khác. Việc mô tả tập trung vào tìm kiếm các mẫu mà con người

có thể hiểu ược ể mô tả dữ liệu. Trong lĩnh vực KDD, mô tả ược quan tâm nhiều

hơn dự báo, nó ngược với các ứng dụng học máy và nhận dạng mẫu mà trong ó

việc dự báo thường là mục tiêu chính. Trên cơ sở mục tiêu chính của KPDL, các

chức năng chính của KDD gồm:

Mô tả lớp và khái niệm: Dữ liệu có thể ược kết hợp trong lớp và khái niệm.

Thí dụ, trong kho dữ liệu bán hàng thiết bị tin học, các lớp mặt hàng bao gồm máy

tính, máy in,…và khái niệm khách hàng bao gồm khách hàng mua sỉ và khách

mua lẻ. Việc mô tả lớp và khái niệm là rất hữu ích cho giai oạn tổng hợp, tóm lược

và chính xác hoá. Mô tả lớp và khái niệm ược bắt nguồn từ ặc trưng hoá dữ liệu

và phân biệt dữ liệu. Đặc trưng hoá dữ liệu là quá trình tổng hợp những ặc tính Hoàng Văn Dũng 6 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

hoặc các thành phần chung của một lớp dữ liệu mục tiêu. Phân biệt dữ liệu là so

sánh lớp dữ liệu mục tiêu với những lớp dữ liệu ối chiếu khác. Lớp dữ liệu mục

tiêu và các lớp ối chiếu là do người dùng chỉ ra và tương ứng với các ối tượng dữ

liệu nhận ược nhờ truy vấn.

Phân tích sự kết hợp: Phân tích sự kết hợp là khám phá các luật kết hợp thể

hiện mối quan hệ giữa các thuộc tính giá trị mà ta nhận biết ược nhờ tần suất xuất

hiện cùng nhau của chúng. Các luật kết hợp có dạng X Y , tức là A1 .... An B1

..... Bm , trong ó Ai (i=1,..., n) và Bj (j=1,...,m) là các cặp thuộc tính giá trị. Luật

kết hợp dạng X Y có thể ược hiểu là “dữ liệu thoã mãn các iều kiện của X thì cũng

sẽ thoả các iều kiện của Y”.

Phân lớp và dự báo: Phân lớp là quá trình tìm kiếm một tập các mô hình

hoặc chức năng mà nó mô tả và phân biệt nó với các lớp hoặc khái niệm khác.

Các mô hình này nhằm mục ích dự báo về lớp của một số ối tượng. Việc xây dựng

mô hình dựa trên sự phân tích một tập các dữ liệu ược huấn luyện có nhiều dạng

thể hiện mô hình như luật phân lớp (IF-THEN), cây quyết ịnh, công thức toán học

hay mạng nơron,... Sự phân lớp ược sử dụng ể dự oán nhãn lớp của các ối tượng

trong dữ liệu. Tuy nhiên trong nhiều ứng dụng, người ta mong muốn dự oán những

giá trị khuyết thiếu nào ó. Thông thường ó là trường hợp dự oán các giá trị của dữ

liệu kiểu số. Trước khi phân lớp và dự báo, có thể cần thực hiện phân tích thích

hợp ể xác ịnh và loại bỏ các thuộc tính không tham gia vào quá trình phân lớp và dự báo.

Phân cụm: Không giống như phân lớp và dự báo, phân cụm phân tích các ối

tượng dữ liệu khi chưa biết nhãn của lớp. Nhìn chung, nhãn lớp không tồn tại

trong suốt quá trình huấn luyện dữ liệu, nó phân cụm có thể ược sử dụng ể ưa ra

nhãn của lớp. Sự phân cụm thực hiện nhóm các ối tượng dữ liệu theo nguyên tắc:

Các ối tượng trong cùng một nhóm thì giống nhau hơn các ối tượng khác nhóm.

Mỗi cụm ược tạo thành có thể ược xem như một lớp các ối tượng mà các luật ược

lấy ra từ ó. Dạng của cụm ược hình thành theo một cấu trúc phân cấp của các lớp

mà mỗi lớp là một nhóm các sự kiện tương tự nhau. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Phân tích các ối tượng ngoài cuộc: Một CSDL có thể chứa các ối tượng

không tuân theo mô hình dữ liệu. Các ối tượng như vậy gọi là ối tượng ngoài cuộc.

Hầu hết các phương pháp KPDL ều coi các ối tượng ngoài cuộc là nhiễu và loại

bỏ chúng. Tuy nhiên trong một số ứng dụng, chẳng hạn như phát hiện nhiễu, thì

sự kiện hiếm khi xảy ra lại ược chú ý hơn những gì thường xuyên gặp phải. Sự

phân tích dữ liệu ngoài cuộc ược coi như là sự khai phá các ối tượng ngoài cuộc.

Một số phương pháp ược sử dụng ể phát hiện ối tượng ngoài cuộc: sử dụng các

test mang tính thống kê trên cơ sở một phân phối dữ liệu hay một mô hình xác

suất cho dữ liệu, dùng các ộ o khoảng cách mà theo ó các ối tượng có một khoảng

cách áng kể ến cụm bất kì khác ược coi là ối tượng ngoài cuộc, dùng các phương

pháp dựa trên ộ lệch ể kiểm tra sự khác nhau trong những ặc trưng chính của các nhóm ối tượng.

Phân tích sự tiến hoá: Phân tích sự tiến hoá thực hiện việc mô tả và mô hình

hoá các qui luật hay khuynh hướng của những ối tượng mà hành vi của chúng thay

ổi theo thời gian. Phân tích sự tiến hoá có thể bao gồm cả ặc trưng hoá, phân biệt,

tìm luật kết hợp, phân lớp hay PCDL liên quan ến thời gian, phân tích dữ liệu theo

chuỗi thời gian, so sánh mẫu theo chu kỳ và phân tích dữ liệu dựa trên ộ tương tự.

1.1.6. Ứng dụng của khai phá dữ liệu

KPDL là một lĩnh vực ược quan tâm và ứng dụng rộng rãi. Một số ứng dụng

iển hình trong KPDL có thể liệt kê như sau: Phân tích dữ liệu và hỗ trợ ra quyết

ịnh, iều trị y học, KPVB, khai phá Web, tin-sinh, tài chính và thị trường chứng khoán, bảo hiểm,...

Thương mại: Như phân tích dữ liệu bán hàng và thị trường, phân tích ầu tư,

phát hiện gian lận, chứng thực hóa khách hàng, dự báo xu hướng phát triển,...

Thông tin sản xuất: Điều khiển, lập kế hoạch, hệ thống quản lý, phân tích thử nghiệm,...

Thông tin khoa học: Dự báo thời tiết, bảo lụt, ộng ất, tin sinh học,...

Hiện nay các hệ quản trị CSDL ã tích hợp những modul ể KPDL như SQL

Server, Oracle, ến năm 2007 Microsoft ã cung cấp sẵn công cụ KPDL tích hợp

trong cả MS-Word, MS-Excel,.. Hoàng Văn Dũng 8 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Hình 1.3. Trực quan hóa kết quả KPDL trong Oracle

1.2. Kỹ thuật phân cụm trong khai phá dữ liệu

1.2.1. Tổng quan về kỹ thuật phân cụm

Mục ích chính của PCDL nhằm khám phá cấu trúc của mẫu dữ liệu ể thành

lập các nhóm dữ liệu từ tập dữ liệu lớn, theo ó nó cho phép người ta i sâu vào phân

tích và nghiên cứu cho từng cụm dữ liệu này nhằm khám phá và tìm kiếm các

thông tin tiềm ẩn, hữu ích phục vụ cho việc ra quyết ịnh. Ví dụ “nhóm các khách

hàng trong CSDL ngân hàng có vốn các ầu tư vào bất ộng sản cao”… Như vậy,

PCDL là một phương pháp xử lý thông tin quan trọng và phổ biến, nó nhằm khám

phá mối liên hệ giữa các mẫu dữ liệu bằng cách tổ chức chúng thành các cụm.

Ta có thể khái quát hóa khái niệm PCDL [10][19]: PCDL là một kỹ thuật

trong KPDL, nhằm tìm kiếm, phát hiện các cụm, các mẫu dữ liệu tự nhiên, tiềm

ẩn, quan trọng trong tập dữ liệu lớn từ ó cung cấp thông tin, tri thức hữu ích cho việc ra quyết ịnh.

Như vậy, PCDL là quá trình phân chia một tập dữ liệu ban ầu thành các cụm

dữ liệu sao cho các phần tử trong một cụm "tương tự" với nhau và các phần tử

trong các cụm khác nhau sẽ "phi tương tự" với nhau. Số các cụm dữ liệu ược phân

ở ây có thể ược xác ịnh trước theo kinh nghiệm hoặc có thể ược tự ộng xác ịnh

của phương pháp phân cụm. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Độ tương tự ược xác ịnh dựa trên giá trị các thuộc tính mô tả ối tượng. Thông

thường, phép o khoảng cách thường ược sử dụng ể ánh giá ộ tương tự hay phi tương tự.

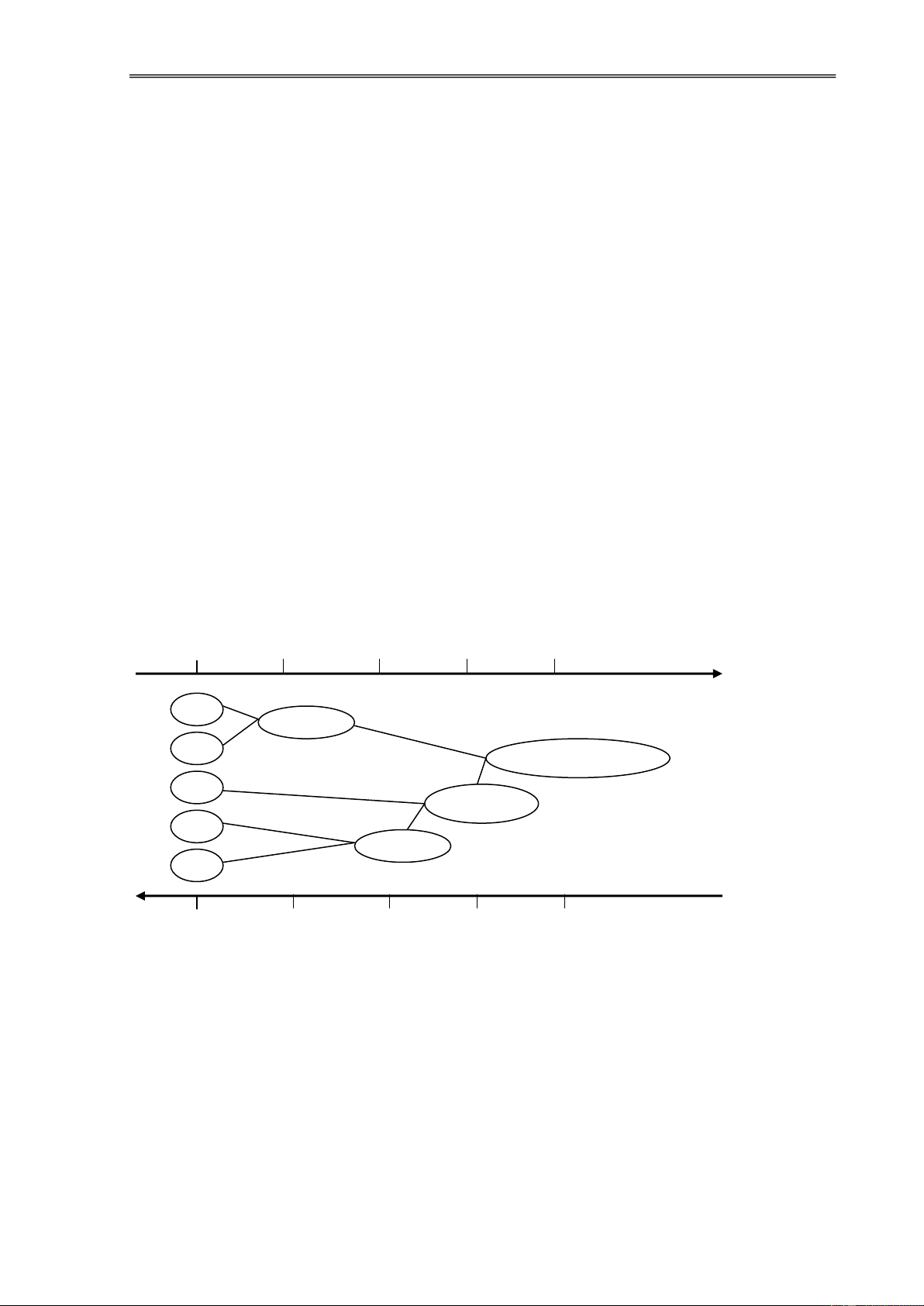

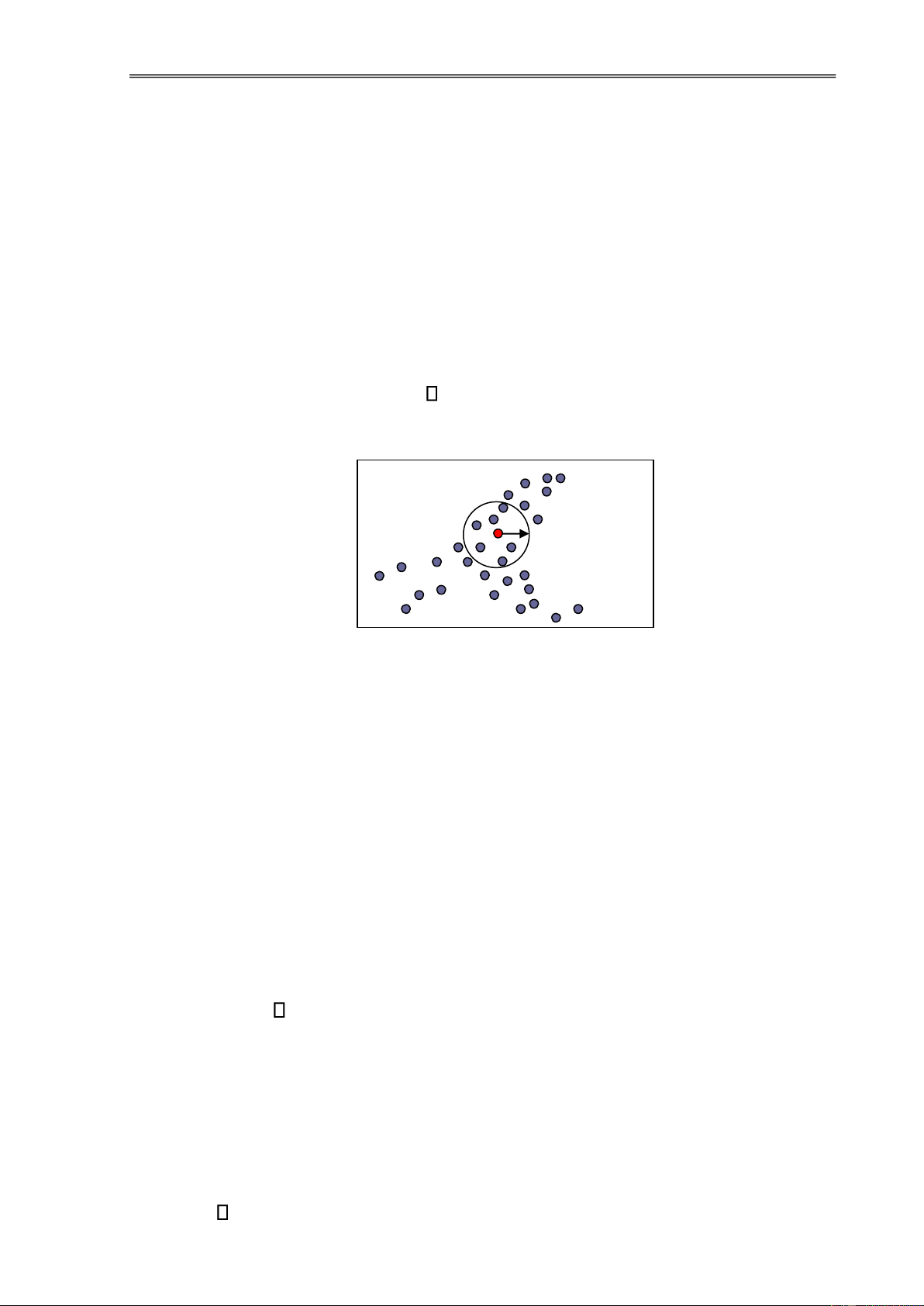

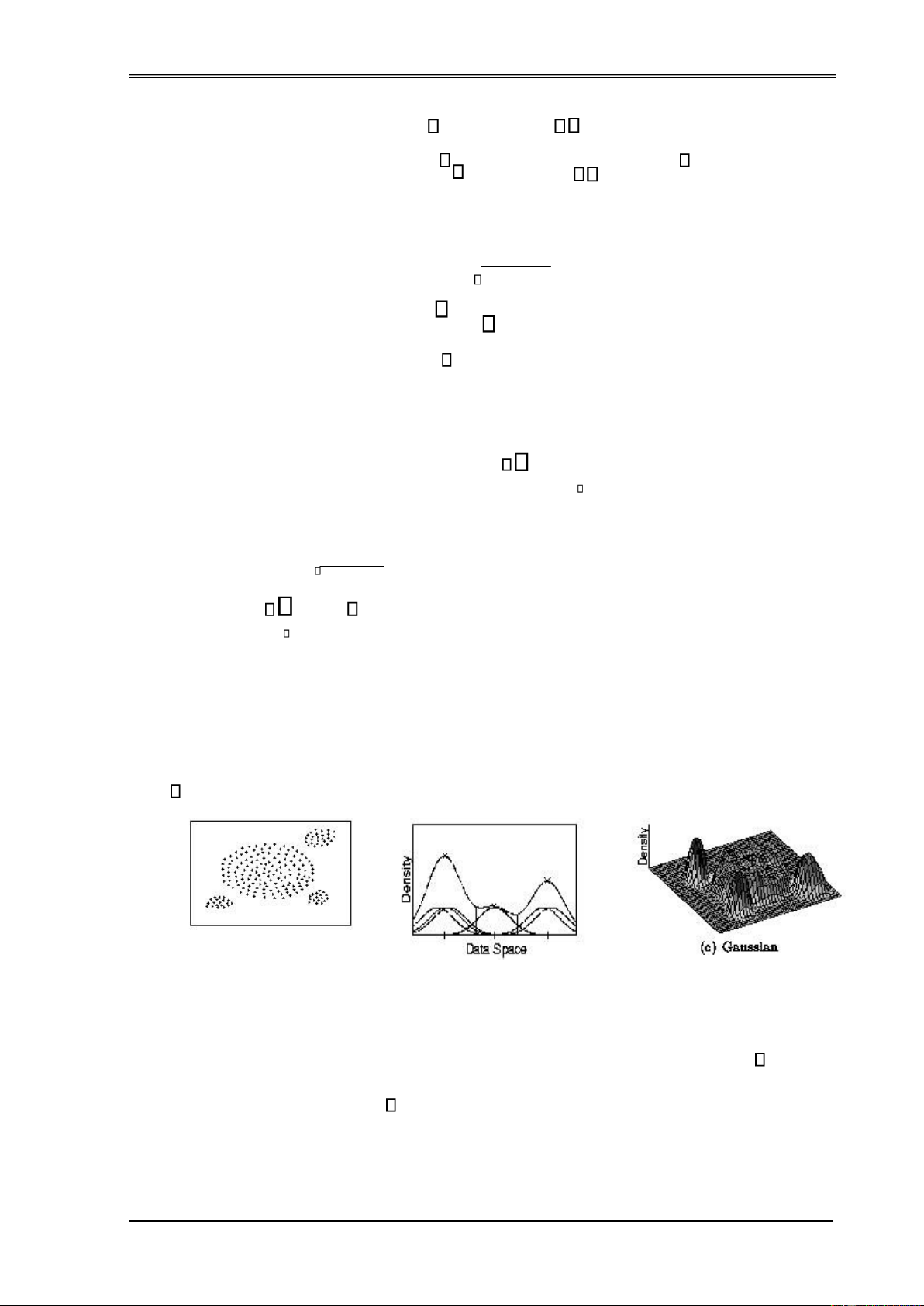

Ta có thể minh hoạ vấn ề phân cụm như hình sau ây:

Hình 1.4. Mô phỏng sự PCDL

Trong hình trên, sau khi phân cụm ta thu ược bốn cụm trong ó các phần tử

"tương tự" thì ược xếp vào một cụm, các phần tử "phi tương tự" thì chúng thuộc về các cụm khác nhau.

Trong PCDL khái niệm, hai hoặc nhiều ối tượng cùng ược xếp vào một cụm

nếu chúng có chung một ịnh nghĩa về khái niệm hoặc chúng xấp xỉ với các khái

niệm mô tả cho trước. Như vậy, PCDL không sử dụng ộ o “tương tự” như ã trình bày ở trên.

Trong học máy, PCDL ược xem là vấn ề học không có giám sát, vì nó phải

giải quyết vấn ề tìm một cấu trúc trong tập hợp dữ liệu chưa biết trước các thông

tin về lớp hay các thông tin về tập huấn luyện. Trong nhiều trường hợp, nếu phân

lớp ược xem là vấn ề học có giám sát thì PCDL là một bước trong phân lớp dữ

liệu, PCDL sẽ khởi tạo các lớp cho phân lớp bằng cách xác ịnh các nhãn cho các nhóm dữ liệu.

Một vấn ề thường gặp trong PCDL là hầu hết các dữ liệu cần cho phân cụm

ều có chứa dữ liệu "nhiễu" do quá trình thu thập thiếu chính xác hoặc thiếu ầy ủ,

vì vậy cần phải xây dựng chiến lược cho bước tiền xử lý dữ liệu nhằm khắc phục

hoặc loại bỏ "nhiễu" trước khi bước vào giai oạn phân tích PCDL. "Nhiễu" ở ây

có thể là các ối tượng dữ liệu không chính xác hoặc các ối tượng dữ liệu khuyết

thiếu thông tin về một số thuộc tính. Một trong các kỹ thuật xử lý nhiễu phổ biến Hoàng Văn Dũng 10 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

là việc thay thế giá trị của các thuộc tính của ối tượng "nhiễu" bằng giá trị thuộc

tính tương ứng của ối tượng dữ liệu gần nhất.

Ngoài ra, dò tìm phần tử ngoại lai là một trong những hướng nghiên cứu quan

trọng trong PCDL, chức năng của nó là xác ịnh một nhóm nhỏ các ối tượng dữ

liệu "khác thường" so với các dữ liệu khác trong CSDL - tức là các ối tượng dữ

liệu không tuân theo các hành vi hoặc mô hình dữ liệu - nhằm tránh sự ảnh hưởng

của chúng tới quá trình và kết quả của PCDL. Khám phá các phần tử ngoại lai ã

ược phát triển và ứng dụng trong viễn thông, dò tìm gian lận thương mại…

Tóm lại, PCDL là một vấn ề khó vì người ta phải i giải quyết các vấn ề con cơ bản như sau: - Biểu diễn dữ liệu.

- Xây dựng hàm tính ộ tương tự.

- Xây dựng các tiêu chuẩn phân cụm.

- Xây dựng mô hình cho cấu trúc cụm dữ liệu.

- Xây dựng thuật toán phân cụm và xác lập các iều kiện khởi tạo.

- Xây dựng các thủ tục biểu diễn và ánh giá kết quả phân cụm.

Theo các nghiên cứu thì ến nay chưa có một phương pháp phân cụm tổng

quát nào có thể giải quyết trọn vẹn cho tất cả các dạng cấu trúc cụm dữ liệu. Hơn

nữa, các phương pháp phân cụm cần có cách thức biểu diễn cấu trúc các cụm dữ

liệu khác nhau, với mỗi cách thức biểu diễn khác nhau sẽ có một thuật toán phân

cụm phù hợp. PCDL ang là vấn ề mở và khó vì người ta cần phải i giải quyết nhiều

vấn ề cơ bản như ã ề cập ở trên một cách trọn vẹn và phù hợp với nhiều dạng dữ

liệu khác nhau. Đặc biệt ối với dữ liệu hỗn hợp, ang ngày càng tăng trưởng không

ngừng trong các hệ quản trị dữ liệu, ây cũng là một trong những thách thức lớn

trong lĩnh vực KPDL trong những thập kỷ tiếp theo và ặc biệt là trong lĩnh vực KPDL Web.

1.2.2. Ứng dụng của phân cụm dữ liệu

PCDL là một trong những công cụ chính của KPDL ược ứng dụng trong

nhiều lĩnh vực như thương mại và khoa học. Các kỹ thuật PCDL ã ược áp dụng

cho một số ứng dụng iển hình trong các lĩnh vực sau [10][19]: lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Thương mại: PCDL có thể giúp các thương nhân khám phá ra các nhóm

khách hàng quan trọng có các ặc trưng tương ồng nhau và ặc tả họ từ các mẫu mua bán trong CSDL khách hàng.

Sinh học: PCDL ược sử dụng ể xác ịnh các loại sinh vật, phân loại các Gen

với chức năng tương ồng và thu ược các cấu trúc trong các mẫu.

Phân tích dữ liệu không gian: Do sự ồ sộ của dữ liệu không gian như dữ liệu

thu ược từ các hình ảnh chụp từ vệ tinh, các thiết bị y học hoặc hệ thống thông tin

ịa lý (GIS), …làm cho người dùng rất khó ể kiểm tra các dữ liệu không gian một

cách chi tiết. PCDL có thể trợ giúp người dùng tự ộng phân tích và xử lý các dữ

liêu không gian như nhận dạng và chiết xuất các ặc tính hoặc các mẫu dữ liệu quan

tâm có thể tồn tại trong CSDL không gian.

Lập quy hoạch ô thị: Nhận dạng các nhóm nhà theo kiểu và vị trí ịa lý,…

nhằm cung cấp thông tin cho quy hoạch ô thị.

Nghiên cứu trái ất: Phân cụm ể theo dõi các tâm ộng ất nhằm cung cấp thông

tin cho nhận dạng các vùng nguy hiểm.

Địa lý: Phân lớp các ộng vật, thực vật và ưa ra ặc trưng của chúng.

Khai phá Web: PCDL có thể khám phá các nhóm tài liệu quan trọng, có nhiều

ý nghĩa trong môi trường Web. Các lớp tài liệu này trợ giúp cho việc khám phá tri

thức từ dữ liệu Web, khám phá ra các mẫu truy cập của khách hàng ặc biệt hay

khám phá ra cộng ồng Web,…

1.2.3. Các yêu cầu ối với kỹ thuật phân cụm dữ liệu

Việc xây dựng, lựa chọn một thuật toán phân cụm là bước then chốt cho việc

giải quyết vấn ề phân cụm, sự lựa chọn này phụ thuộc vào ặc tính dữ liệu cần phân

cụm, mục ích của ứng dụng thực tế hoặc xác ịnh ộ ưu tiên giữa chất lượng của các

cụm hay tốc ộ thực hiện thuật toán,…

Hầu hết các nghiên cứu và phát triển thuật toán PCDL ều nhằm thoả mãn các

yêu cầu cơ bản sau [10][19]:

Có khả năng mở rộng: Một số thuật toán có thể ứng dụng tốt cho tập dữ liệu

nhỏ (khoảng 200 bản ghi dữ liệu) nhưng không hiệu quả khi áp dụng cho tập dữ

liệu lớn (khoảng 1 triệu bản ghi). Hoàng Văn Dũng 12 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Thích nghi với các kiểu dữ liệu khác nhau: Thuật toán có thể áp dụng hiệu

quả cho việc phân cụm các tập dữ liệu với nhiều kiểu dữ liệu khác nhau như dữ

liệu kiểu số, kiểu nhị phân, dữ liệu ịnh danh, hạng mục,... và thích nghi với kiểu dữ liệu hỗn hợp.

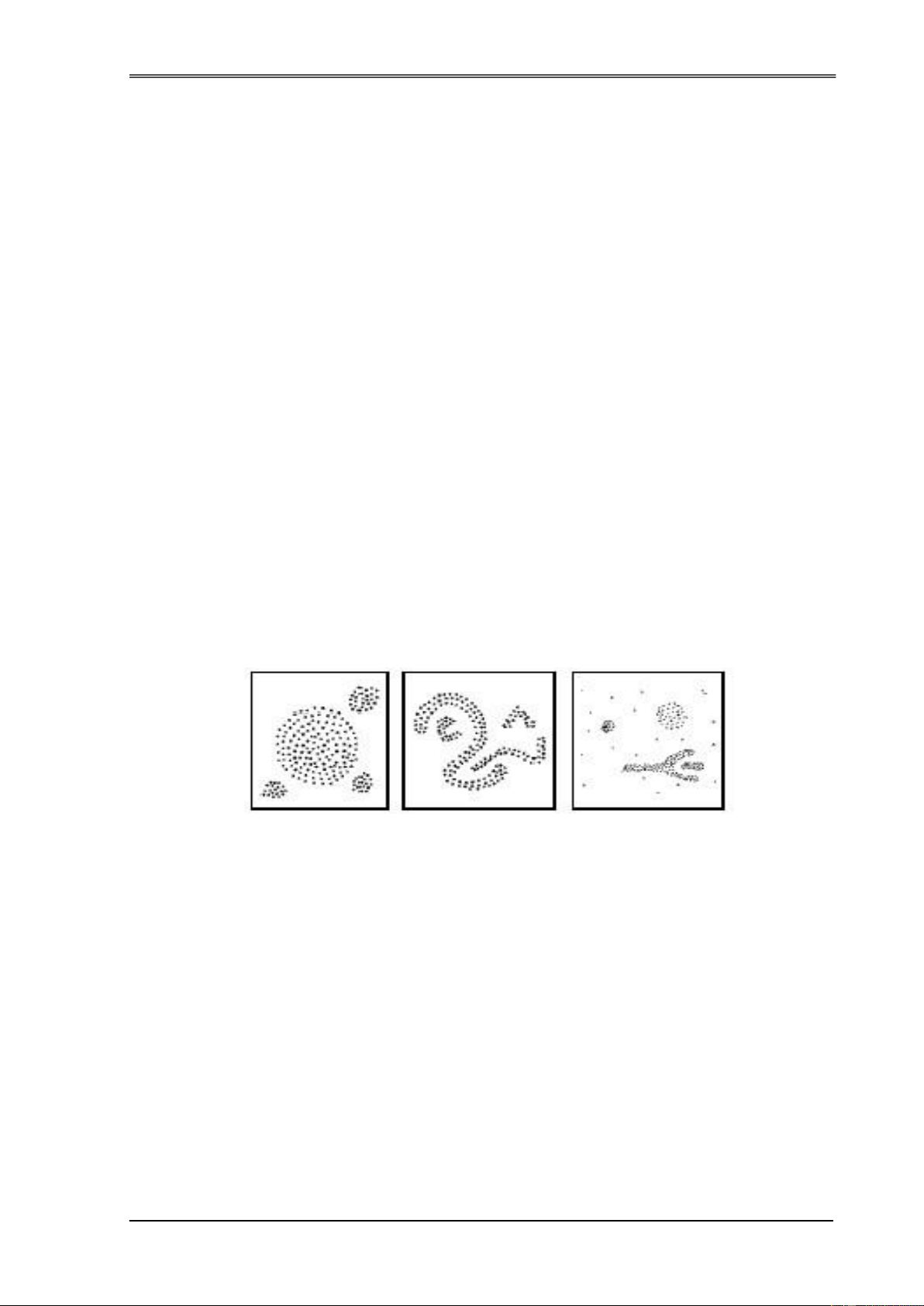

Khám phá ra các cụm với hình thù bất kỳ: Do hầu hết các CSDL có chứa

nhiều cụm dữ liệu với các hình thù khác nhau như: hình lõm, hình cầu, hình que,…

Vì vậy, ể khám phá ược các cụm có tính tự nhiên thì các thuật toán phân cụm cần

phải có khả năng khám phá ra các cụm dữ liệu có hình thù bất kỳ.

Tối thiểu lượng tri thức cần cho xác ịnh các tham số vào: Do các giá trị ầu

vào thường ảnh hưởng rất lớn ến thuật toán phân cụm và rất phức tạp ể xác ịnh

các giá trị vào thích hợp ối với các CSDL lớn.

Ít nhạy cảm với thứ tự của dữ liệu vào: Cùng một tập dữ liệu, khi ưa vào xử

lý cho thuật toán PCDL với các thứ tự vào của các ối tượng dữ liệu ở các lần thực

hiện khác nhau thì không ảnh hưởng lớn ến kết quả phân cụm.

Khả năng thích nghi với dữ liệu nhiễu cao: Hầu hết các dữ liệu phân cụm

trong KPDL ều chứa ựng các dữ liệu lỗi, dữ liệu không ầy ủ, dữ liệu rác. Thuật

toán phân cụm không những hiệu quả ối với các dữ liệu nhiễu mà còn tránh dẫn

ến chất lượng phân cụm thấp do nhạy cảm với nhiễu.

Ít nhạy cảm với các tham số ầu vào: Nghĩa là giá trị của các tham số ầu vào

khác nhau ít gây ra các thay ổi lớn ối với kết quả phân cụm.

Thích nghi với dữ liệu a chiều: Thuật toán có khả năng áp dụng hiệu quả cho

dữ liệu có số chiều khác nhau.

Dễ hiểu, dễ cài ặt và khả thi.

Các yêu cầu này ồng thời là các tiêu chí ể ánh giá hiệu quả của các phương

pháp PCDL, ây là những thách thức cho các nhà nghiên cứu trong lĩnh vực PCDL.

1.2.4. Các kiểu dữ liệu và ộ o tương tự

Trong phần này ta phân tích các kiểu dữ liệu thường ược sử dụng trong

PCDL. Trong PCDL, các ối tượng dữ liệu cần phân tích có thể là con người, nhà

cửa, tiền lương, các thực thể phần mềm,… Các ối tượng này thường ược diễn tả

dưới dạng các thuộc tính của nó. Các thuộc tính này là các tham số cần cho giải

quyết vấn ề PCDL và sự lựa chọn chúng có tác ộng áng kể ến các kết quả của phân

cụm. Phân loại các kiểu thuộc tính khác nhau là một vấn ề cần giải quyết ối với

hầu hết các tập dữ liệu nhằm cung cấp các phương tiện thuận lợi ể nhận dạng sự lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

khác nhau của các phần tử dữ liệu. Dưới ây là cách phân lớp dựa trên hai ặc trưng

là: kích thước miền và hệ o.

1.2.4.1. Phân loại kiểu dữ liệu dựa trên kích thước miền

- Thuộc tính liên tục: Nếu miền giá trị của nó là vô hạn không ếm ược, nghĩa

là giữa hai giá trị tồn tại vô số giá trị khác. Thí dụ như các thuộc tính về màu, nhiệt

ộ hoặc cường ộ âm thanh.

- Thuộc tính rời rạc: Nếu miền giá trị của nó là tập hữu hạn hoặc ếm ược.

Thí dụ như các thuộc tính về số serial của một cuốn sách, số thành viên trong một gia ình,…

1.2.4.2. Phân loại kiểu dữ liệu dựa trên hệ o

Giả sử ta có hai ối tượng x, y và các thuộc tính xi, yi tương ứng với thuộc tính

thứ i của chúng. Chúng ta có các lớp kiểu dữ liệu như sau:

- Thuộc tính ịnh danh: Dạng thuộc tính khái quát hoá của thuộc tính nhị phân,

trong ó miền giá trị là rời rạc không phân biệt thứ tự và có nhiều hơn hai phần tử

- nghĩa là nếu x và y là hai ối tượng thuộc tính thì chỉ có thể xác ịnh là x y hoặc

x = y. Thí dụ như thuộc tính về nơi sinh.

- Thuộc tính có thứ tự: Là thuộc tính ịnh danh có thêm tính thứ tự, nhưng

chúng không ược ịnh lượng. Nếu x và y là hai thuộc tính thứ tự thì ta có thể xác

ịnh là x y hoặc x = y hoặc x > y hoặc x < y. Thí dụ như thuộc tính Huy chương

của vận ộng viên thể thao.

- Thuộc tính khoảng: Nhằm ể o các giá trị theo xấp xỉ tuyến tính. Với thuộc

tính khoảng, ta có thể xác ịnh một thuộc tính là ứng trước hoặc ứng sau thuộc tính

khác với một khoảng là bao nhiêu. Nếu xi > yi thì ta nói x cách y một khoảng |xi –

yi| tương ứng với thuộc tính thứ i. Ví dụ: thuộc tính số Serial của một ầu sách trong

thư viện hoặc thuộc tính số kênh trên truyền hình.

- Thuộc tính tỉ lệ: Là thuộc tính khoảng nhưng ược xác ịnh một cách tương

ối so với iểm mốc, thí dụ như thuộc tính chiều cao hoặc cân nặng lấy giá trị 0 làm mốc. Hoàng Văn Dũng 14 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Trong các thuộc tính dữ liệu trình bày ở trên, thuộc tính ịnh danh và thuộc

tính có thứ tự gọi chung là thuộc tính hạng mục, thuộc tính khoảng và thuộc tính

tỉ lệ ược gọi là thuộc tính số.

Người ta còn ặc biệt quan tâm ến dữ liệu không gian. Đây là loại dữ liệu có

các thuộc tính số khái quát trong không gian nhiều chiều, dữ liệu không gian mô

tả các thông tin liên quan ến không gian chứa ựng các ối tượng, thí dụ như thông

tin về hình học,… Dữ liệu không gian có thể là dữ liệu liên tục hoặc rời rạc:

Dữ liệu không gian rời rạc: Có thể là một iểm trong không gian nhiều chiều

và cho phép ta xác ịnh ược khoảng cách giữa các ối tượng dữ liệu trong không gian.

Dữ liệu không gian liên tục: Bao gồm một vùng trong không gian.

Thông thường, các thuộc tính số ược o bằng các ơn vị xác ịnh như là

Kilogams hoặc Centimeter. Tuy nhiên, các ơn vị o có ảnh hưởng ến các kết quả

phân cụm. Thí dụ như thay ổi ộ o cho thuộc tính cân nặng từ Kilogams sang Pound

có thể mang lại các kết quả khác nhau trong phân cụm. Để khắc phục iều này

người ta phải chuẩn hoá dữ liệu, tức là sử dụng các thuộc tính dữ liệu không phụ

thuộc vào ơn vị o. Thực hiện chuẩn hoá phụ thuộc vào ứng dụng và người dùng,

thông thường chuẩn hoá dữ liệu ược thực hiện bằng cách thay thế mỗi một thuộc

tính bằng thuộc tính số hoặc thêm các trọng số cho các thuộc tính.

1.2.4.3. Khái niệm và phép o ộ tương tự, phi tương tự

Khi các ặc tính của dữ liệu ược xác ịnh, người ta tìm cách thích hợp ể xác ịnh

"khoảng cách" giữa các ối tượng (phép o ộ tương tự dữ liệu). Đây là các hàm ể o

sự giống nhau giữa các cặp ối tượng dữ liệu, thông thường các hàm này hoặc là ể

tính ộ tương tự hoặc là tính ộ phi tương tự giữa các ối tượng dữ liệu. Giá trị của

hàm tính ộ o tương tự càng lớn thì sự giống nhau giữa ối tượng càng lớn và ngược

lại, còn hàm tính ộ phi tương tự tỉ lệ nghịch với hàm tính ộ tương tự. Độ tương tự

hoặc ộ phi tương tự có nhiều cách ể xác ịnh, chúng thường ược o bằng khoảng

cách giữa các ối tượng. Tất cả các cách o ộ tương tự ều phụ thuộc vào kiểu thuộc

tính mà ta phân tích. Thí dụ, ối với thuộc tính hạng mục người ta không sử dụng

ộ o khoảng cách mà sử dụng một hướng hình học của dữ liệu. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Tất cả các ộ o dưới ây ược xác ịnh trong không o gian metric. Bất kỳ một

metric nào cũng là một ộ o, nhưng iều ngược lại không úng. Để tránh sự nhầm

lẫn, thuật ngữ ộ o ở ây ề cập ến hàm tính ộ tương tự hoặc ộ phi tương tự. Một

không gian metric là một tập trong ó có xác ịnh các "khoảng cách" giữa từng cặp

phần tử, với những tính chất thông thường của khoảng cách hình học. Nghĩa là,

một tập X (các phần tử của nó có thể là những ối tượng bất kỳ) gồm các ối tượng

dữ liệu trong CSDL D gọi là một không gian metric nếu với mỗi cặp phần tử x, y

thuộc X ều xác ịnh một số thực δ(x,y), ược gọi là khoảng cách giữa x và y thoả

mãn hệ tính chất sau: (i) δ(x, y)

> 0 nếu x ≠ y; (ii) δ(x,y)= 0 nếu x = y; (iii) δ(x, y) = δ(y, x) với mọi x, y; (iv) δ(x, y)

≤ δ(x, z)+ δ(z,y).

Hàm δ(x, y) ược gọi là một metric của không gian. Các phần tử của X ược

gọi là các iểm của không gian này.

Một số phép o ộ tương tự áp dụng ối với các kiểu dữ liệu khác nhau [10][17][27]:

+ Thuộc tính khoảng: Sau khi chuẩn hoá, ộ o phi tương tự của hai ối tượng

dữ liệu x, y ược xác ịnh bằng các metric như sau: 1/ y

Khoảng cách Minskowski:d x y( , ) ( n1|xi

i| )qq, với q là số nguyên dương. i

Khoảng cách Euclide: d x y( , ) n i 1 (xi

yi)2 , (trường hợp ặc biệt của

khoảng cách Minskowski trong trường hợp q =2).

Khoảng cách Manhattan: d x y( , )

n | xi yi |, (trường hợp ặc biệt của i 1

khoảng cách Minskowski trong trường hợp q=1). Hoàng Văn Dũng 16 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Khoảng cách cực ại: d x y( , ) Max ni 1| xi yi |, ây là trường hợp của khoảng

cách Minskowski trong trường hợp q .

+ Thuộc tính nhị phân: Trước hết ta có xây dựng bảng tham số sau: y: 1 y: 0 x: 1 + x: 0 + + +

Bảng 1.1. Bảng tham số thuộc tính nhị phân

Trong ó: = + + + , các ối tượng x, y mà tất cả các thuộc tính của nó ều

là nhị phân biểu thị bằng 0 và 1. Bảng trên cho ta các thông tin sau:

- là tổng số các thuộc tính có giá trị là 1 trong cả hai ối tượng x, y.

- là tổng số các giá trị thuộc tính có giá trị là 1 trong x và 0 trong y.

- là tổng số các giá trị thuộc tính có giá trị là 0 trong x và 1 trong y.

- là tổng số các giá trị thuộc tính có giá trị là 0 trong x và y.

Các phép o ộ tương tự ối với dữ liệu thuộc tính nhị phân ược ịnh nghĩa như sau:

- Hệ số ối sánh ơn giản: d x y( , )

, ở ây cả hai ối tượng x và y có

vai trò như nhau, nghĩa là chúng ối xứng và có cùng trọng số.

- Hệ số Jacard: d x y( , )

, tham số này bỏ qua số các ối sánh

giữa 0-0. Công thức tính này ược sử dụng trong trường hợp mà trọng số của các

thuộc tính có giá trị 1 của ối tượng dữ liệu có giá trị cao hơn nhiều so với các

thuộc tính có giá trị 0, như vậy các thuộc tính nhị phân ở ây là không ối xứng.

+ Thuộc tính ịnh danh: Độ o phi tương tự giữa hai ối tượng x và y ược ịnh

nghĩa như sau: d x y( , ) p m , trong ó m là số thuộc tính ối sánh p

tương ứng trùng nhau và p là tổng số các thuộc tính.

+ Thuộc tính có thứ tự: Phép o ộ phi tương tự giữa các ối tượng dữ liệu với

thuộc tính thứ tự ược thực hiện như sau, ở ây ta giả sử i là thuộc tính lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

thứ tự có Mi giá trị (Mi kích thước miền giá trị):

Các trạng thái Mi ược sắp thứ tự như sau: [1…Mi], ta có thể thay thế mỗi giá

trị của thuộc tính bằng giá trị cùng loại ri, với ri {1,…,Mi}.

Mỗi một thuộc tính thứ tự có các miền giá trị khác nhau, vì vậy ta chuyển ổi

chúng về cùng miền giá trị [0,1] bằng cách thực hiện phép biến ổi sau cho mỗi thuộc tính: z 1 i( )j Mri( )j i

1, với i=1,..,Mi

Sử dụng công thức tính ộ phi tương tự của thuộc tính khoảng ối với các giá trị z ( )j i

, ây cũng chính là ộ phi tương tự của thuộc tính có thứ tự.

+ Thuộc tính tỉ lệ: Có nhiều cách khác nhau ể tính ộ tương tự giữa các thuộc

tính tỉ lệ. Một trong những số ó là sử dụng công thức tính logarit cho mỗi thuộc

tính xi, thí dụ qi = log(xi), lúc này qi óng vai trò như thuộc tính khoảng. Phép biến

ổi logarit này thích hợp trong trường hợp các giá trị của thuộc tính là số mũ.

Trong thực tế, khi tính ộ o tương tự dữ liệu, người ta chỉ xem xét một phần

các thuộc tính ặc trưng ối với các kiểu dữ liệu hoặc ánh trọng số cho cho tất cả

các thuộc tính dữ liệu. Trong một số trường hợp, người ta loại bỏ ơn vị o của các

thuộc tính dữ liệu bằng cách chuẩn hoá chúng hoặc gán trọng số cho mỗi thuộc

tính giá trị trung bình, ộ lệch chuẩn. Các trọng số này có thể sử dụng trong các ộ

o khoảng cách trên, thí dụ với mỗi thuộc tính dữ liệu ã ược gán trọng số tương

ứng wi (1 i k ), ộ tương tự dữ liệu ược xác ịnh như sau: d x y( , ) i n1 wi (xi yi)2 .

Người ta có thể chuyển ổi giữa các mô hình cho các kiểu dữ liệu trên, thí dụ

dữ liệu kiểu hạng mục có thể chuyển ổi thành dữ liệu nhị phân và ngược lại. Nhưng

giải pháp này rất tốt kém về chi phí tính toán, cần phải cân nhắc khi áp dụng cách thức này.

Tuỳ từng trường hợp dữ liệu cụ thể mà người ta sử dụng các mô hình tính ộ

tương tự khác nhau. Việc xác ịnh ộ tương tự dữ liệu thích hợp, chính xác, ảm bảo Hoàng Văn Dũng 18 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

khách quan là rất quan trọng và góp phần xây dựng thuật toán PCDL có hiệu quả

cao trong việc ảm bảo chất lượng cũng như chi phí tính toán của thuật toán. 1.3. Khai phá Web

1.3.1. Lợi ích của khai phá Web

Với sự phát triển nhanh chóng của thông tin trên www, KPDL Web ã từng

bước trở nên quan trọng hơn trong lĩnh vực KPDL, người ta luôn hy vọng lấy ược

những tri thức hữu ích thông qua việc tìm kiếm, phân tích, tổng hợp, khai phá

Web. Những tri thức hữu ích có thể giúp ta xây dựng nên những Web site hiệu quả

ể có thể phục vụ cho con người tốt hơn, ặc biệt trong lĩnh vực thương mại iện tử.

Khám phá và phân tích những thông tin hữu ích trên www bằng cách sử dụng

kỹ thuật KPDL ã trở thành một hướng quan trọng trong lĩnh vực khám phá tri

thức. Khai phá Web bao gồm khai phá cấu trúc Web, khai phá nội dung Web và

khai phá các mẫu truy cập Web.

Sự phức tạp trong nội dung của các trang Web khác với các tài liệu văn bản

truyền thống [16]. Chúng không ồng nhất về cấu trúc, hơn nữa nguồn thông tin

Web thay ổi một cách nhanh chóng, không những về nội dung mà cả về cấu trúc

trang. Chẳng hạn như tin tức, thị trường chứng khoán, thông tin quảng cáo, trung

tâm dịch vụ mạng,... Tất cả thông tin ược thay ổi trên Web theo từng giai oạn. Các

liên kết trang và ường dẫn truy cập cũng luôn thay ổi. Khả năng gia tăng liên tục

về số lượng người dùng, sự quan tâm tới Web cũng khác nhau, ộng cơ người dùng

rất a dạng và phong phú. Vậy làm thế nào ể có thể tìm kiếm ược thông tin mà

người dùng cần? Làm thế nào ể có ược những trang Web chất lượng cao?...

Những vấn ề này sẽ ược thực hiện hiệu quả hơn bằng cách nghiên cứu các

kỹ thuật KPDL áp dụng trong môi trường Web. Thứ nhất, ta sẽ quản lý các Web

site thật tốt; thứ hai, khai phá những nội dung mà người dùng quan tâm; thứ ba,

sẽ thực hiện phân tích các mẫu sử dụng Web.

Dựa vào những vấn ề cơ bản trên, ta có thể có những phương pháp hiệu quả

cao ể cung cấp những thông tin hữu ích ối với người dùng Web và giúp người

dùng sử dụng nguồn tài nguyên Web một cách hiệu quả. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm 1.3.2. Khai phá Web

Có nhiều khái niệm khác nhau về khai phá Web, nhưng có thể tổng quát hóa

như sau [5][30]: Khai phá Web là việc sử dụng các kỹ thuật KPDL ể tự ộng hóa

quá trình khám phá và trích rút những thông tin hữu ích từ các tài liệu, các dịch

vụ và cấu trúc Web. Hay nói cách khác khai phá Web là việc thăm dò những thông

tin quan trọng và những mẫu tiềm năng từ nội dung Web, từ thông tin truy cập

Web, từ liên kết trang và từ nguồn tài nguyên thương mại iện tử bằng việc sử dụng

các kỹ thuật KPDL, nó có thể giúp con người rút ra những tri thức, cải tiến việc

thiết kế các Web site và phát triển thương mại iện tử tốt hơn. Lĩnh vực này ã thu

hút ược nhiều nhà khoa học quan tâm. Quá trình khai phá Web có thể chia thành

các công việc nhỏ như sau:

i. Tìm kiếm nguồn tài nguyên: Thực hiện tìm kiếm và lấy các tài liệu Web

phục vụ cho việc khai phá.

ii. Lựa chọn và tiền xử lý dữ liệu: Lựa chọn và tiền xử lý tự ộng các loại

thông tin từ nguồn tài nguyên Web ã lấy về.

iii. Tổng hợp: Tự ộng khám phá các mẫu chung tại các Web site riêng lẽ

cũng như nhiều Website với nhau.

iv. Phân tích: Đánh giá, giải thích, biểu diễn các mẫu khai phá ược.

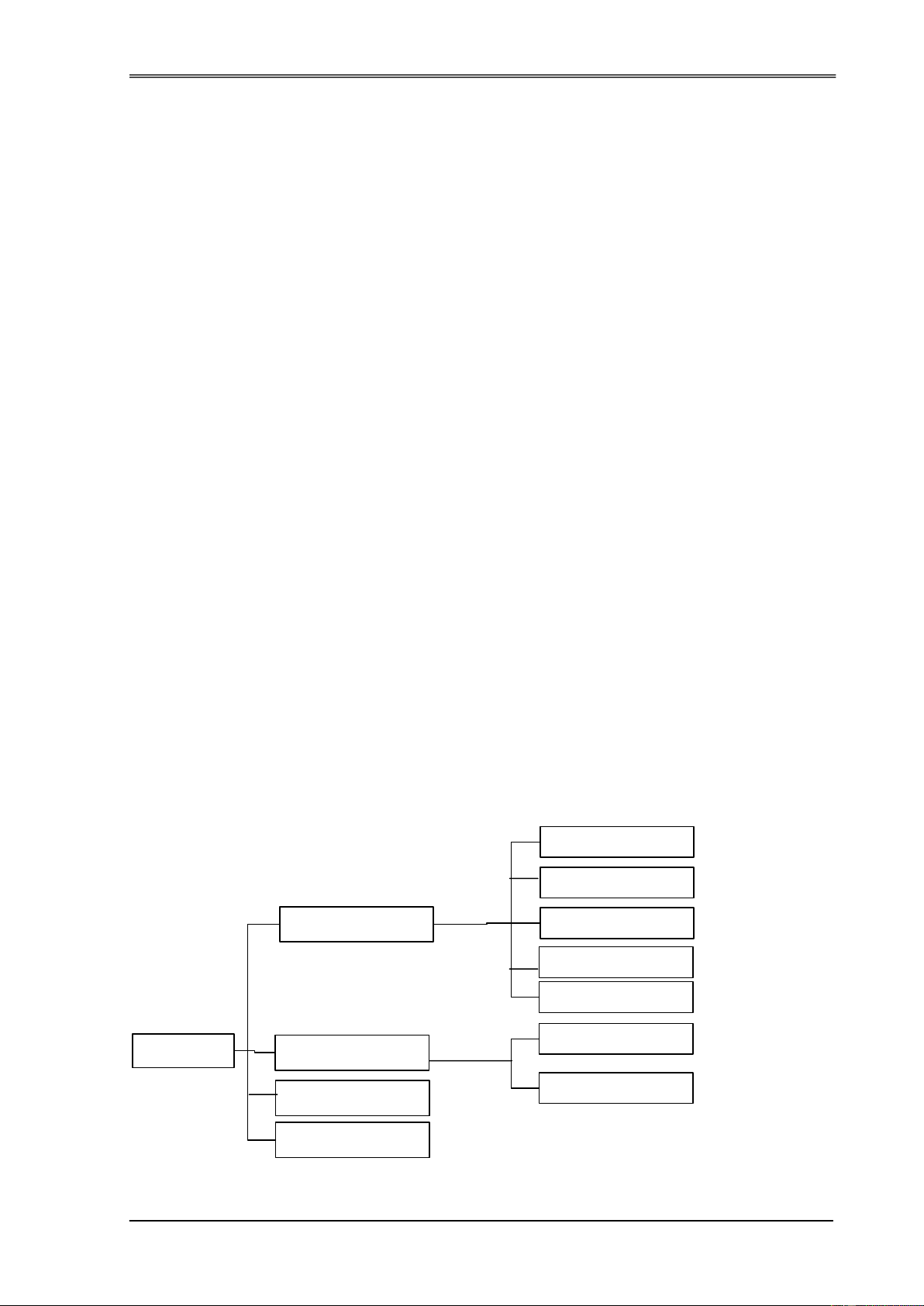

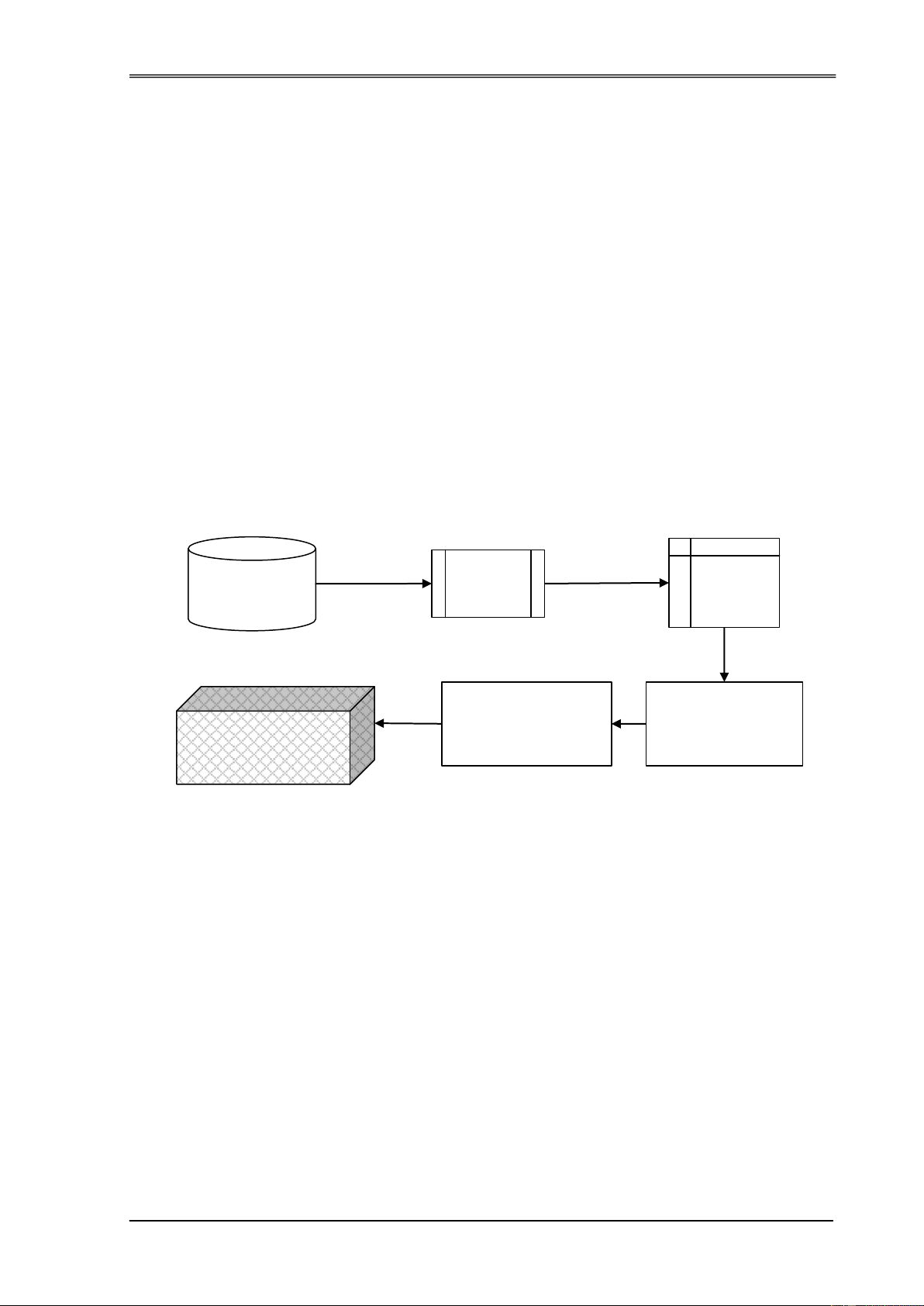

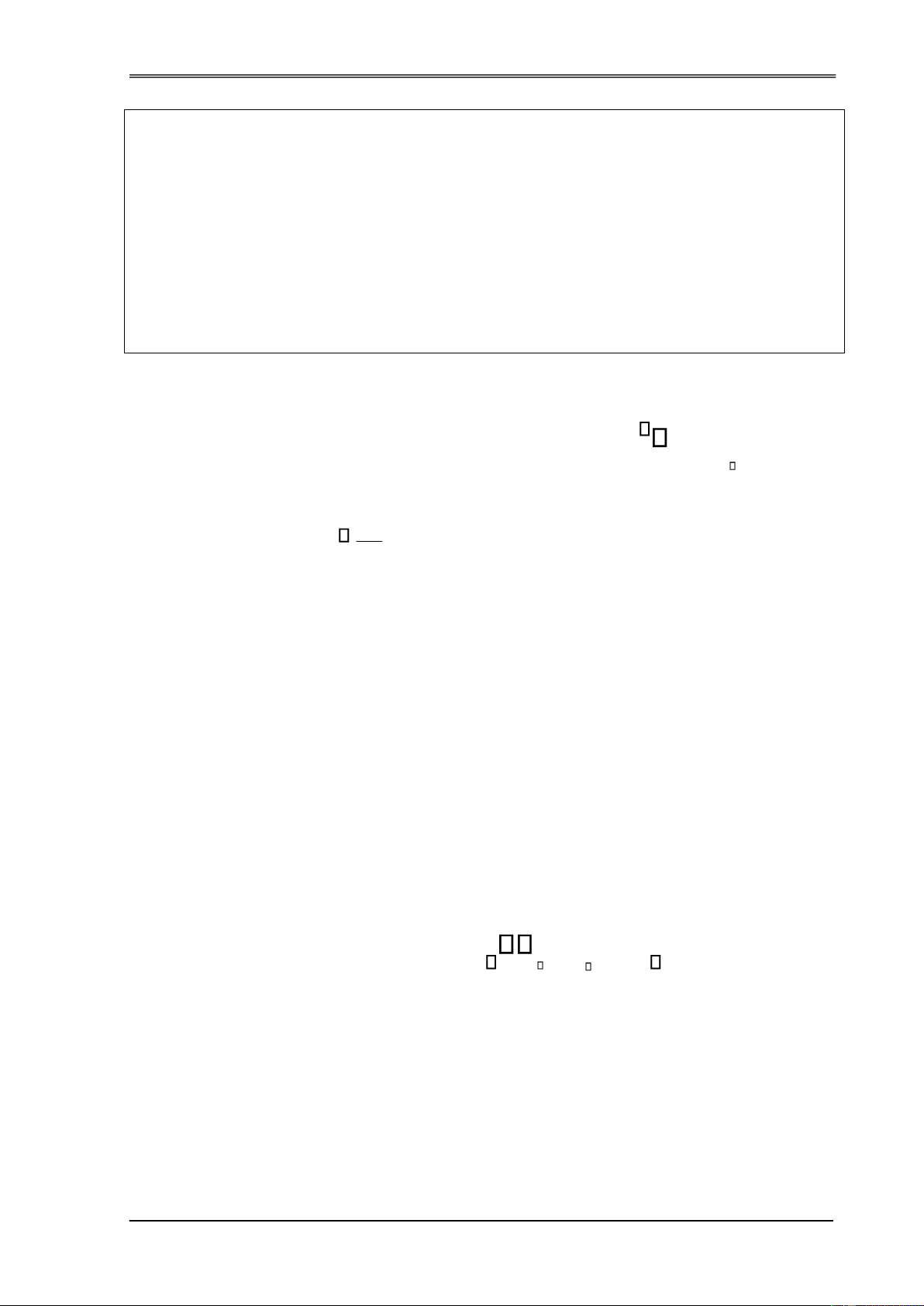

1.3.3. Các kiểu dữ liệu Web

Ta có thể khái quát bằng sơ ồ sau: Free Text HTML file Content data XML file Dynamic content Multimedia Web data Static link Structure data Usage data Dynamic link User Profile data

Hình 1.5. Phân loại dữ liệu Web Hoàng Văn Dũng 20 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Các ối tượng của khai phá Web bao gồm [5][16]: Server logs, Web pages,

Web hyperlink structures, dữ liệu thị trường trực tuyến và các thông tin khác.

Web logs: Khi người dùng duyệt Web, dịch vụ sẽ phân ra 3 loại dữ liệu ăng

nhập: sever logs, error logs, và cookie logs. Thông qua việc phân tích các tài liệu

ăng nhập này ta có thể khám phá ra những thông tin truy cập.

Web pages: Hầu hết các phương pháp KPDL Web ược sử dụng trong Web pages là theo chuẩn HTML.

Web hyperlink structure: Các trang Web ược liên kết với nhau bằng các siêu

liên kết, iều này rất quan trọng ể khai phá thông tin. Do các siêu liên kết Web là

nguồn tài nguyên rất xác thực.

Dữ liệu thị trường trực tuyến: Như lưu trữ thông tin thương mại iện tử trong

các site thương mại iện tử.

Các thông tin khác: Chủ yếu bao gồm các ăng ký người dùng, nó có thể

giúp cho việc khai phá tốt hơn.

1.4. Xử lý dữ liệu văn bản ứng dụng trong khai phá dữ liệu Web

1.4.1. Dữ liệu văn bản

Trong các loại dữ liệu hiện nay thì văn bản là loại dữ liệu phổ biến nhất và

nó có mặt khắp mọi nơi, ặc biệt là ối với dữ liệu trên Web. Do vậy, các bài toán

xử lý văn bản ã ược ặt ra từ rất sớm và hiện nay nó vẫn là vấn ề rất ược nhiều nhà

nghiên cứu quan tâm, một trong những bài toán ó là tìm kiếm và trích dẫn văn

bản, biểu diễn và phân loại văn bản,….

CSDL văn bản có thể chia làm 2 loại chính [14][20]:

+ Dạng không có cấu trúc: Đây là những tài liệu văn bản thông thường mà ta

ọc thường ngay trên các sách, báo, internet,… ây là dạng dữ liệu của ngôn ngữ tự

nhiên của con người và nó không theo một khuôn mẫu ịnh sẵn nào cả.

+ Dạng nữa cấu trúc: Đây là những văn bản ược tổ chức dưới dạng cấu trúc

lỏng, nhưng vẫn thể hiện nội dung chính của văn bản, như văn bản HTML, Email,..

1.4.2. Một số vấn ề trong xử lý dữ liệu văn bản

Mỗi văn bản ược biểu diễn bằng một vector Boolean hoặc vector số. Những

vector này ược xét trong một không gian a chiều, trong ó mỗi chiều tương ứng với lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

một từ mục riêng biệt trong tập văn bản. Mỗi thành phần của vector ược gán một

hàm giá trị f, nó là một số chỉ mật ộ tương ứng của chiều ó trong văn bản. Nếu

thay ổi giá trị hàm f ta có thể tạo ra nhiều trọng số khác nhau.

Một số vấn ề liên quan ến việc biểu diễn văn bản bằng mô hình không gian vector:

+ Không gian vector là một tập hợp bao gồm các từ.

+ Từ là một chuỗi các ký tự (chữ cái và chữ số); ngoại trừ các khoảng trống

(space, tab), ký tự xuống dòng, dấu câu (như dấu chấm, phẩy, chấm phẩy, dấu

cảm,...). Mặt khác, ể ơn giản trong quá trình xử lý, ta không phân biệt chữ hoa và

chữ thường (nếu chữ hoa thì chuyển về chữ thường).

+ Cắt bỏ từ: Trong nhiều ngôn ngữ, nhiều từ có cùng từ gốc hoặc là biến thể

của từ gốc sang một từ khác. Việc sử dụng từ gốc làm giảm áng kể số lượng các từ

trong văn bản (giảm số chiều của không gian), nhưng việc cắt bỏ các từ lại rất khó

trong việc hiểu văn bản.

Ngoài ra, ể nâng cao chất lượng xử lý, một số công trình nghiên cứu ã ưa ra

một số cải tiến thuật toán xem xét ến ặc tính ngữ cảnh của các từ bằng việc sử

dụng các cụm từ/văn phạm chứ không chỉ xét các từ riêng lẽ [31]. Những cụm từ

này có thể ược xác ịnh bằng cách xem xét tần số xuất hiện của cả cụm từ ó trong tài liệu.

Bằng phương pháp biểu diễn không gian vector, ta có thể thấy rõ ràng là

chiều của một vector sẽ rất lớn bởi số chiều của nó ược xác ịnh bằng số lượng các

từ khác nhau trong tập hợp từ. Chẳng hạn, số lượng các từ có thể từ 103 ến 105 ối

với các tập văn bản nhỏ. Vấn ề ặt ra là làm sao ể giảm số chiều của vector mà vẫn

ảm bảo việc xử lý văn bản úng và chính xác, ặc biệt là trong môi trường www, ta

sẽ xem xét ến một số phương pháp ể giảm số chiều của vector.

1.4.2.1. Loại bỏ từ dừng

Trước hết ta thấy trong ngôn ngữ tự nhiên có nhiều từ chỉ dùng ể biểu diễn

cấu trúc câu chứ không biểu ạt nội dung của nó. Như các giới từ, từ nối,... những

từ như vậy xuất hiện nhiều trong các văn bản mà không liên quan gì tới chủ ề hoặc Hoàng Văn Dũng 22 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

nội dung của văn bản. Do ó, ta có thể loại bỏ những từ ó ể giảm số chiều của vector

biểu diễn văn bản, những từ như vậy ược gọi là những từ dừng.

Sau ây là ví dụ về tần số xuất hiện cao của một số từ (tiếng Anh) trong

336,310 tài liệu gồm tổng cộng 125.720.891 từ, 508.209 từ riêng biệt.

(thống kê của B. Croft, UMass)

Bảng 1.2. Thống kê các từ tần số xuất hiện cao

1.4.2.2. Định luật Zipf

Để giảm số chiều của vector biểu diễn văn bản hơn nữa ta dựa vào một quan

sát sau: Nhiều từ trong văn bản xuất hiện rất ít lần, nếu mục tiêu của ta là xác ịnh

ộ tương tự và sự khác nhau trong toàn bộ tập hợp các văn bản thì các từ xuất hiện

một hoặc hai lần (tần số xuất hiện nhỏ) thì ảnh hưởng rất bé ến các văn bản.

Tiền ề cho việc lý luận ể loại bỏ những từ có tần suất nhỏ ược ưa ra bởi Zipf

năm 1949. Zipf phát biểu dưới dạng một quan sát nhưng ngay trong thời iểm ó,

quan sat ó ã ược gọi là ịnh luật Zipf, mặc dù nó thực sự không phải là một ịnh luật

mà úng hơn ó là một hiện tượng xấp xỉ toán học.

Để mô tả ịnh luật Zipf, ta gọi tổng số tần số xuất hiện của từ t trong tài liệu

D là ft. Sau ó sắp xếp tất cả các từ trong tập hợp theo chiều giảm dần của tần số

xuất hiện f và gọi thứ hạng của mỗi từ t là rt.

Định luật Zipf ược phát biểu dưới dạng công thức như sau: rt.ft

K (với K là một hằng số).

Trong tiếng Anh, người ta thấy rằng hằng số K N/10 trong ó N là số các từ

trong văn bản. Ta có thể viết lại ịnh luật Zipf như sau: rt K/ ft

Giả sử từ ti ược sắp xếp ở vị trí thấp nhất với tần số xuất hiện là b nào ấy và

từ tj cũng ược sắp ở vị trí thấp kế tiếp với một tần số xuất hiện là b+1. Ta có thể lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

thu ược thứ hạng xấp xỉ của các từ này là rti K/b và rtj K/(b+1), trừ 2 biểu thức

này cho nhau ta xấp xỉ ối với các từ riêng biệt có tần số xuất hiện là b.

rti- rtj K/b-K/(b+1)

Ta xấp xỉ giá trị của từ trong tập hợp có thứ hạng cao nhất. Một cách tổng

quát, một từ chỉ xuất hiện một lần trong tập hợp, ta có rmax=K.

Xét phân bố của các từ duy nhất xuất hiện b lần trong tập hợp, chia 2 vế cho

nhau ta ược K/b. Do ó, ịnh luật Zipf cho ta thấy sự phân bố áng chú ý của các tự

riêng biệt trong 1 tập hợp ược hình thành bởi các từ xuất hiện ít nhất trong tập hợp.

Năm 1958 Luhn ề xuất những từ “phổ biến” và “hiếm” và không cần thiết

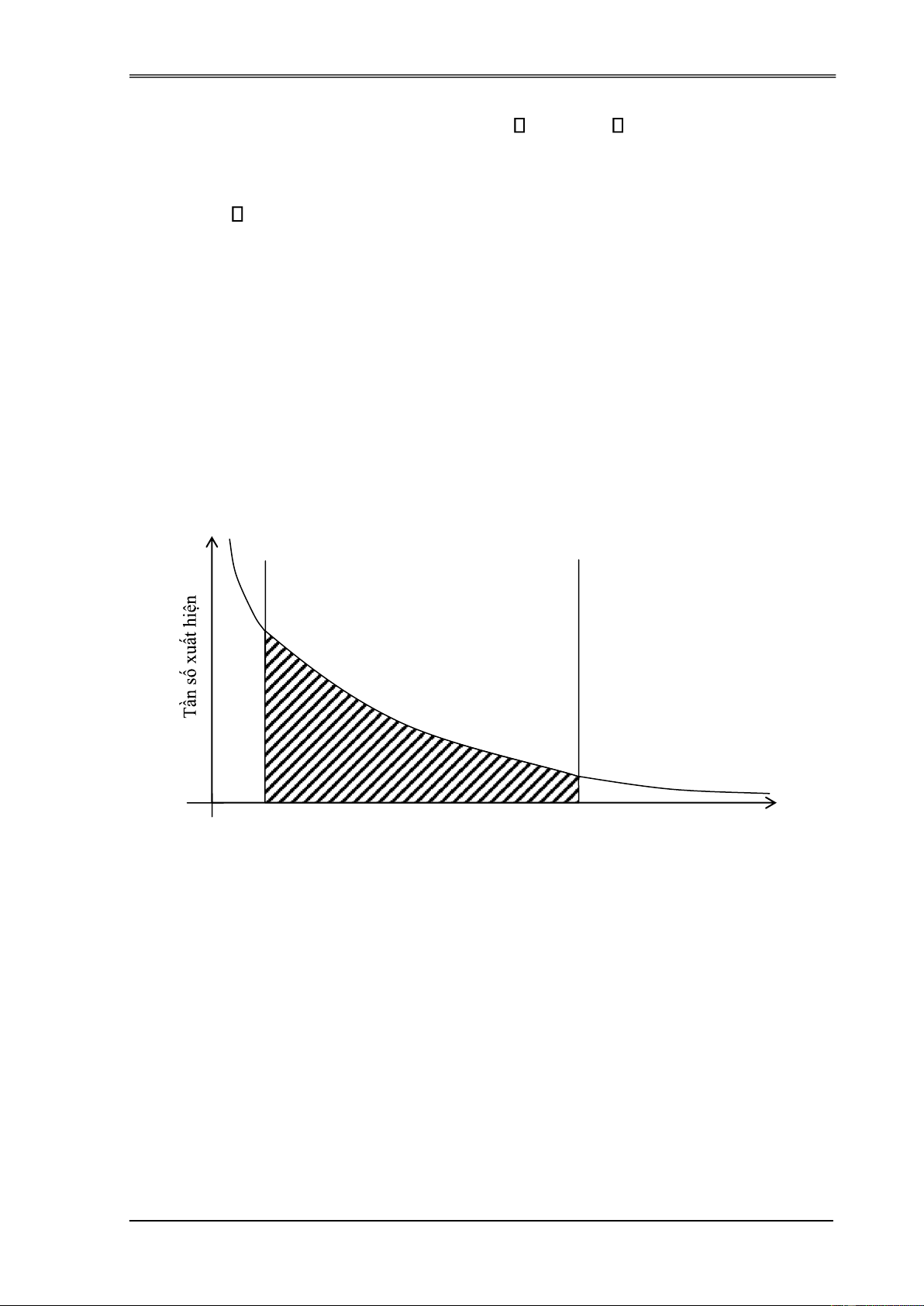

cho quá trình xử lý như sau. f vùng cao Vùng những từ Vùng thấp mang ý nghĩa Thứ hạng của từ r

Hình 1.6. Lược ồ thống kê tần số của từ theo Định luật Zipf

1.4.3. Các mô hình biểu diễn dữ liệu văn bản

Trong các bài toán xử lý văn bản, ta thấy rằng vai trò của biểu diễn văn bản

rất lớn, ặc biệt trong các bài toán tìm kiếm, phân cụm,…

Theo các nghiên cứu về cách biểu diễn khác nhau trong xử lý văn bản thì

cách biểu diễn tốt nhất là bằng các từ riêng biệt ược rút ra từ tài liệu gốc và cách

biểu diễn này ảnh hưởng tương ối nhỏ ối với kết quả.

Các cách tiếp cận khác nhau sử dụng mô hình toán học khác nhau ể tính toán,

ở ây ta sẽ trình bày một số mô hình phổ biến và ược ăng nhiều trong các bài báo gần ây [14][22]. Hoàng Văn Dũng 24 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

1.4.3.1. Mô hình Boolean

Đây là mô hình biểu diễn vector với hàm f nhận giá trị rời rạc với duy nhất

hai giá trị úng/sai (true/false). Hàm f tương ứng với thuật ngữ ti sẽ cho giá trị úng

khi và chỉ khi ti xuất hiện trong tài liệu ó.

Giả sử rằng có một CSDL gồm m văn bản, D={d1, d2, ..., dm}. Mỗi văn bản

ược biểu diễn dưới dạng một vector gồm n thuật ngữ T={t1, t2,...,tn}. Gọi W={wij}

là ma trận trọng số, wij là giá trị trọng số của thuật ngữ ti trong tài liệu dj.

Mô hình Boolean là mô hình ơn giản nhất, nó ược xác ịnh như sau: 1 nếu ti dj Wij= 0 nếu ti dj

1.4.3.2. Mô hình tần số

Mô hình này xác ịnh giá trị trọng số các phần tử trong ma trận W(wij) các giá

trị là các số dương dựa vào tần số xuất hiện của các từ trong tài liệu hoặc tần số

xuất hiện của tài liệu trong CSDL. Có 2 phương pháp phổ biến:

1.4.3.2.1. Mô hình dựa trên tần số xuất hiện các từ

Trong mô hình dưa trên tần số xuất hiện từ (TF-Term Frequency) giá trị của

các từ ược tính dựa vào số lần xuất hiện của nó trong tài liệu, gọi tfij là số lần xuất

hiện của từ ti trong tài liệu dj, khi ó wij có thể ược tính theo một trong các công thức sau [31]: - Wij = tfij

- Wij = 1+log(tfij) - Wij = tfij

Với mô hình này, trọng số wij ồng biến với số lần xuất hiện của thuật ngữ ti

trong tài liệu dj. Khi số lần xuất hiện thuật ngữ ti trong tài liệu dj càng lớn thì có

nghĩa là dj càng phụ thuộc nhiều vào thuật ngữ ti, nói cách khác thuật ngữ ti mang

nhiều thông tin hơn trong tài liệu dj.

1.4.3.2.2. Phương pháp dựa trên tần số văn bản nghịch ảo

Trong mô hình dưa trên tần số văn bản nghịch ảo (IDF-Inverse Document

Frequency) giá trị trọng số của từ ược tính bằng công thức sau [31]: lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm )

n log(n) log(hi ) nếu ti dj Wij= log( i h

nếu ngược lại (ti dj) 0

Trong ó, n là tổng số văn bản trong CSDL, hi là số văn bản chứa thuật ngữ ti.

Trọng số wij trong công thức trên ược tính dựa vào ộ quan trọng của thuật

ngữ ti trong tài liệu dj. Nếu ti xuất hiện càng ít trong các văn bản thì nó càng quan

trọng, do ó nếu ti xuất hiện trong dj thì trọng số của nó càng lớn, nghĩa là nó càng

quan trọng ể phân biệt dj với các tài liệu khác và lượng thông tin của nó càng lớn.

1.4.3.2.3. Mô hình kết hợp TF-IDF

Trong mô hình TF-IDF [31], mỗi tài liệu dj ược xét ến thể hiện bằng một ặc

trưng của (t1, t2,.., tn) với ti là một từ/cụm từ trong dj. Thứ tự của ti dựa trên trọng

số của mỗi từ. Các tham số có thể ược thêm vào ể tối ưu hóa quá trình thực hiện

nhóm. Như vậy, thành phần trọng số ược xác ịnh bởi công thức sau, nó kết hợp

giá trị trọng số tf và giá trị trọng số idf.

Công thức tính trọng số TF-IDF là:

tfij idfij [1 log(fij )] log(n ) nếu ti dj Data Wij= hi set 0

nếu ngược lại (ti dj) Trong ó:

tfij là tần số xuất hiện của ti trong tài liệu dj idfij là

nghịch ảo tần số xuất hiện của ti trong tài liệu dj. hi là số

các tài liệu mà ti xuất hiện trong CSDL.

n là tổng số tài liệu trong CSDL.

Từ công thức này, ta có thể thấy trọng số của mỗi phần tử là dựa trên nghịch

ảo của tần số tài liệu trong CSDL mà ti và tần số xuất hiện của phần tử này trong tài liệu.

Thông thường ta xây dựng một từ iển từ ể lấy i những từ rất phổ biến và

những từ có tần số xuất hiện thấp. Ngoài ra ta phải lựa chọn m (Zemir sử dụng

500) phần tử có trọng số cao nhất như là những từ ặc trưng. Hoàng Văn Dũng 26 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Phương pháp này kết hợp ược ưu iểm của cả 2 phương pháp trên. Trọng số

wij ược tính bằng tần số xuất hiện của thuật ngữ ti trong tài liệu dj và ộ “hiếm” của

thuật ngữ ti trong toàn bộ CSDL. Tùy theo ràng buộc cụ thể của bài toán mà ta sử

dụng các mô hình biểu diễn văn bản cho phù hợp.

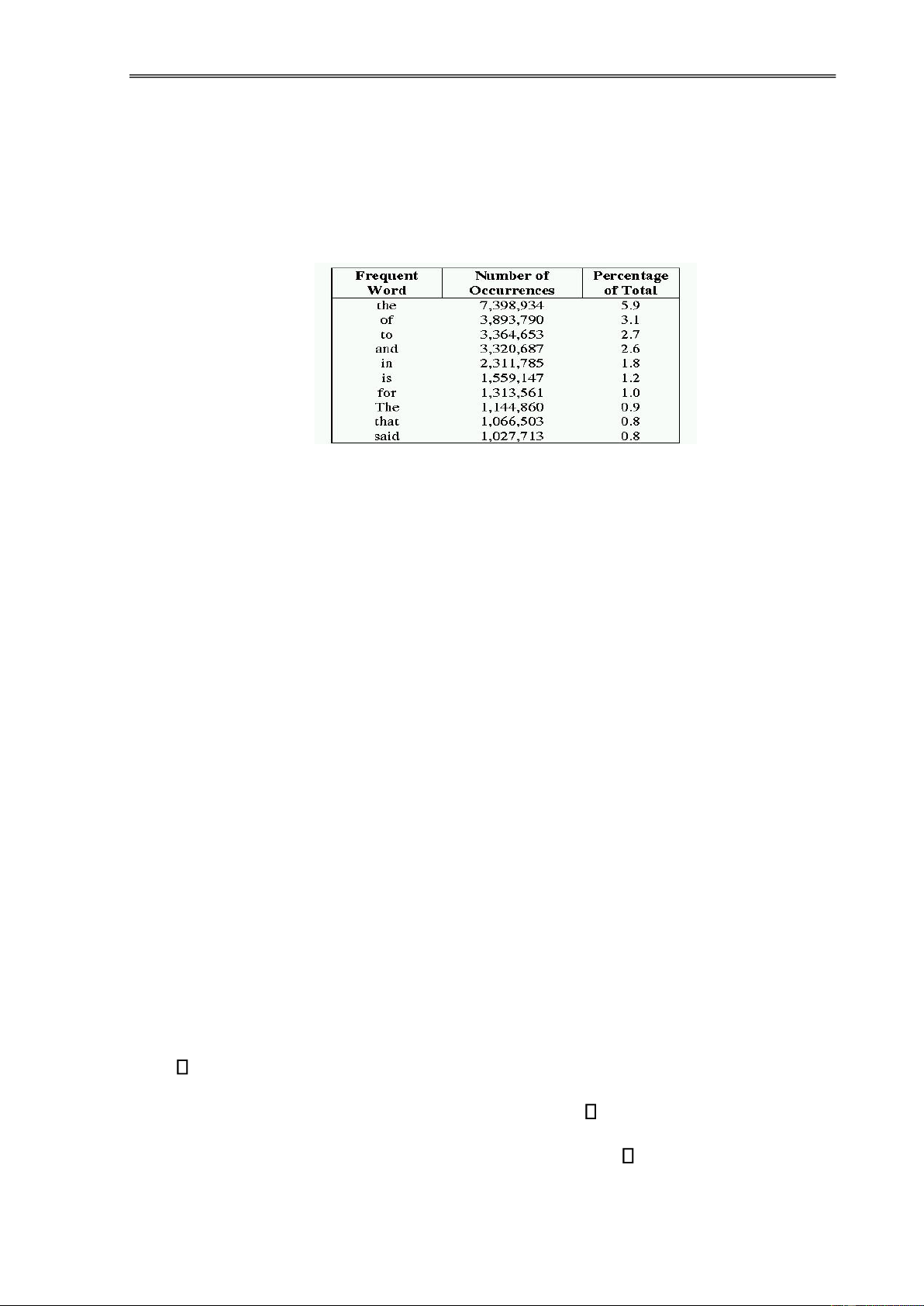

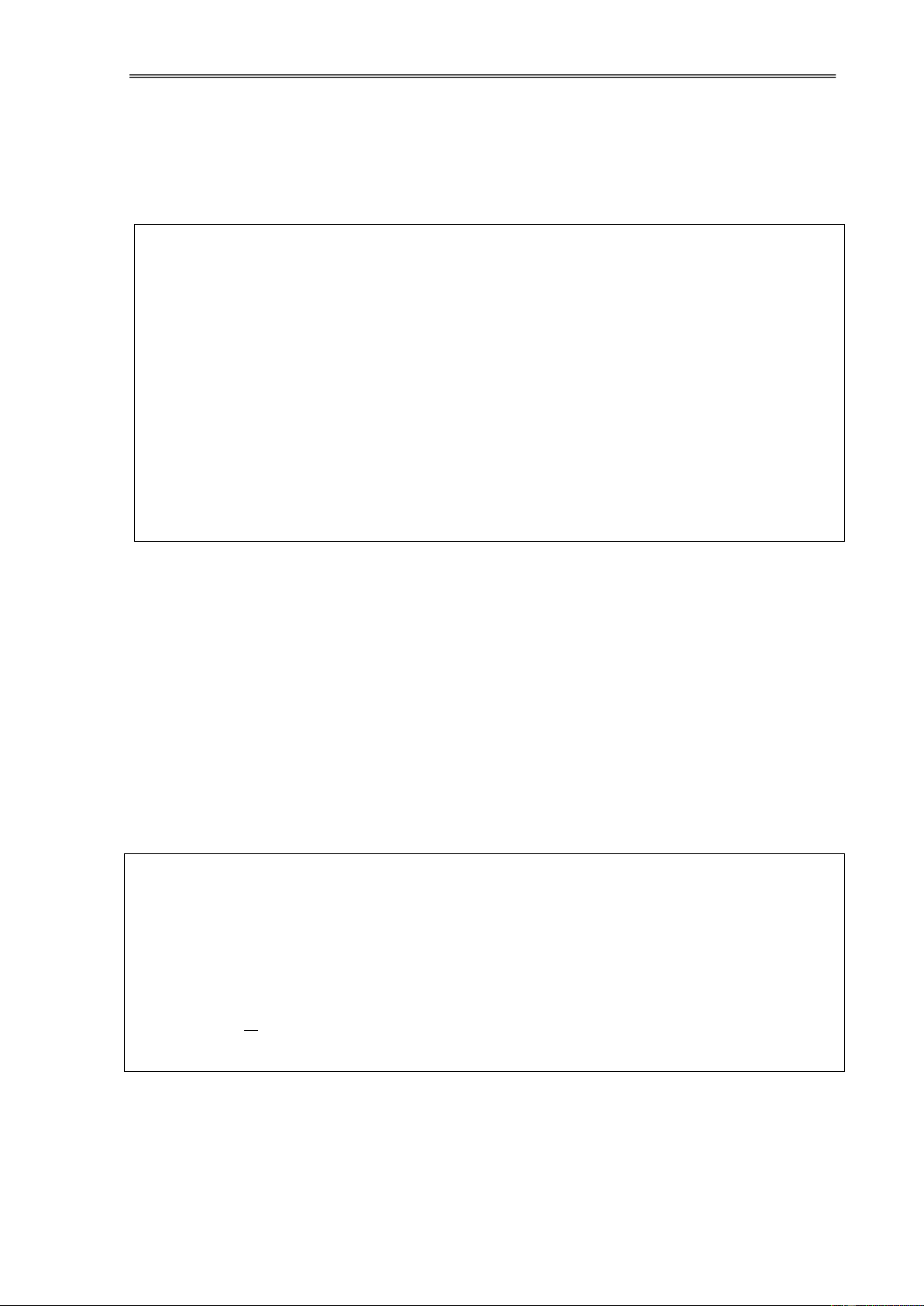

Tính toán ộ tương tự giữa 2 vector

Xét 2 vector X={x1, x2,..., xm} và Y={y1, y2,..., ym}.

Trong mô hình TF-IDF, ta có thể lựa chọn công thức nào ó ể tính toán ộ tương

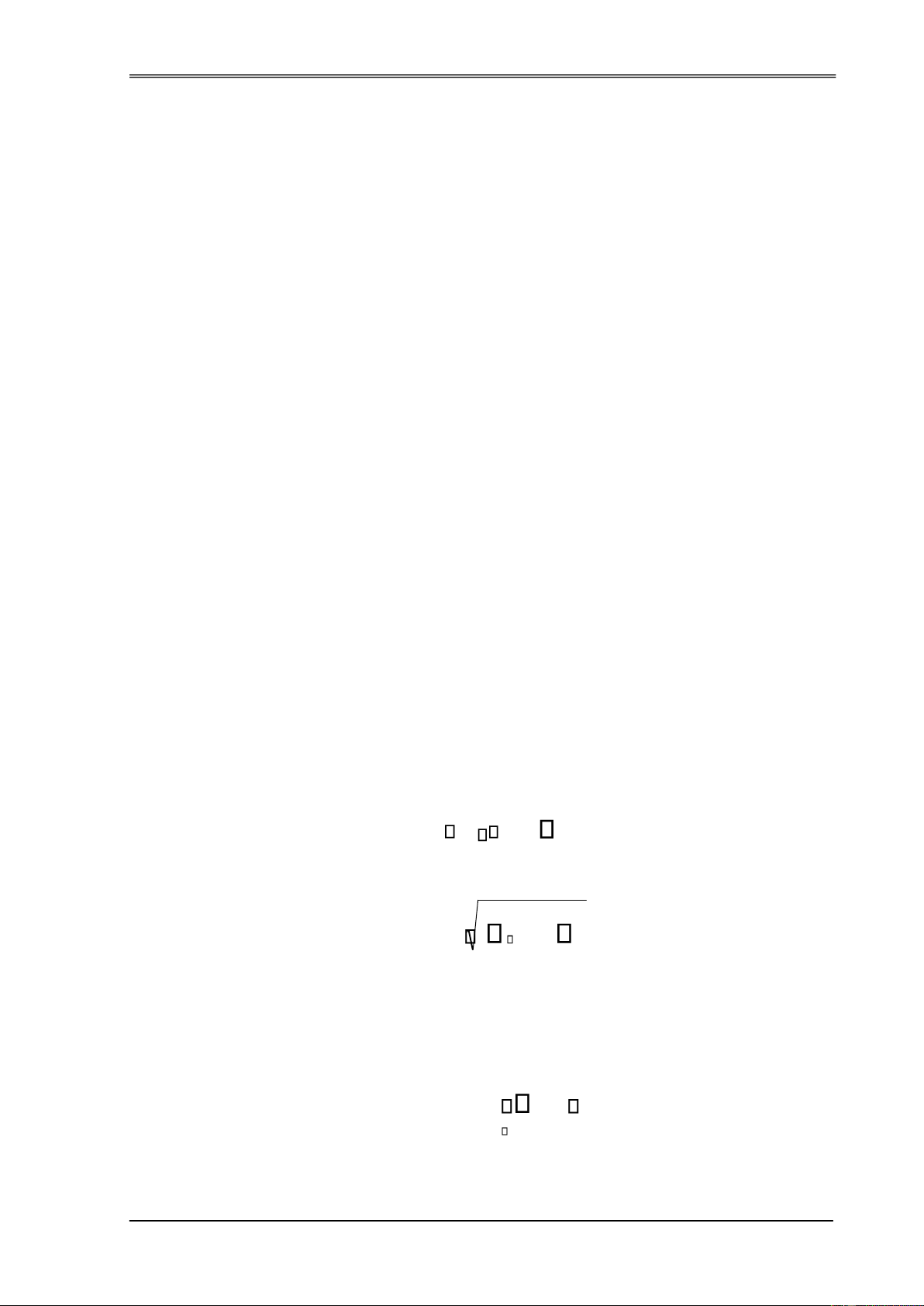

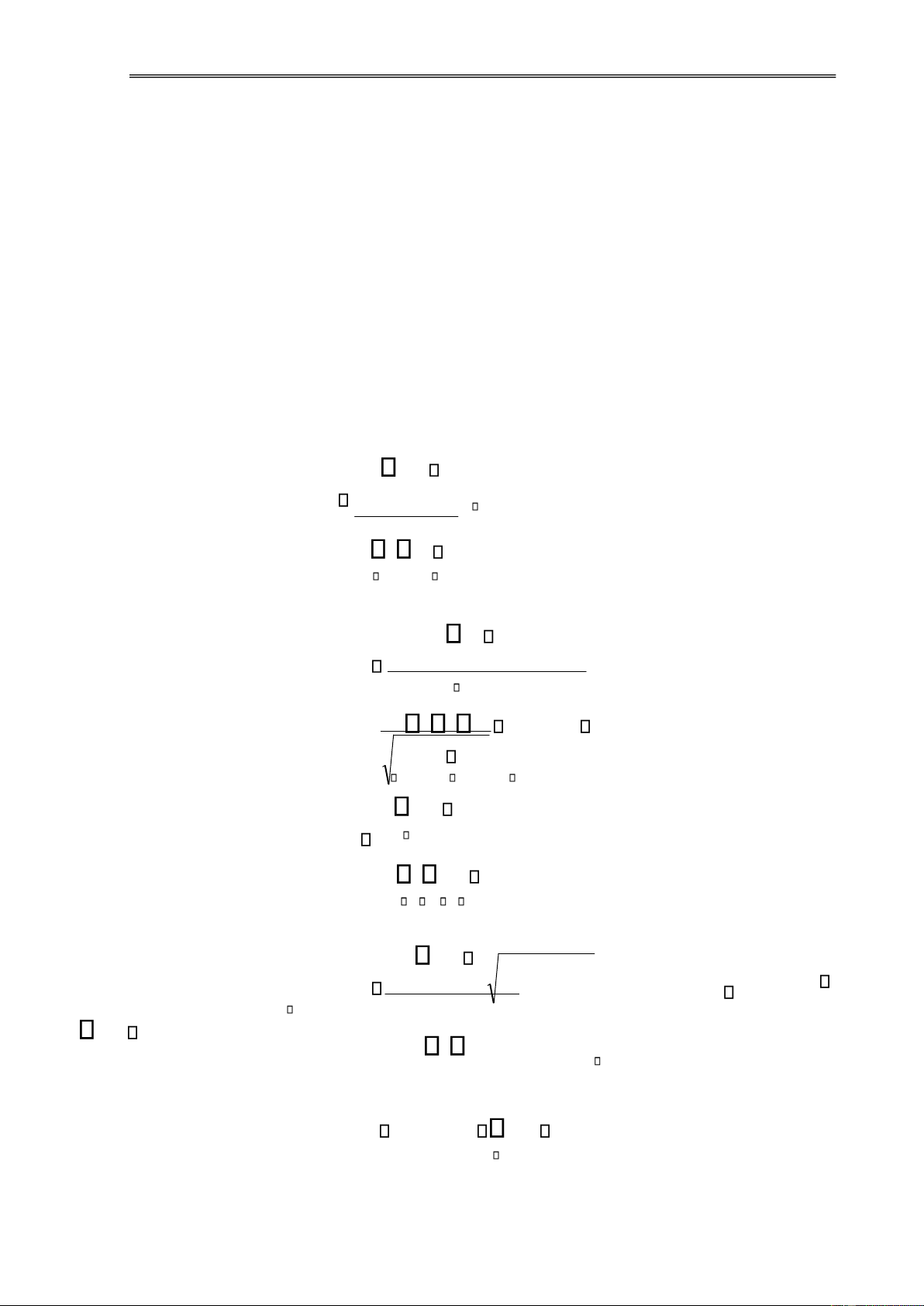

tự giữa các cặp tài liệu hoặc các cụm. Sau ây là các ộ o tương tự phổ biến [5][14][31]:

2 m (xi yi )

Dice: S im(X Y, ) i 1 m m xi2 yi2 i 1 i 1 Jaccard : m (xi yi ) Sim( X Y, ) m im 1 m xi2 yi2 X Y (xi yi ) i 1 i 1 i 1

m (xi yi ) Cosine: Sim( , ) i 1 m xi2 m yi2

i 1 i 1 i 1 i 1

m (xi yi ) Sim( X Y, ) Euclidean:

Sim( X Y, ) Dis(X Y, )

Overlap: i 1m m

m (xi yi )2 min( xi2, yi2 ) 1 i

Manhattan : Sim( X Y, ) Dis(X Y, ) m | xi yi | i 1

Hình 1.7. Các ộ o tương tự thường dùng lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Với xi và yj ại diện một cặp từ hoặc cụm từ trong tài liệu. Sử dụng các công

thức này và với một ngưỡng thích hợp, ta có thể dễ dàng xác ịnh mức ộ tương tự

của các tài liệu trong CSDL. Ý tưởng sử dụng mô hình TF-IDF ể biểu diễn tài liệu

có nhiều từ thông dụng giữa 2 tài liệu thì có nhiều khả năng chúng tương tự nhau.

Kỹ thuật phân cụm phân cấp và phân cụm phân hoạch (k-means) là 2 kỹ

thuật phân cụm thường ược sử dụng cho phân cụm tài liệu với mô hình TF-IDF.

1.5. Tổng kết chương 1

Chương 1 trình bày những kiến thức cơ bản về khai phá dữ liệu và khám phá

tri thức trong CSDL, các kỹ thuật áp dụng trong khai phá dữ liệu, những chức

năng chính, ứng dụng của nó trong xã hội,...

Chương này cũng trình bày một hướng nghiên cứu và ứng dụng trong khai

phá dữ liệu là phân cụm dữ liệu, gồm tổng quan về kỹ thuật phân cụm, các ứng

dụng của phân cụm, các yêu cầu ối với kỹ thuật phân cụm, các kiểu dữ liệu và ộ o tương tự,...

Một hướng tiếp cận mới trong khai phá dữ liệu là khai phá dữ liệu trong môi

trường Web. Phần này trình bày khái niệm và lợi ích của khai phá Web, một số

mô hình biểu diễn và xử lý dữ liệu văn bản áp dụng trong khai phá Web như mô

hình Boolean, mô hình tần số (TF), mô hình tần số nghịch ảo văn bản (IDF), mô

hình kết hợp TF-IDF và các ộ o ể xác ịnh ộ tương tự văn bản.

Chương 2. MỘT SỐ KỸ THUẬT PHÂN CỤM DỮ LIỆU

Các kỹ thuật áp dụng ể giải quyết vấn ề PCDL ều hướng tới hai mục tiêu

chung: Chất lượng của các cụm khám phá ược và tốc ộ thực hiện của thuật toán.

Tuy nhiên, các kỹ thuật PCDL có thể ược phân loại thành một số loại cơ bản dưa

trên các phương pháp tiếp cận như sau [10][19]: Hoàng Văn Dũng 28 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

2.1. Phân cụm phân hoạch

Ý tưởng chính của kỹ thuật này là phân một tập dữ liệu có n phần tử cho

trước thành k nhóm dữ liệu sao cho mỗi phần tử dữ liệu chỉ thuộc về một nhóm

dữ liệu và mỗi nhóm dữ liệu có tối thiểu ít nhất một phần tử dữ liệu. Các thuật

toán phân hoạch có ộ phức tạp rất lớn khi xác ịnh nghiệm tối ưu toàn cục cho vấn

ề PCDL, vì nó phải tìm kiếm tất cả các cách phân hoạch có thể ược. Chính vì vậy,

trên thực tế người ta thường i tìm giải pháp tối ưu cục bộ cho vấn ề này bằng cách

sử dụng một hàm tiêu chuẩn ể ánh giá chất lượng của các cụm cũng như ể hướng

dẫn cho quá trình tìm kiếm phân hoạch dữ liệu. Với chiến lược này, thông thường

người ta bắt ầu khởi tạo một phân hoạch ban ầu cho tập dữ liệu theo phép ngẫu

nhiên hoặc theo heuristic và liên tục tinh chỉnh nó cho ến khi thu ược một phân

hoạch mong muốn, thoả mãn các iều kiện ràng buộc cho trước. Các thuật toán

phân cụm phân hoạch cố gắng cải tiến tiêu chuẩn phân cụm bằng cách tính các

giá trị o ộ tương tự giữa các ối tượng dữ liệu và sắp xếp các giá trị này, sau ó thuật

toán lựa chọn một giá trị trong dãy sắp xếp sao cho hàm tiêu chuẩn ạt giá trị tối

thiểu. Như vậy, ý tưởng chính của thuật toán phân cụm phân hoạch tối ưu cục bộ

là sử dụng chiến lược ăn tham ể tìm kiếm nghiệm.

Lớp các thuật toán phân cụm phân hoạch bao gồm các thuật toán ề xuất ầu

tiên trong lĩnh vực KPDL cũng là các thuật toán ược áp dụng nhiều trong thực tế

như k-means, PAM, CLARA, CLARANS. Sau ây là một số thuật toán kinh iển

ược kế thừa sử dụng rộng rãi.

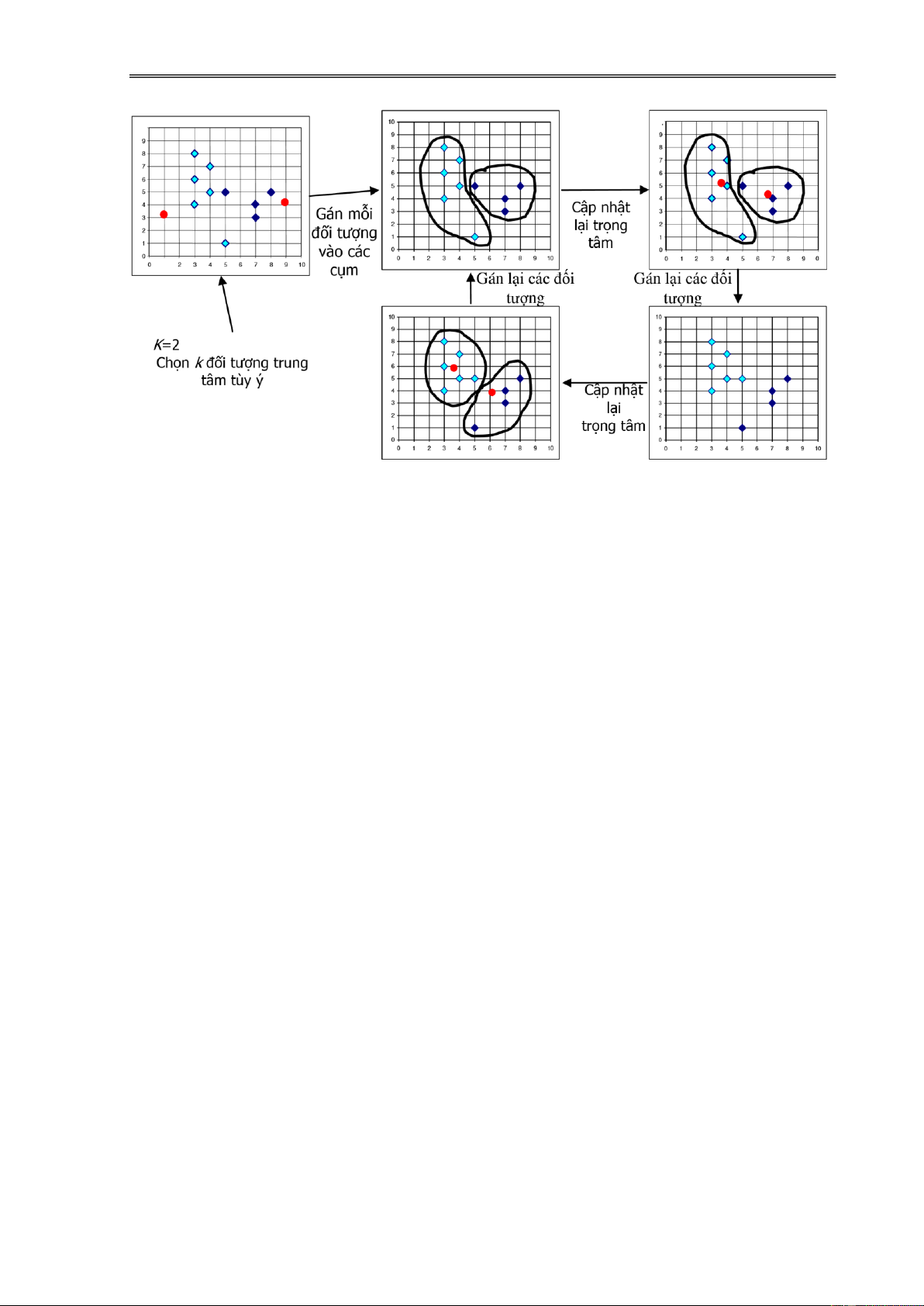

2.1.1. Thuật toán k-means

Thuật toán phân cụm k-means do MacQueen ề xuất trong lĩnh vực thống kê

năm 1967, mục ích của thuật toán k-means là sinh ra k cụm dữ liệu {C1, C2,…,

Ck} từ một tập dữ liệu ban ầu gồm n ối tượng trong không gian d chiều

Xi =(xi1, xi2, …,xid) (i 1,n), sao cho hàm tiêu chuẩn: E k

i 1 x Ci D2(x m i ) ạt giá trị

tối thiểu. Trong ó: mi là trọng tâm của cụm Ci, D là khoảng cách giữa hai ối tượng. lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

Trọng tâm của một cụm là một vector, trong ó giá trị của mỗi phần tử của nó

là trung bình cộng các thành phần tương ứng của các ối tượng vector dữ liệu trong

cụm ang xét. Tham số ầu vào của thuật toán là số cụm k, tập CSDL gồm n phần

tử và tham số ầu ra của thuật toán là các trọng tâm của các cụm dữ liệu. Độ o

khoảng cách D giữa các ối tượng dữ liệu thường ược sử dụng dụng là khoảng cách

Euclide, bởi vì ây là mô hình khoảng cách dễ ể lấy ạo hàm và xác ịnh các cực trị

tối thiểu. Hàm tiêu chuẩn và ộ o khoảng cách có thể ược xác ịnh cụ thể hơn tuỳ

vào ứng dụng hoặc các quan iểm của người dùng.

Thuật toán k-means bao gồm các bước cơ bản như sau:

INPUT: Một CSDL gồm n ối tượng và số các cụm k.

OUTPUT: Các cụm Ci (i=1,..,k) sao cho hàm tiêu chuẩn E ạt giá trị tối thiểu. Bước 1: Khởi tạo

Chọn k ối tượng mj (j=1...k) là trọng tâm ban ầu của k cụm từ tập dữ liệu

(việc lựa chọn này có thể là ngẫu nhiên hoặc theo kinh nghiệm). Bước 2: Tính toán khoảng cách

Đối với mỗi ối tượng Xi (1 i n) , tính toán khoảng cách từ nó tới mỗi

trọng tâm mj với j=1,..,k, sau ó tìm trọng tâm gần nhất ối với mỗi ối tượng. Bước 3:

Cập nhật lại trọng tâm

Đối với mỗi j=1,..,k, cập nhật trọng tâm cụm mj bằng cách xác ịnh trung bình

cộng của các vector ối tượng dữ liệu.

Bước 4: Điều kiện dừng

Lặp các bước 2 và 3 cho ến khi các trọng tâm của cụm không thay ổi.

Hình 2.1. Thuật toán k-means

Thuật toán k-means ược chứng minh là hội tụ và có ộ phức tạp tính toán là: O((n k d )

T flop ). Trong ó: n là số ối tượng dữ liệu, k là số cụm dữ liệu, d

là số chiều, là số vòng lặp, T flop là thời gian ể thực hiện một phép tính cơ sở như

phép tính nhân, chia, …Như vậy, do k-means phân tích phân cụm ơn giản nên có

thể áp dụng ối với tập dữ liệu lớn. Tuy nhiên, nhược iểm của kmeans là chỉ áp

dụng với dữ liệu có thuộc tính số và khám phá ra các cụm có dạng hình cầu, k-

means còn rất nhạy cảm với nhiễu và các phần tử ngoại lai trong dữ liệu. Hình sau

diễn tả môi phỏng về một số hình dạng cụm dữ liệu khám phá ược bởi k-means: Hoàng Văn Dũng 30 lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

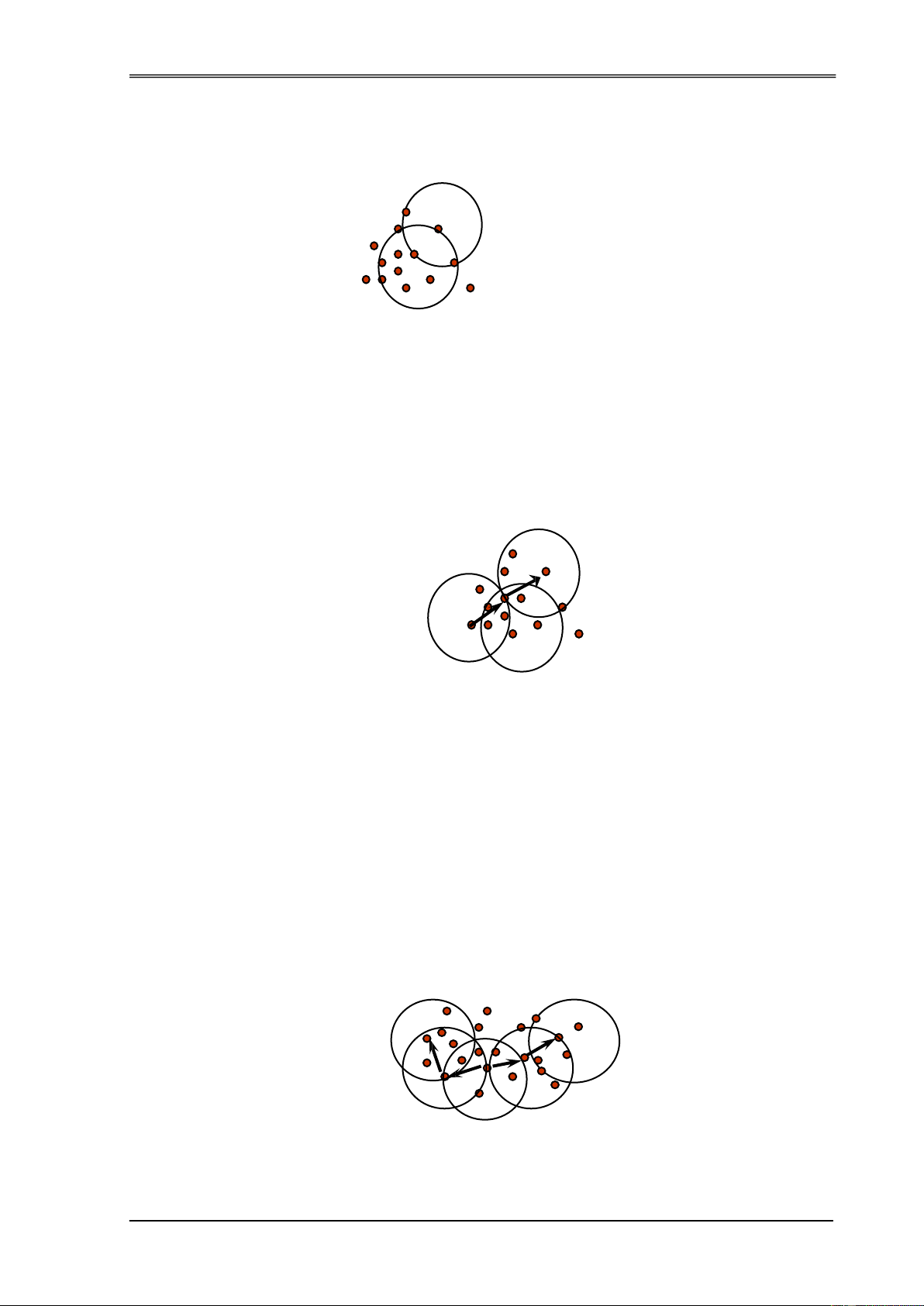

Hình 2.2. Hình dạng cụm dữ liệu ược khám phá bởi k-means

Hơn nữa, chất lượng PCDL của thuật toán k-means phụ thuộc nhiều vào các

tham số ầu vào như: số cụm k và k trọng tâm khởi tạo ban ầu. Trong trường hợp,

các trọng tâm khởi tạo ban ầu mà quá lệch so với các trọng tâm cụm tự nhiên thì

kết quả phân cụm của k-means là rất thấp, nghĩa là các cụm dữ liệu ược khám phá

rất lệch so với các cụm trong thực tế. Trên thực tế người ta chưa có một giải pháp

tối ưu nào ể chọn các tham số ầu vào, giải pháp thường ược sử dụng nhất là thử

nghiệm với các giá trị ầu vào k khác nhau rồi sau ó chọn giải pháp tốt nhất.

Đến nay, ã có rất nhiều thuật toán kế thừa tư tưởng của thuật toán k-means

áp dụng trong KPDL ể giải quyết tập dữ liệu có kích thước rất lớn ang ược áp

dụng rất hiệu quả và phổ biến như thuật toán k-medoid, PAM, CLARA,

CLARANS, k- prototypes, …

2.1.2. Thuật toán PAM

Thuật toán PAM (Partitioning Around Medoids) ược Kaufman và Rousseeuw

ề xuất 1987, là thuật toán mở rộng của thuật toán k-means, nhằm có khả năng xử

lý hiệu quả ối với dữ liệu nhiễu hoặc các phần tử ngoại lai. Thay vì sử dụng các

trọng tâm như k-means, PAM sử dụng các ối tượng medoid ể biểu diễn cho các

cụm dữ liệu, một ối tượng medoid là ối tượng ặt tại vị trí trung tâm nhất bên trong

của mỗi cụm. Vì vậy, các ối tượng medoid ít bị ảnh hưởng của các ối tượng ở rất lOMoAR cPSD| 39651089 Khai

phá dữ liệu Web bằng kỹ thuật phân cụm

xa trung tâm, trong khi ó các trọng tâm của thuật toán k-means lại rất bị tác ộng

bởi các iểm xa trung tâm này. Ban ầu, PAM khởi tạo k ối tượng medoid và phân

phối các ối tượng còn lại vào các cụm với các ối tượng medoid ại diện tương ứng

sao cho chúng tương tự với ối tượng medoid trong cụm nhất.

Để xác ịnh các medoid, PAM bắt ầu bằng cách lựa chọn k ối tượng medoid

bất kỳ. Sau mỗi bước thực hiện, PAM cố gắng hoán chuyển giữa ối tượng medoid

Om và một ối tượng Op không phải là medoid, miễn là sự hoán chuyển này nhằm

cải tiến chất lượng của phân cụm, quá trình này kết thúc khi chất lượng phân cụm

không thay ổi. Chất lượng phân cụm ược ánh giá thông qua hàm tiêu chuẩn, chất

lượng phân cụm tốt nhất khi hàm tiêu chuẩn ạt giá trị tối thiểu.

Để quyết ịnh hoán chuyển hai ối tượng Om và Op hay không, thuật toán PAM

sử dụng giá trị tổng chi phí hoán chuyển Cjmp làm căn cứ:

- Om: Là ối tượng medoid hiện thời cần ược thay thế

- Op: Là ối tượng medoid mới thay thế cho Om;

- Oj: Là ối tượng dữ liệu (không phải là medoid) có thể ược di chuyển sang cụm khác.

- Om,2: Là ối tượng medoid hiện thời khác với Om mà gần ối tượng Oj nhất.

Bốn trường hợp như mô tả trong thí dụ trên, PAM tính giá trị hoán ổi Cjmp

cho tất cả các ối tượng Oj. Cjmp ở ây nhằm ể làm căn cứ cho việc hoán chuyển giữa

Om và Op. Trong mỗi trường hợp Cjmp ược tính với 4 cách khác nhau như sau:

- Trường hợp 1: Giả sử Oj hiện thời thuộc về cụm có ại diện là Om và Oj

tương tự với Om,2 hơn Op (d(Oj, Op) d(Oj, Om,2)). Trong khi ó, Om,2 là ối tượng

medoid tương tự xếp thứ 2 tới Oj trong số các medoid. Trong trường hợp này, ta

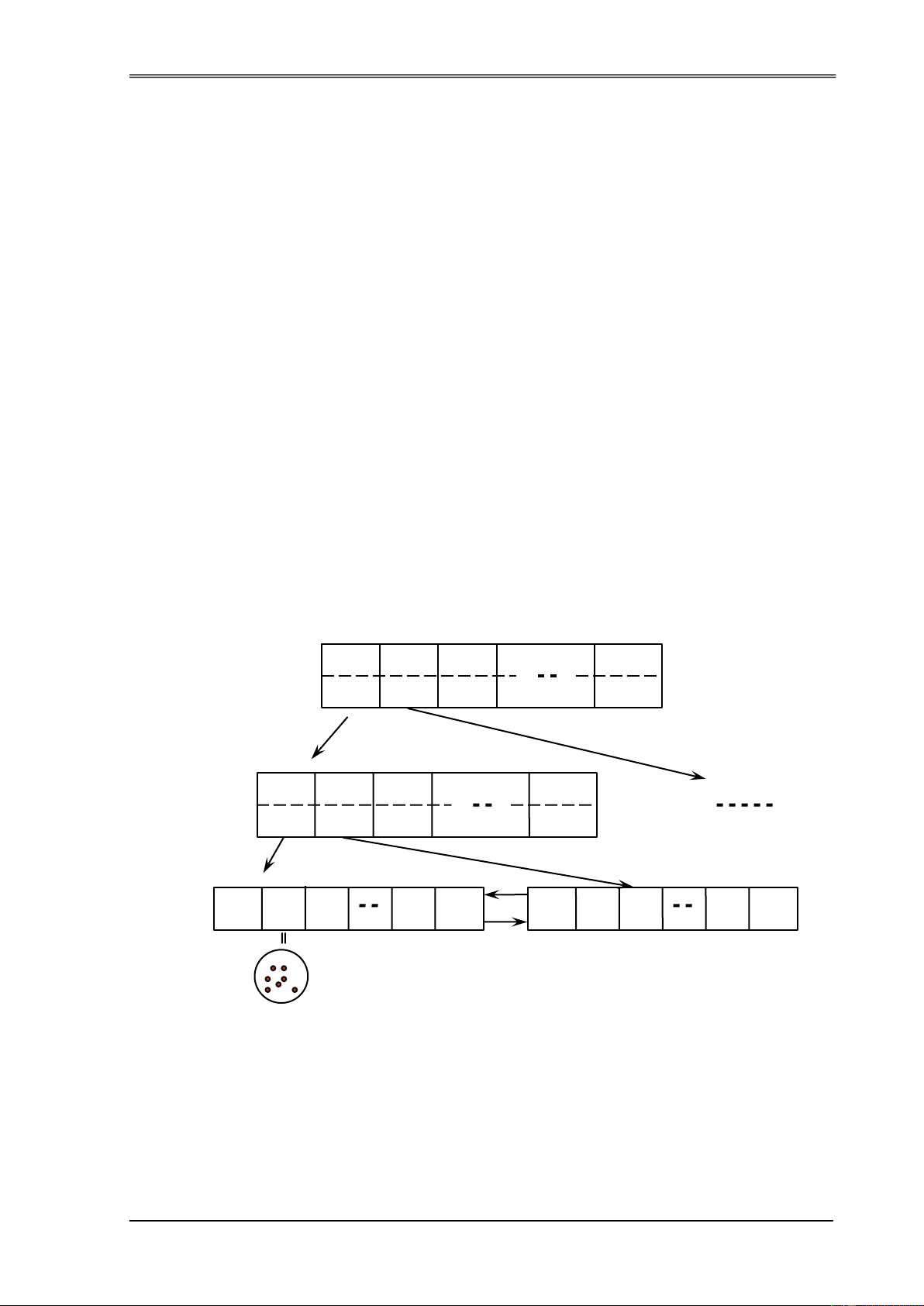

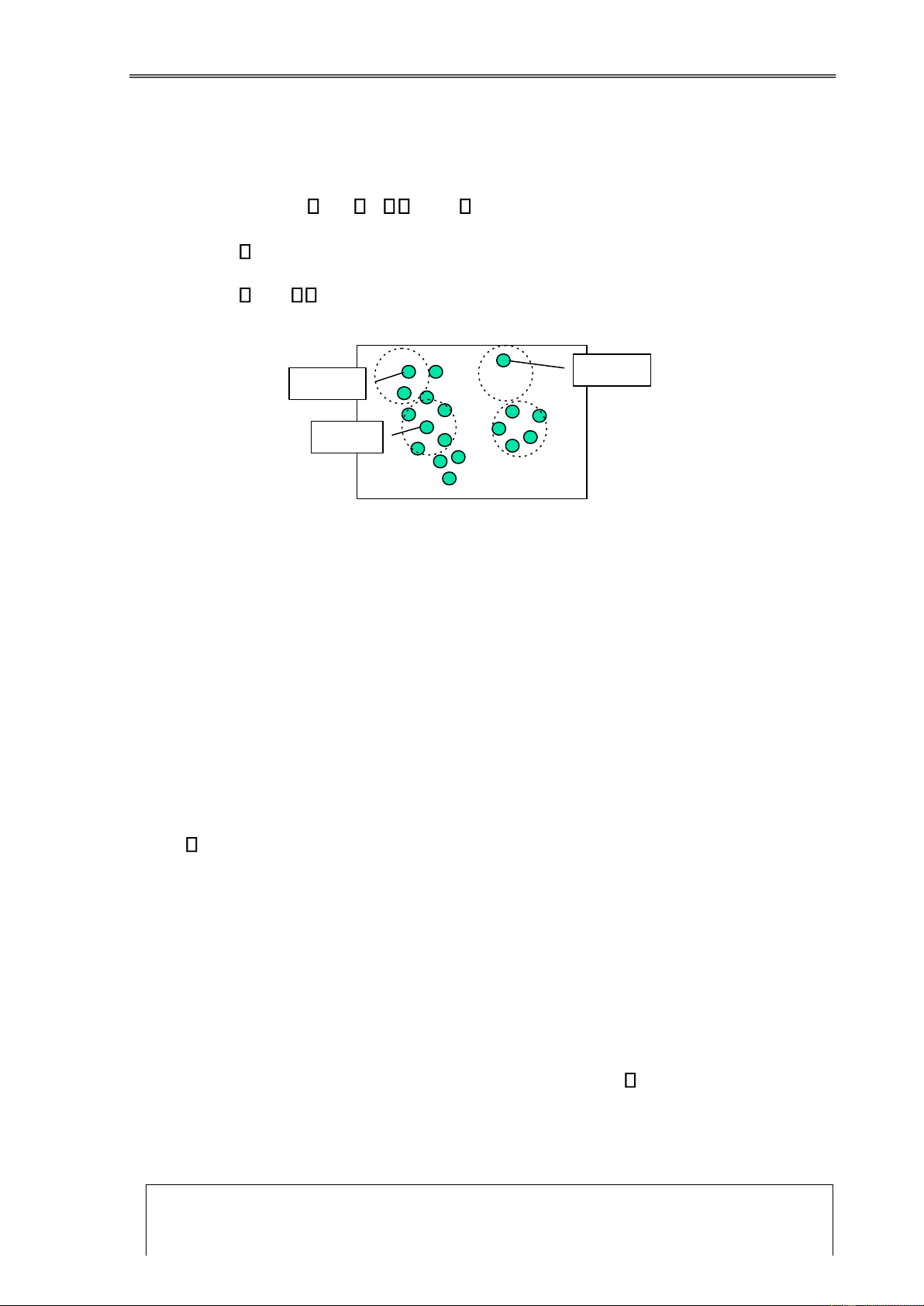

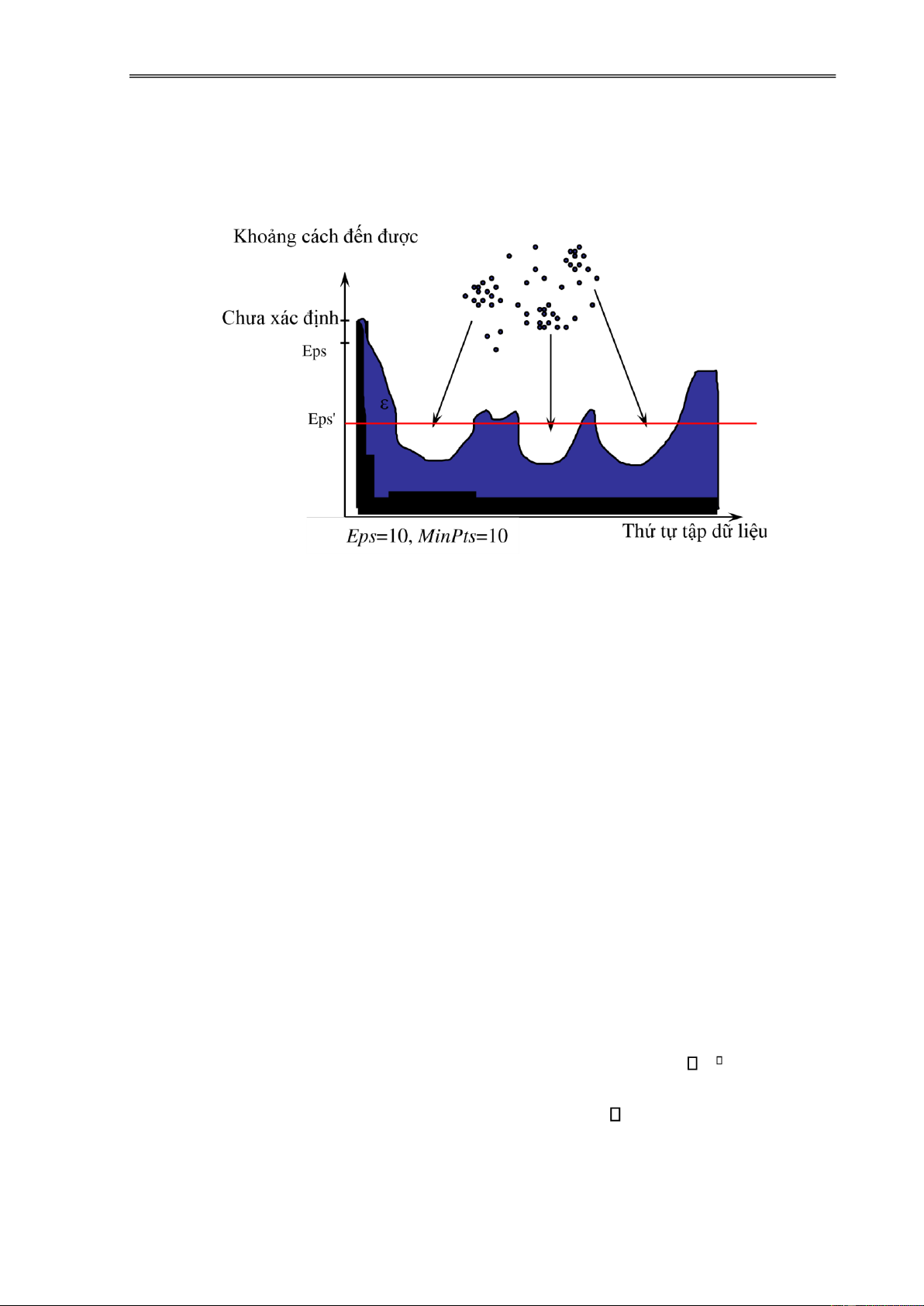

thay thế Om bởi ối tượng medoid mới Op và Oj sẽ thuộc về cụm có ối tượng ại diện